- Pár nap, és humanoid robotok is futják már a félmaratont

- Google AI segíti az amerikai áramhálózat fejlesztését

- Egy vacsora, és a Trump-kormány már nem korlátozza az NVIDIA H20-as eladásait

- 600 tonna iPhone-t vitt az Apple az USA-ba Indiából Trump vámjai miatt

- Befutott az AI az ügyfélszolgálatra, és sokkal több terméket tudnak azóta eladni

- One otthoni szolgáltatások (TV, internet, telefon)

- Otthoni hálózat és internet megosztás

- Hálózati / IP kamera

- Netflix

- Linux kezdőknek

- Mikrotik routerek

- Kodi és kiegészítői magyar nyelvű online tartalmakhoz (Linux, Windows)

- Internet és kábel TV hálózatokról kötetlenül

- Fizetős szoftverek ingyen vagy kedvezményesen

- Windows 10

-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Raymond

titán

válasz

Firestormhun

#20459

üzenetére

Firestormhun

#20459

üzenetére

"Játékok esetében shared memoryhoz túl lassú még ez az interface is, ezért nem beszélhetünk additív memóriáról továbbra sem."

Ez azert van mert az NV-nel csupa amator dolgozik es nem igazan ertenek hozza. Az AMD-nel viszont a radeon-al ez meg ugy is megoldhato a HBCC-nek hala hogy egy USB2.0-as 32GB-os pendrive-al ha bovited a VRAM-ot akkor is menni fog meg a legigenyesebb profi alkalmazas is.

"Editor's Day-en gyári hűtéssel 2.3GHz-es darabokkal villogtak"

Gondolom azt a ket darabot ami ilyenbol van azt meg is tartjak maguknak a HQ-ban

-

válasz

Firestormhun

#20459

üzenetére

Firestormhun

#20459

üzenetére

2.3 Ghz?

Köszi az infókat, nagyon szuperek !

-

Yutani

nagyúr

válasz

Firestormhun

#20456

üzenetére

Firestormhun

#20456

üzenetére

8.) Raytraced tükröződések mellett még kísérletezni fognak RT AO-val és RT részecske effektekkel.

Erről van szó, csinálják meg jól!

-

voodoo98

addikt

válasz

Firestormhun

#20456

üzenetére

Firestormhun

#20456

üzenetére

Köszi!

-

sutyi^

senior tag

válasz

Firestormhun

#20328

üzenetére

Firestormhun

#20328

üzenetére

Mire megjelenik a játék addigra a következő generációs GF eresztés majd el is bírja.

-

regener

veterán

válasz

Firestormhun

#20328

üzenetére

Firestormhun

#20328

üzenetére

A Hairworks nem a PhysX-re alapozva működik? Mert ugye azt "dobták" most.

-

Jack@l

veterán

válasz

Firestormhun

#19515

üzenetére

Firestormhun

#19515

üzenetére

Control az odabaszós grafikailag, de még ez is csak részben RT.

-

válasz

Firestormhun

#19515

üzenetére

Firestormhun

#19515

üzenetére

Ummm, izé, a Tomb Raiderben az RT mellé minek a HBAO és a CHS?

(#19360) Raymond: kategórián belül ment feljebb.

(#19519) lezso6: kérdés, hogy a fallback kód hogy futna a Vegán. Ha jól, akkor tuti nem lesz

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

hoolla

aktív tag

válasz

Firestormhun

#18933

üzenetére

Firestormhun

#18933

üzenetére

En ezt ketlem. Elhinnem ha nem lennenek meg custom kartyak.

-

-FreaK-

veterán

válasz

Firestormhun

#18933

üzenetére

Firestormhun

#18933

üzenetére

Amennyiben ez igaz, akkor teljesen feleslegesen várunk ma bármire is, ami ma fog kiderülni azt már tudjuk. A tényleges teljesítményét és fogyasztását majd csak a tesztekből fogjuk megtudni, ezek a százalékok amiket pletykálnak semmit nem mondanak.

Gyanítottam amúgy hogy ez lesz, mert ilyenkor már legalább arról szoktak menni a hírek, hogy a tesztelőknél vannak a kártyák, csak ugye nda.. de most még semmi ilyesmi nem volt (vagy valami leak, kép, akármi), szóval odébb lesz az még, hogy megtudjuk a valós teljesítményét.

-

carl18

addikt

válasz

Firestormhun

#18933

üzenetére

Firestormhun

#18933

üzenetére

Akkor mától fogva még egy hónap amíg piacra dobják

az jó sok idő még mindig

az jó sok idő még mindig

De legalább ma este a hivatalos Spec ki fogják dobni

-

wjbhbdux

veterán

válasz

Firestormhun

#18527

üzenetére

Firestormhun

#18527

üzenetére

na ki olvassa le a chiprol hogy 1 vagy 2 eve rohadt mar a raktarban?

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

westlake

félisten

válasz

Firestormhun

#18518

üzenetére

Firestormhun

#18518

üzenetére

Ez generált kép, nem valós. Szóval nem lehet pictured, maximum "pictured".

Persze ettől még lehet a valódi termék grafikája. -

westlake

félisten

válasz

Firestormhun

#18483

üzenetére

Firestormhun

#18483

üzenetére

Ha a új Ti/TITAN is azt tudja (játokkal) mint a Quadro RTX 6000, akkor nem lesz okunk a panaszra.

-

válasz

Firestormhun

#16346

üzenetére

Firestormhun

#16346

üzenetére

A GP100-GP102 szétválasztást kitűnően meg lehetett jósolni pusztán a GP100 ismeretében, ehhez nem kellett leak. A két héttel korábbi képek pedig már a nyakunkon van kategória.

Igazából arra akartam csak rávilágítani, hogy attól, hogy nincs leak, akár 3-4 hét múlva is jöhetnek a cuccok. Nem fognak, persze. -

Locutus

veterán

válasz

Firestormhun

#16085

üzenetére

Firestormhun

#16085

üzenetére

Azt azért nem mondta, hogy Pascalból sem jön semmi új

-

Jack@l

veterán

válasz

Firestormhun

#16085

üzenetére

Firestormhun

#16085

üzenetére

Csak a nyárról beszélt szerintem. Kár lenne elszalasztaniuk a karácsonyi szezont. (mondjuk látva a konkuencia balf*kodását teljesen felesleges kapkodniuk)

Nem mellesleg kijött a negyedéves beszámolójuk, Y/Y 56% -al több volt a bevételük. -

Interceptor

addikt

válasz

Firestormhun

#16069

üzenetére

Firestormhun

#16069

üzenetére

Egy elemlámpával meg zsákkal lehet nagyobb eredményeket érnének el

-

Departed

őstag

válasz

Firestormhun

#16047

üzenetére

Firestormhun

#16047

üzenetére

Hosszú még a nap.

-

joysefke

veterán

válasz

Firestormhun

#15900

üzenetére

Firestormhun

#15900

üzenetére

Ahh, ezt nem tudtam.

ez a Checkboard rendering tehát igényelni fog a játék oldaláról is támogatást? ezek szerint nem számíthatok rá, hogy a driverben bekapcsolom és akkor minden játékban ahol 4K felbontást szeretnék használni fogja?

J.

-

TTomax

félisten

válasz

Firestormhun

#15479

üzenetére

Firestormhun

#15479

üzenetére

Viszont akkor én nem hinném ,hogy +50%-ot verne a 1080ra.Csak mert hogy ilyen pletyik is voltak.Az 1000+dolcsis ár több mint hervasztó.

-

válasz

Firestormhun

#15479

üzenetére

Firestormhun

#15479

üzenetére

Jah, sajnos... valszeg csak Titan jön majd 1000 dollárért... hülyék lennének kiadni valami vágottatt olcsóbban. A Ti max akkor kell jöjjön amikor az AMD is jön... (mint tavaly is volt).

Ami egyben ugye azt is jelenti hogy nálunk 1000-1200 EUR minimum...

-

Abu85

HÁZIGAZDA

válasz

Firestormhun

#15291

üzenetére

Firestormhun

#15291

üzenetére

Viszont a GK110 esetében az NV nem mondta a GTC-s publikumnak, hogy csak Tesla opciót építenek rá, és Quadro/GeForce modellt ne is várjanak. De egyébként akkor még nem volt kellően moduláris a dizájn, hogy megvonják a HPC-s lapkát a grafikai résztől. Ezt a GK210 esetében kísérletezték ki, hogy miképp lehet olyan blokkokat tervezni, amelyek könnyen megfoszthatók a compute szempontjából nem hasznos elemektől. Ilyet más nem nagyon csinált, aminek az oka, hogy az egész nem teljesen úgy működik, hogy csak kiveszed belőle és kész. Ezt tervezés szintjén kell felépíteni. A grafikai elemeket külön blokkba kell befűzni, stb.

-

Malibutomi

nagyúr

válasz

Firestormhun

#15123

üzenetére

Firestormhun

#15123

üzenetére

Szoval megprobalja megjosolni hogy grafikus vagy compute feladat jon kovetkezonek, es ha nem jol sikerul, akkor egy ciklusra besul a fele a vegrahajtoegysegeknek?

-

#45997568

törölt tag

válasz

Firestormhun

#14978

üzenetére

Firestormhun

#14978

üzenetére

Ha tenyleg fel-egy honap mulva jonnek akkor az eleg jo kis nyarat vetit elore a szamunkra, bar igy legalabb hamarabb lehet latni mi a legmegfelelobb es a nyaron osszeszedni a ravalot. Ar-teljesitmeny mutatok az erdekesek elsosorban, na meg a DX12-Vulkan, es VR vilagaban hogy allnak majd helyt ezek a kartyak.

-

westlake

félisten

válasz

Firestormhun

#14963

üzenetére

Firestormhun

#14963

üzenetére

És akkor máris nem olyan biztos a 1080 650$-os ára.

Vagy ha mégis 650$ lesz, akkor viszont teljsen indokolt.

Most már csak akkor lennék teljesen elégedett, hogy ha nem is 2560 shader lenne a teljes GPU-ban, hanem 2800+.

-

Televan74

nagyúr

válasz

Firestormhun

#14963

üzenetére

Firestormhun

#14963

üzenetére

Nem is adják majd szerintem olcsón.

-

Dragbajnok

tag

válasz

Firestormhun

#14963

üzenetére

Firestormhun

#14963

üzenetére

Úgy látszik van már pár GDDR5X legyártva.

-

füles_

őstag

válasz

Firestormhun

#14931

üzenetére

Firestormhun

#14931

üzenetére

VideoCardZ szerint 332,90 mm² a mérete.Nekem telibe 330mm² jött ki,szóval valahogy eköré várhatjuk

-

gainwardgs

veterán

válasz

Firestormhun

#14931

üzenetére

Firestormhun

#14931

üzenetére

Jöhetnek az előzetes benchmarkok

-

blu79

addikt

válasz

Firestormhun

#14845

üzenetére

Firestormhun

#14845

üzenetére

ez jó hír ha igaz, már várom nagyon

-

westlake

félisten

válasz

Firestormhun

#14814

üzenetére

Firestormhun

#14814

üzenetére

Én egyáltalán nem tartom logikus lépésnek, hogy ne csináljanak a GP100-ból gamer kártyát is. A TX-et is megvették sokan, pedig az sem volt olcsó. Aztán a fene tudja, hogy milyen a GPU kihozatali aránya, meg a HBM2 gyártási költsége.

-

válasz

Firestormhun

#14787

üzenetére

Firestormhun

#14787

üzenetére

A honlapjuk szerint 5-én lesz (kedden).

-

oliba

őstag

válasz

Firestormhun

#14603

üzenetére

Firestormhun

#14603

üzenetére

Es mi jelent, both kamuztak? Megan nem allnak olyan jol az in gpu-val, mint szeretnek?

-

Abu85

HÁZIGAZDA

válasz

Firestormhun

#14603

üzenetére

Firestormhun

#14603

üzenetére

Fasza, akkor kamuztak, mert azt állították, hogy az a Pascal. De legalább most nem makettel jöttek elő.

Az a slide szándékosan nem arányos. Az AMD írta, hogy abból ne számolgassunk.

-

válasz

Firestormhun

#14548

üzenetére

Firestormhun

#14548

üzenetére

Ez könnyen benne van... énis valami ilyesmit várok a jövő évre a pascal szériától...

Kb...

970/980 szint -> az új "x50/60" széria. Kicsi pascal, 5-6 millió tranyó 4-6GB GDDR5.

980Ti/Titan szint -> az új "x70/80" széria. Közepes pascal 8-9 millió tranyó 8-12GB GDDR5/X.

És ugye lesz a csúcs nagy pascal... az új "Titan széria", ami a 16-17-18 millió tranyó, 16/32GB HBM2 ram stb stb.

-

Puma K

nagyúr

válasz

Firestormhun

#14548

üzenetére

Firestormhun

#14548

üzenetére

Köszönöm a válaszodat!

Azért kérdeztem, mert most rebesgetik a GTX960 Ti érkezését... az meg az eddig megálmodott értékek alapján nem lenne rossz kártya a számomra... de ha már eddig kihúztam a GTX760-al akkor az általad leírtak alapján még egy okom van, hogy várjam a Pascal-t.

-

KillerKollar

őstag

válasz

Firestormhun

#14518

üzenetére

Firestormhun

#14518

üzenetére

Ezek alapján nehéz elképzelni hogy mennyibe fog kerülni a 980 Ti utódja...De az biztos hogy brutális ára lesz,remélem 1000 dollár fölé nem nagyon mennek,csak majd a Titánnál első körbe,abban már nem is reménykedek hogy az olcsóbb lesz 1500 dolcsinál.

-

válasz

Firestormhun

#14518

üzenetére

Firestormhun

#14518

üzenetére

Ha a higher end tényleg HBM2-vel jön, akkor lehet, hogy GP106 lesz először GDDR5X-szel?

-

schwartz

addikt

válasz

Firestormhun

#14229

üzenetére

Firestormhun

#14229

üzenetére

Mar hazudtak egyszer a Fermivel igy nem sokat adok arra mit lebegtet a kezeben. Logarlec is lehetne...

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Malibutomi

nagyúr

válasz

Firestormhun

#14229

üzenetére

Firestormhun

#14229

üzenetére

Csak az nv eddig a HMC memoriat akarta ha jol tudom, csak az besult.

-

schwartz

addikt

válasz

Firestormhun

#14216

üzenetére

Firestormhun

#14216

üzenetére

Ha mar most gyartjak, akkor arra milyen memoria kerul? A HBM fejleszteseben ok nem vettek reszt igy tapasztalat nem sok, a HBM2 meg sehol, igy az memoria utolag lesz rafercelve? Ha mellenyulnak az interposerrel ugy Q1 2016-ban siras jon, nem a Pascal.

-

Crytek

nagyúr

válasz

Firestormhun

#14216

üzenetére

Firestormhun

#14216

üzenetére

Már ilyen hamar? Akkor megvárom ezt is!

-

stratova

veterán

válasz

Firestormhun

#14216

üzenetére

Firestormhun

#14216

üzenetére

Ennek az lehet az oka, hogy a 14/16 nm FinFET még igen drága lesz s érdemesebb a drága, nagyobb haszonnal eladható termékeket gyártani rajta.

-

válasz

Firestormhun

#14216

üzenetére

Firestormhun

#14216

üzenetére

Erre kell majd spórolni és megvenni... remélem tényleg jön majd Q1be.

-

westlake

félisten

válasz

Firestormhun

#14107

üzenetére

Firestormhun

#14107

üzenetére

Bla-bla-bla.

Sok szerencsét a nettó 185.000 forintos vásárláshoz. -

Csabro

tag

válasz

Firestormhun

#14107

üzenetére

Firestormhun

#14107

üzenetére

Akkor most tenyleg 649dodo lett vegul?

-

Jack@l

veterán

válasz

Firestormhun

#13435

üzenetére

Firestormhun

#13435

üzenetére

Ez így nem túl combos.

Ha se duppla pontosság, se 4k-ra alkalmas kártyát nem adnak ki, elég kevés vevő lesz 1300 dodóért... -

gainwardgs

veterán

válasz

Firestormhun

#13435

üzenetére

Firestormhun

#13435

üzenetére

Hát ennél többet vártam én is ezt a szintet az új radeon simán hozni fogja, sőt

-

daveoff

veterán

válasz

Firestormhun

#13435

üzenetére

Firestormhun

#13435

üzenetére

Hát.......999$-ért én többet vártam...

-

Crytek

nagyúr

válasz

Firestormhun

#13435

üzenetére

Firestormhun

#13435

üzenetére

Gyenge ,azt hittem legalább 40-50%-al elveri majd a 980-at!

-

Malibutomi

nagyúr

válasz

Firestormhun

#13412

üzenetére

Firestormhun

#13412

üzenetére

A 285 meg fele akkora sávszéllel ~25%-ot ver a 290-re, szóval akár igaza is lehet Abunak.

-

Crytek

nagyúr

válasz

Firestormhun

#13271

üzenetére

Firestormhun

#13271

üzenetére

Te fel a kezét aki ezen csodálkozik! Aki tud az tud, ennyit számít egy jó VGA széria!

-

lenox

veterán

válasz

Firestormhun

#13193

üzenetére

Firestormhun

#13193

üzenetére

Engineering sample-ok mar kint vannak.

-

Anubris

őstag

válasz

Firestormhun

#13193

üzenetére

Firestormhun

#13193

üzenetére

Képzelem milyen árban lesz ez az új Titan.

-

Crytek

nagyúr

válasz

Firestormhun

#12930

üzenetére

Firestormhun

#12930

üzenetére

Nos ha valoban ott van a 970 a 290x nyakán néhol unciát felette és igaz a 88k + áfa ár akkor world greatest best buy ever lesz

Bár szerintem 115 k alatt nem lesz 970 ilyen erővel

-

smkb

őstag

válasz

Firestormhun

#12930

üzenetére

Firestormhun

#12930

üzenetére

Dzsííííz.... azok a fogyasztási adatok.. uhh 150w minusz a 290X-hez képest ....

-

Jack@l

veterán

válasz

Firestormhun

#12808

üzenetére

Firestormhun

#12808

üzenetére

Mi a manó, már ráfeküdtek az opencl-re is? CUDA-sból is kellene valami hasonló.

Előrelépést sejtettem compute-al, de ez most kellemesen meglepett(ha true story). -

Crytek

nagyúr

válasz

Firestormhun

#12811

üzenetére

Firestormhun

#12811

üzenetére

180+ K és 120+ K

Elég húzós ,de legalább 290X árát csökkenti az ati bár ha úgy mint most a 770-ét akkor gyak nálunk nem is csökken

-

Crytek

nagyúr

válasz

Firestormhun

#12808

üzenetére

Firestormhun

#12808

üzenetére

Ez miféle teszt hogyan,hol ,link? Tárgytalan nv belső mérés megtaláltam!

-

westlake

félisten

válasz

Firestormhun

#12764

üzenetére

Firestormhun

#12764

üzenetére

Az 512 MB-os memória IC-ket meg sem említed?

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Loha

veterán

válasz

Firestormhun

#12721

üzenetére

Firestormhun

#12721

üzenetére

Érdekes, mert ezek alapján akkor a 970 inkább a 4GB-os 770 utódja lesz, mert lassabb a 780-nál, amit a 980 vált és nem jön semmi a 780 Ti helyére, de akkor meg ugye mik ezek a magas magyar árak?

A 2GB-os 770 árát most vitték le 275$-ra, a 4GB-os 400$ körül van, a 780 meg 500$.

Lehet akkor igaz lesz a 400 és 500$-os pletyka... -

Locutus

veterán

válasz

Firestormhun

#12721

üzenetére

Firestormhun

#12721

üzenetére

Az GALAX, nem Galaxy

Biztos a chip is ndivia rajta

-

mcwolf79

veterán

válasz

Firestormhun

#12688

üzenetére

Firestormhun

#12688

üzenetére

Persze, én sem azért írtam.

Tapasztalatból tudom, hogy a 780 kevésbé melegszik és kevesebbet fogyaszt. Ha valaki rászánja a többletköltséget a 780Ti a nyerő (ha csak a teljesítményt nézzük), ár/érték arányban már árnyaltabb a kép. -

mcwolf79

veterán

válasz

Firestormhun

#12681

üzenetére

Firestormhun

#12681

üzenetére

"sokat fogyasztó és szétmelegedő R9 290(x) termékcsaládot"

Részben igazad van, de sztem aki 290(X) -et vesz az lexarja a fogyasztást (én sem xarom a pénzt, de még én sem foglalkozok vele, hogy mennyivel fogyaszt többet,mint anno a 780-am). A melegedés pedig csak refhűtő esetén áll fenn (amit csak launch-kor vettek az emberek, ma már csak az vesz refhűtős AMD-t, aki alapból cseréli rajta a hűtést).

Az árkülönbözetből (780Ti vs 290X -> kb. 30-40 %-kal drágább a 780) sokáig lehet kompenzálni az áramszámlát, melegedést tekintve pedig lásd. fenti szösszenetet. Persze aki maximalista ,az NV-t vesz (mert azért valamivel gyorsabb,mint az AMD VGA-k. Kérdés, hogy kinek éri meg a felár? -

TTomax

félisten

válasz

Firestormhun

#12681

üzenetére

Firestormhun

#12681

üzenetére

Ezt ennél szebben én sem tudtam volna leírni...amen.

-

hokuszla

senior tag

válasz

Firestormhun

#12681

üzenetére

Firestormhun

#12681

üzenetére

jaja

A 980 hűvösen, halkan 100 wattal kevesebbet fogyasztva megveri a 290x-et.

Ennél többet nem is kell tudnia. -

Locutus

veterán

válasz

Firestormhun

#12646

üzenetére

Firestormhun

#12646

üzenetére

Tegyük hozzá, hogy az egész a geizhals.at keresőből származik, ami kb olyan hiteles, mintha itthon az argep.hu ír ki adatokat valamiről...

-

válasz

Firestormhun

#12646

üzenetére

Firestormhun

#12646

üzenetére

az érdekesen néz ki. a shaderek számában van logika, de a 64 ROP némileg meglepő. mondjuk tetszene, mert akkor van sansz egy normális backenddel rendelkező 960-ra

-

válasz

Firestormhun

#12646

üzenetére

Firestormhun

#12646

üzenetére

Nem hangzik rosszul, meglátjuk, hogy ennyi szuflával mit tud a Maxwell.

-

Mans20

addikt

válasz

Firestormhun

#12646

üzenetére

Firestormhun

#12646

üzenetére

Drágaszágok.Remélem a 950 tavasszal jön,mert most akarok 750-et.

-

Ubran

tag

válasz

Firestormhun

#12526

üzenetére

Firestormhun

#12526

üzenetére

Es March 25, 9 am, pedig mar megorultem

-

Firestormhun

senior tag

válasz

Firestormhun

#12526

üzenetére

Firestormhun

#12526

üzenetére

Közben kiderült, hogy ezek a témák csak egy user wishlistje neogaf fórumról...

-

TTomax

félisten

válasz

Firestormhun

#12335

üzenetére

Firestormhun

#12335

üzenetére

Aham,ez lesz az R9 290 ellenfele...

-

regener

veterán

válasz

Firestormhun

#12335

üzenetére

Firestormhun

#12335

üzenetére

OpenCL, CUDA és PhysX nélküli nV kari?

-

TESCO-Zsömle

titán

válasz

Firestormhun

#12329

üzenetére

Firestormhun

#12329

üzenetére

Egy VR-headset miként befolyásolná a high-end VGA-szegmens árazását?

-

Loha

veterán

válasz

Firestormhun

#12322

üzenetére

Firestormhun

#12322

üzenetére

Ez a lista elég valószínűnek néz ki SZVSZ.

Elég jó lehet már a kihozatal, ha be mernek vállalni egy teljesen unlockolt magasabb órajelű GK110-et a GK180 személyében. -

FireKeeper

nagyúr

válasz

Firestormhun

#12185

üzenetére

Firestormhun

#12185

üzenetére

már kezdem azt hinni hogy ezek szándékosan a kedvenc játékaimat "karolják fel"

-

tombar

senior tag

válasz

Firestormhun

#12186

üzenetére

Firestormhun

#12186

üzenetére

nagyon remélem h nem csak logóként lesz jelen, hanem rendesen kiaknázzák az előnyöket. szívesen ltnám őket pl egy optimalizálásban jeles gta5ben is

remélem a dice nem fog elkurvulni és bf4 is rendes duál partnerprogramos lesz.

remélem a dice nem fog elkurvulni és bf4 is rendes duál partnerprogramos lesz. -

Rexcor

őstag

válasz

Firestormhun

#12186

üzenetére

Firestormhun

#12186

üzenetére

Ez egy nagyon jó hír számomra.

-

TESCO-Zsömle

titán

válasz

Firestormhun

#12186

üzenetére

Firestormhun

#12186

üzenetére

Akkor egyre több játék lesz, amiben nem megy a CF vagy lagol Radeonon...

Witcher 3-at előre sajnálom... Kár érte...

-

Firestormhun

senior tag

válasz

Firestormhun

#12185

üzenetére

Firestormhun

#12185

üzenetére

Sőt... Újra teljes gőzre kapcsolják a The Way It's Meant to be Played programot:

NVIDIA Reiterates Dedication to Gaming on PC, Working with Developers

-

TESCO-Zsömle

titán

válasz

Firestormhun

#12098

üzenetére

Firestormhun

#12098

üzenetére

Tesla K20X - 2688 Cuda Core

Emellett a Tesla (és Quadro) kártyáknak sokkal szigorúbb stabilitási és fogyasztási normáknak kell megfelelniük, mint egy GeForce-nak. Az ,hogy működik egy GPU-ban a szükséges mennyiségű egység még önmagában nem elég, ha ezt az előírtnál nagyobb fogyasztással vagy ingadozással teszi, akkor lapát...

-

KillerKollar

őstag

válasz

Firestormhun

#12091

üzenetére

Firestormhun

#12091

üzenetére

Megvárnám akkor már inkább a HD 8000-eket de azok meg ősszel jönnek csak...nem értem miért nem egyszerre adják ki a kártyákat így mindig az lesz hogy most kijön az NV,ősszel kiad valami gyorsabbat az AMD de utána fél évre rá megint jön az NV valamivel ami veri az AMD-t és így megy tovább,fél évente egymásra licitálnak,de pl ha az embert csúcskártyát vesz akkor az az elvárása hogy legalább 1 évig az legyen a csúcs és ne legyen jobb,ezért most ha kb 1 hónap különbség lenne a GTX 700-asok és HD 8000-esek között megvárnám és azt venném amelyik a leggyorsabb legjobban megéri...bár ha ott is 240 lenne a 8970 akkor egyiket sem...

-

KillerKollar

őstag

válasz

Firestormhun

#12085

üzenetére

Firestormhun

#12085

üzenetére

240k ez most vicc?...a Titánt már 270-280ért lehet kapni...És az elvileg egy hűdelimitált hűde exkluzív akármi ez meg azért mégiscsak egy sima 1 GPU-s kártya...Arról nem is beszélve hogy a 700 dollár 15%-al több mint a 600,a 240k viszont 30-al mint a 170 k ebből kiindulva ha 600 dollár esetén lenne 170k akkor 700 dollár esetén ~195 és nem 240...Úgyhogy akkor inkább 800 dollár ha 240 lesz,viszont akkor senki nem fogja megvenni ezt a szart...a Titán egy egyedi presztízs kártya,ami fanatikusoknak készült,a 780 viszont egy "átlagos" csúcskártya amiből minden évben jön új ráadásul ez még nem is új architektúra,azok akik abszolút fanatikusok és csúcsgép kell nekik nem veszik majd meg mert már vettek Titan SLI-t vagy ha nem de látják hogy csak ekkora az árkülönbség akkor majd fognak...Az átlagabb felhasználók meg akik még vettek egy single 680-at a gépükbe biztos nem ezt veszik majd hanem a 770-et ami majdnem fele ennyibe kerül és azért annyival nem lassabb mint a 780...

-

KillerKollar

őstag

válasz

Firestormhun

#12083

üzenetére

Firestormhun

#12083

üzenetére

[link]

Eszerint elvileg "csak" $599.De ez sem hivatalos bejelentés még ahogy írják. -

tome.jr

addikt

válasz

Firestormhun

#11670

üzenetére

Firestormhun

#11670

üzenetére

Szép, azt hozza amiről szó volt, átlagban 10 %-kal marad el a 690-től. Full Hd-ban lehet még közelebb is lesz.

-

Sonja

nagyúr

válasz

Firestormhun

#11670

üzenetére

Firestormhun

#11670

üzenetére

Nagyon jó eredmények 1600p-ben!

Soha a büdös életben nem lesz vidkártyára ennyi pénzem, de nagyon jó nézni.

Soha a büdös életben nem lesz vidkártyára ennyi pénzem, de nagyon jó nézni.

-

Abu85

HÁZIGAZDA

válasz

Firestormhun

#10785

üzenetére

Firestormhun

#10785

üzenetére

A F.E.A.R. példák rosszak. Az első rész után a kettőben megváltozott a render. Amit az első részben használt azt kukázták, de helyette áttértek a Valve-féle Ambient Cube rendszerére, vagyis az új játékba épített megvilágítási modell jóval modernebb volt. Tehát összességében előrelépés volt. Az első részben használt SH (spherical harmonics) modell sok memóriát evett, és nem mutatott jól specular mapok mellett. Ezt lecserélni az Ambient Cube megoldásra nem volt rossz ötlet.

Az Assasin's Creed 1 esetében valóban tartalmazott egy hibát a DX10/10.1-es kód. Ezt persze lehetett volna javítani is, de inkább a DX10/10.1 törlését választották a fejlesztők. Tervben volt a javítás utáni visszarakás, de nem történt meg. Akkor a Gaming Evolved program még nem létezett, szóval nem volt támogatás az AMD-től, hogy visszakerüljön. Az NV meg hülye lett volna támogatni a visszarakást, hiszen nagyon jó példa volt arra, hogy a DX10.1 milyen értékes.

Az Assasin's Creed 2 esetében már eleve nem döntöttek a DX10/10.1 implementálása mellett. Igazából ezzel nincs gond. A fejlesztőnek joga van ezt eldönteni.A Chrome 4 esetében a DX10 eleve nem volt tervben. A 3-ban azért volt DX10, mert sok dolgot azzal lehetett hatékonyan megoldani. A 4-es motorban már alapvető változások voltak, így elég volt a DX9 is. A legújabb Chrome 5 már támogat DX11 kódot is. Aki licenceli ezt a motort nyugodtan építhet rá, ugyanakkor ez a kódbázis csak gyorsít, de a DX9 is elég gyors, szóval a Techland nem vetette be az eddigi játékokban.

A CryEngine 3-ból sosem hiányzott semmi, amit a 2 tudott. Egyszerűen a Crysis 2-höz nem használták fel. Nem ritka, hogy egy motor sokkal többet tud annál, mint amennyit kihasznál a rá épülő játék. Ez nem a motor problémája, hanem a fejlesztő hanyagsága. A Crysis 2 iskolapéldája, hogy mit nem szabad csinálni, de ettől a CryEngine 3 nem lett rossz motor, vagy visszalépés, csak a Crysis 2-nél meghozott értelmetlen és technikailag megalapozatlan fejlesztői döntések miatt tűnik annak.

-

Löncsi

őstag

válasz

Firestormhun

#10785

üzenetére

Firestormhun

#10785

üzenetére

Az, hogy mit tud a motor és mit látsz a játékban, két külön dolog.

Cryengine 2 óta van parallax, ezt később sem vették ki, Cryengine 3-ban is van natív DX11. -

Löncsi

őstag

válasz

Firestormhun

#10772

üzenetére

Firestormhun

#10772

üzenetére

Ez hülyeség, a motorok nem fejlődnek visszafele. Cryengine 3 is elég jól néz ki és hatékonyabb. [link]

Pl. HD4850-en egy Crysis 2 jobban festett mint egy Crysis 1 High-on. Csak ciki, hogy a VGA-k is fejlődnek, így egy GTX460-on a Crysis 1 már sokkal ütősebben néz ki max-on. Crysis 2-ben már nincs előnye lévén a grafika limitálva lett.

Chrome Engine amúgy nagyon jó, Unreal Engine-hez ez áll a legközelebb hatékonyságban, jó lenne ha több gém is ezen futna.

-

Abu85

HÁZIGAZDA

válasz

Firestormhun

#10772

üzenetére

Firestormhun

#10772

üzenetére

Ebben félig van csak ráció. A másik fele a dolognak az, hogy a játékok fejlesztésére költött anyagi befektetés nem nőhet egyenes arányban a grafika fejlődésével. Ez fogja inkább vissza a fejlődést és nem pont a konzol. Ma már rengeteg olyan DX11-es játék jön, ami olyan eljárásokat használ, amit konzolba be sem lehet építeni. Nyilván elvben megoldható, csak nincs meg hozzá a teljesítmény. A GPU-k pedig lehetnek 30x gyorsabbak is (már bőven azok), addig ez nem ér semmit, amíg a művészi munkába fektetett anyagi- és humánerőforrás nem lesz 30x nagyobb. Erre tök jó példa a Samaritan demó. Ha lenne három év egy útcasarkot pofozgatni, akkor ma minden játék úgy nézne ki PC-n. Három év azonban egy teljes játéktérre sincs, szóval keresni kell olyan megoldásokat, amivel gyorsabban kreálható a tartalom. Carmack ezért megy a megatextúrázás és a megageometria felé, mert ez egy ilyen megoldás. Rögös az út persze, nagyon nem fekszik a dolog a CPU.nak + a lassú külső buszon bekötött GPU-nak (ezzel a textúra tile-ok folyamatos másolgatásának a rendszermemória és a VRAM között), de elméletben ott az előny, és az integráció fejlődésével a gyakorlatban is ott lesz. Aztán kiegészíthető ez a Ptexszel, ami ténylegesen pár kattintásra csökkent a mai textúraformátumok mellett sokszor órákig tartó munkát. Csak így lehet jelentősen előrelépni, mert a költségek és a befektetett humánerőforrás drasztikus növelése szerintem nem jó út, már csak anyagilag sem.

Mindig van különbség, csak az effektet ismerni kell, hogy azt hol keresd. A technika implementációja pedig jellemzően a fejlesztőktől függ. Sok olyan opció van egyébként, ami régóta létezik, de csak most kezdik alkalmazni, hogy megérkezett az ALU Power. Ilyen például az SSDO. Ez teljes felbontás mellett a Nexuizban van először. A Crysis 2 is támogatta, de negyedelt felbontással, nyilván van egy combosabb compute igénye, szóval nem árt finoman bánni vele. A különbség viszont nagyon szembeötlő:

On [link] - Off [link]Az OpenGL támogatásának csökkenése nem a konzolok hagyatéka. Egyik konzol sem használ PC-s API-t, szóval teljesen irreleváns a PC-s API kiválasztásnál a port. Amiért az OpenGL hanyatlott az a DX10-es reformok. Pont azt hozta amire a fejlesztők vágytak, ezzel viszont teljesen megölték a visszafelé kompatibilítást. Az OpenGL nem tud elszakadni a kompatibilitástól, így sajnos görgeti maga előtt azokat a problémákat, amitől az MS megszabadította a DX-et. Ettől persze nem lesz rossz API, sőt, nagyon jó, de a DX most jobb.

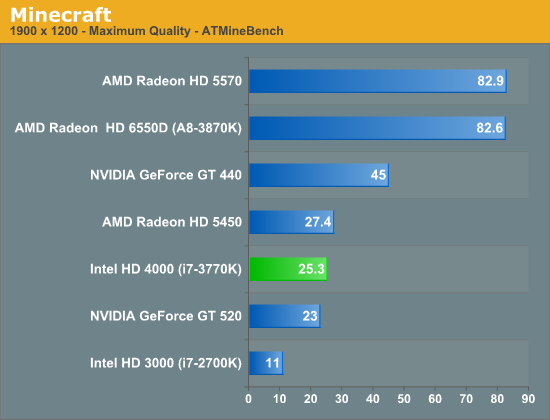

Az AMD az OpenGL visszaszorulásának egyáltalán nem örül. Az OpenGL driver náluk nagy változáson ment át az elmúlt 7 évben. Az egészet az Orca (OpenGL) driver indította el, ami a Catalyst 7.1-ben mutatkozott be. A régi driver felújításaként a sebesség marha jó volt, de a stabilitás már nem. Ezután döntött úgy az AMD (ekkor ugye már megvették őket), hogy ezt a sebességet kell hozni stabilan. Kétfelé ágazott tehát a projekt. Az Orca funkcionális fejlesztése tovább zajlott, de a nagyobb project az OpenGL driver újraírása a nulláról. Ez a projekt 2010 októberében készült el, amikor megérkezett a FirePro kártyákhoz a 8.773-as driver. Ezzel a korábbi driverhez képest 446%-os teljesítménynövekedést sikerült elérni egy v7800-on, ami az akkori csúcs volt. És ami a legfontosabb, hogy a stabilitás is elképesztően fejlődött. Ezután kezdték a FirePro termékek megkapni a programcertifikációkat, mert funkcionálisan szuper volt a működés. A konzumer termékeknél a mainline kódba 11.3-as driverben került bele ez az OpenGL driver. Ennek az eredménye, hogy a Radeonok így teljesítenek a MineCraftban:

A GeForce GT 440-nél nem gyorsabb a HD 5570 majdnem kétszer (DX-ben kb. egy szinten teljesítenek, kicsit gyorsabb a GeForce), és az A10-3870K sem gyorsabb 3,5x az i7-3770K-nál (úgy átlag 20-40%-kal gyorsabb "csak" az Intelnél). Ami ezeket az eredményeket hozza az AMD-nél az a nulláról újraírt OpenGL driver előnye.

Az AMD pechére ennek játékokban már nem nagyon lesz hozománya, mert a DX elhúzott. Persze a professzionális piacon jól jön majd a driver, szóval nem kidobott pénz és idő ... de azt mondani, hogy az AMD szerencséjére nincs sok OpenGL játék ... hát, ennek ők ennyi befektetett munka után egyáltalán nem örülnek.Az természetes, hogy a GE és a TWIMTBP programoknál más lesz a grafika fejlesztési szempontja, de mi van a Ghost Recon Future Soldierrel? Az is olyasmi eredményeket ad, mint a DiRT Showdown és semelyik partnerprogramnak sem volt része. A helyzet az, hogy a fejlesztőknek is a compute irány volt a lényeges, hiszen a Fermi erre ment. A GCN látták, hogy erre megy. Általánosan kimutatható volt, hogy az architektúrák compute hatékonysága nő. Az Intel a Gen7 architektúrát ebbe az irányba vitte. Az MS hozza a shader-trace interfészt, hogy egyre bonyolultabb compute shadereket lehessen írni, hiszen egyrészt kapják a fejlesztőktől az igénylést, és látják, hogy a GPU-k merre mennek. Ezek alapján ki gondolta volna azt, hogy az NV nem erre megy a Keplerrel ... valójában senki. Alapvetően a Kepler és a GCN különbsége nem nekünk okoz nagy fejtörést. Persze a kasszánál is gond, hiszen nehéz dönteni. De képzeld el a fejlesztőket, akik követték a napnál is világosabb trendet, és jön egy architektúra, ami hirtelen felrúgja azt. Na az ő helyzetük nem könnyű ... a Ghost Recon Future Soldier esetében azt választották, hogy hagyják a GI effektet úgy ahogy van. Ha lassú lenne, akkor majd a felhasználó kikapcsolja. Valószínű, hogy nem csak ők követik ezt az utat. Persze ott van ellenpéldának a BF3, amiből kivették a compute shaderes extra effekteket, de ez csak elővigyázatosság volt, mert maga a motor működése nagyon épít az LDS terhelésére. A Kepler kipróbálása nélkül lehetetlen volt megállapítani, hogy mennyire rázná meg a terméket, ha a Tile-based deferred acceleration mellett még mondjuk egy HDAO is ostromolná az LDS-t. Mivel a Tile-based deferred acceleration nagyon a működés része, és DX11 alatt ki sem kapcsolható, így nem ártott ügyelni erre. Gondolom az NV korábban megmondta nekik, hogy úgy csinálják a rendszert, hogy a Kepler a Fermi shared memory tempójának a harmadára képes. Ma már lehet, hogy másképp alakul a dolog, hiszen van mivel tesztelni. 2011 őszén nem volt.

-

Abu85

HÁZIGAZDA

válasz

Firestormhun

#10770

üzenetére

Firestormhun

#10770

üzenetére

Egyáltalán nem így van. A VGA-piac és a VGA-kat gyártó cégek üzleti érdeke másodlagos egy grafikus motor fejlesztésénél. A legfontosabb, hogy az megfeleljen az előre kitűzött igényeknek. Ha a hardverek még nem készek rá, akkor sem baj, mert a grafikában az a jó, hogy skálázható.

Az előre kitűzött célok természetesen függnek attól, hogy a grafikus processzorok általánosan milyen irányba fejlődnek. Csak pár példa. Régen minden motor forward render volt. Ez megfelelt a 2004-2006 előtti igényeknek, de felfigyeltek arra a fejlesztők, hogy a memória-sávszélesség arányaiban gyorsabban nő, mint a számítási teljesítmény. Éppen ezért a ahelyett, hogy dolgoztak volna olyan forward render eljárásokon, mely jóval több pontfényforrást kezel hatékonyan, elkezdték a deferred render felé fordítani a figyelmet. A 2000-es évek közepén ez sem volt új dolog, alapvetően régóta létező technika, csak régen a forward render jobb volt. A deferred render algoritmusok mellett megnőtt a memóriahasználat, de ez nem volt gond, mert a memória kapacitása és sávszélessége ekkor egy boomot élt meg. Marha gyorsan jött a GDDR3-GDDR4-GDDR5 egymás után, és a lapkák is relatíve olcsók voltak. Persze a deferred render algoritmusok hozták a limitációkat is, mint az MSAA normális támogatásának hiánya, illetve megnehezítette a munkát a limitált lehetőségek a felületi variációkra. Ugyanakkor a forward renderhez képest előny volt a rengeteg pontfényforrás hatékonyabb számítása és a hatékonyabb árnyalás. Mára elértünk oda, hogy szinte minden motor valamilyen deferred render eljárással dolgozik (van sok: defered shading, full és partial deferred lighting, Tile-based deferred acceleration) ... illetve elenyésző számban azért még vannak forward render motorok. Manapság megint egy változás történik. A memória-sávszélesség arányaiban lassabban növekszik, mint a számítási teljesítmény, és ezzel a mutatóval újra a forward render kerül előtérbe (ez amúgy is célszerű, mert az offline renderek forward eljárást használnak, hiszen így a művészek keze nincs annyira megkötve). Az új forward+ lighting eljárás már hatékonyabban kezel ugyanannyi pontfényforrást, mint bármely deferred render, illetve működik rajta az MSAA, nem limitálja a felületi variációkat, és az átlátszóság is egyszerűbben képezhető le. Az árnyalás fázisa ugyan lassabb forward elvvel, mint defereddel, de a lighting fázisnál bőven gyorsabb a forward, így összességében jobb.

Nyilván aki forward render motort használ opciós lehetőségként tekint a forward+ lighting eljárásra. A deferred render motorok esetében is lesz egy kis segítség itt. Ide is be lehet ágyazni a forward+ eljárás egy részét, amivel növelhető a grafika minősége. Ez persze csak egy gyors reakció a növekvő művészi igényekre, de valójában brutál compute és sávszélesség igényes, szóval amellett, hogy grafikai minőség szempontjából előny, a sebességben nagyon meg lesz az ára. Csak akkor érdemes bevetni, ha a művészek tényleg igénylik a jobb grafika kialakításához.

Ebből azért lejöhet, hogy a fejlesztések fő mozgatórugója a művészi munka szabadabbá tétele, illetve a reakció a hardverek egyes képességeinek hosszútávú változására. Pl. mi nő gyorsabban, a számítási teljesítmény, vagy a memória-sávszélesség. -

Abu85

HÁZIGAZDA

válasz

Firestormhun

#186

üzenetére

Firestormhun

#186

üzenetére

Mit ér a könnyű programozhatóság, ha még egyszer ... netán kétszer el kell készíteni ugyanazt a többi vállalat rendszerére?

Ezek előre lefutott körök. Eddig minden olyan platform behalt, amit nem támogattak globálisan a legnagyobb vállalatok. Egyedül az NV édeskevés, az AMD-vel, vagy az Intellel lenne esélyük, de mindkét vállalat tudja, hogy ha a CUDA-t nem támogatják, akkor az NV-vel nem kell számolni hosszútávon.

Többiek hol vannak? Szerinted min futott a Havok bemutató a GDC-n? Csak nem Radeonon? Bezony a Radeon már képes futtatni az OpenCL kódot december óta. Lebecsülöd őket. Az AMD-nek már kettő WHQL drivere is van Win 7-re ... az NV-nek van? Az, hogy az AMD nem jelenti be, nem azt jelenti, hogy nekik még nincs kész a meghajtójuk. Az NV azért jelent be minden jelentéktelen, vagy házi feladat fejlesztést, mert mindenki arról beszél, hogy a Radeonok elpicsázzák a GeForce-okat. Kell néha olyan téma, ahol nem kell fikázni a GeForce-ot.

Az NV bizony mindent feltett a CUDA-ra, azért vannak most ilyen ramaty helyzetben, mert a platform nem terjedt el. Az eredeti tervek szerint már CUDA-ra kellene írni a játékokat, ehelyett mindenki bontja fel a TWIMTBP szerződést. Ha annyira érdekli őket a VGA piac, miért az AMD publikálja a fejlett DX10 eljárásokat? Ellentmondások és ellentmondások. Az NV eltaktikázta magát, és most fut a pénze után.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az NVIDIA éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- LG 34WN750-B - 34" IPS - 3440x1440 WQHD - 75Hz 5ms - FreeSync - HDR 10 - Hangszórók - sRGB 99%

- ÁRGARANCIA!Épített KomPhone Ryzen 7 5800X 32/64GB RAM RX 7700 XT 12GB GAMER PC termékbeszámítással

- ÁRGARANCIA! Épített KomPhone Ryzen 5 9600X 32/64GB RTX 5070 12GB GAMER PC termékbeszámítással

- BESZÁMÍTÁS! Intel Core i9 13900K 24 mag 32 szál processzor garanciával hibátlan működéssel

- GIGABYTE B650 UD AX WiFi AM5 DDR5 alaplap bontatlan csomagolásban 3 év garancia 27% áfa

Állásajánlatok

Cég: Laptopszaki Kft.

Város: Budapest

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

az jó sok idő még mindig

az jó sok idő még mindig

remélem a dice nem fog elkurvulni és bf4 is rendes duál partnerprogramos lesz.

remélem a dice nem fog elkurvulni és bf4 is rendes duál partnerprogramos lesz.