-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

A GT200-ban csak a TCP-k használnak közös memóriát, de például a stream egységek is külön regiszterterülettel rendelkeznek. A Larrabee előnye a DP, az NV erre még mindig egy dedikált egységet alkalmaz a TCP blokkban. Ezután attól függ a Larrabee sikere, hogy az NV marad-e ennél a felállásnál, vagy változtatnak. Ha marad a dedikált egység, akkor DP-ben továbbra is nagyon le lesznek maradva, ha pedig a DP-re rágyúrnak, akkor a chip méretei kolosszálisak lesznek, és a PC-s VGA piacon gyakorlatilag semmi esélye nem lesz. Nyilván VGA szinten sok haszna nincs a DP-nek, de a tranyót azt keményen zabálja.

Ne az NV GPU-ira gondolj, azok túl vannak méretezve, mivel a GPGPU piacot is lefedik. Nézz meg egy RV670-RV770 fejlődési vonalat. A magméret alig nőtt a teljesítmény viszont brutálisan. Az RV740 magasan a legjobb teljesítmény/mm^2 mutatókkal rendelkezik, az NV GPU-k ezt meg sem közelítik. Ez a mutató az AMD ígérete szerint generációnként radikálisan nő, ami eddig meg is történt, tehát mire eljutnak 2011-ben az integrált GPU-s CPU-ig, addigra 32 nm-en 100 mm^2 alatt tudják hozni a jelenlegi HD 4870 X2 sebességét. Nyilván ez, akkor kvázi megfelel majd annak a szintnek, amit most a HD 4850 képvisel. A memória alrendszer meg meg van oldva az alaplapon. Ugyanolyan nyák, mint a VGA nyákja, semeddig nem tart oda dedikált memóriákat pakolni.

Az AMD és az Intel nem azért indul ebbe az irányba, hogy nekünk jó legyen, egyszerűen jobbak a lehetőségeik platformszinten, ráadásul ezzel a lépéssel az NV-vel sem kell törődni többet. A diszkrét kártyákra való igény durván visszaesik, most látható ennek a hatása, az NV máris helyezi át az erőforrásokat az új piacokba.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Szerintem, valamit félreértettél.

Nyilván nem ugyanaz a GPU lesz minden prociban. A kicsikben kis VGA, nagyokban nagyobb VGA.

Amelyik proci mellé vennél egy 100 dodó alatti VGA-t, abba belerakják majd az oda való GPU-t.

Nyilván, ez szűkíti a variálási lehetőségeket, de ez szerintem több ember számára előny az egyszerűség miatt, mint ahány számára hátrány.

Valszeg, több proci típpus lesz, mint manapság.[ Szerkesztve ]

Eladó régi hardverek: https://hardverapro.hu/apro/sok_regi_kutyu/friss.html

-

-

Erre a kérdésre nekem az ugrott be, hogy használhatja a CPU-nak szánt rendszermemóriát is (olcsó procik esetére), esetleg hagynak külön foglalatokat a GPU memória számára, vagy inkább a PCI-E slotba lehet majd RAM chipekkel tele aggatott kártyát tenni (igény szerint, ha nem elégszel meg az osztott memóriával) , ha már úgy is a CPU-ba kerül a PCI-E vezérlő is. Bár ez elég nyakatekert dolog, mert miért ne lehetne szerencsétlen GPU is a bővítő kártyán, ahelyett, hogy a CPU magok mellé zsúfolják, aztán hűtsed léggel. Számomra is hihetetlen, hogy ez ne nyírná ki a grafika fejlődését. Highend-hez úgy is bővítő kártya kell, az Nv pedig mostanában csak azt csinált (9600GT óta). Software render-hez meg már eleve nem kell a GPU mag se, csak 2-3 sok magos CPU az alaplapra, de akkor a Larabee is öngól lenne. Vagy külön alaplapi foglalatba pakolgatjuk azokat is, nem a PCI-E-be, mint egy VGA-t? Larabee szerűséget is tud csinálni az nv is, ha bővítő kártya is lehet. Á, valami sántít még itt a jóspropaganda ködös homálya mögött...

[ Szerkesztve ]

TV/monitor kalibrálást vállalok. ||| "All right , Thom. But understand this: I do care for you. I care for all the lost souls than end up up here."

-

hugo chávez

aktív tag

Szerintem is inkább a 25-30 dollár körüli belépő szintű és integrált vga-knak lesz ellenfele, pláne hogy a legtöbb helyen 2011-es megjelenést írnak, bár valamelyik fórumban olvastam egy fejtegetést miszerint, ha már most tape out-ban van, akkor 10-15 hónapon belül piacra dobják, de nem sok olyan terméket láttam, amit hamarabb kiadtak, általában az eredeti megjelenési idejükhöz képest is csúszni szoktak, pl. clarksfield.

"sajnos ez a beszélgetés olyan alacsony szintre jutott, hogy a továbbiakban már nem méltó hozzám" - by Pikari

-

FireGL

aktív tag

A cuda 2.1 nem multi gpu, cuda 2.2 már kezeli a több kártyát, cuda 2.3 az egy kártyán a több gpu-t. Az hogy neked nem működik az nem jelent más mint azt hogy amit használsz szoftvert az nincs felkészítve erre.

Win7-en meg ne csodálkozz...

[ Szerkesztve ]

Az embert a gondolkodás tette állattá...

-

FireGL

aktív tag

CUDA sdk nincs win7 alá egyenlőre, nem is értem hogy fejlesztheted a saját szoftvered ha még ezt sem tudod. Megfelelő sdk nélkül sose fogod működésre bírni a szoftvered. Kezdő programozó vagy ?

Miféle buglistán van rajta ? másold már be ...

másold már be ...Az embert a gondolkodás tette állattá...

-

zack

nagyúr

-

regener

veterán

Mert pl. cikkenként más adatokat "közölnek", eygszer azt állítják hogy lesz 3072 CUDA mag benne, utna csak 28xx, majd 25xx meg így tovább cikkenként. Ezenkívül elég sok "hír"-ükről derült már ki hogy tényleg csak pletyka, semmi háttérrel vagy max amit más oldalakról összeszedtek.

Ha kijön madj akkor úgyis tudni fogjuk mi és mennyiért, addig értelme meg nincs találgatni.

-

Jack@l

veterán

Holnapig csak ki tudjuk már várni minek mi lesz a neve...

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

Az előző két generációban 60-70% volt az előrelépés a 04-es chipek között - az pusztán a 40%-kal több ALU-ból nehezen lesz. Ezért írtam, hogy kíváncsi vagyok, mit kezdenek a backenddel - ha marad a 256/64, akkor hiába a gyorsabb memória, nem fogja tartani a lépést a számítási kapacitással.

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

-

Igen, akkor a 02-es HBM és 128 ROP. Hogy miért érné meg? Akkor van ennek értelme, ha az nVidia fenn akarja tartani az elmúlt évek menetrendjét, ahol a 600-700 USD-s ársávban évente kiad egy erősebb kártyát, generációnként kettőt. És mikor akarja fenntartani? Természetesen akkor, ha a profit-előrejelzés ebben az esetben magasabb, mint akkor, ha a Volta alapú GeF csak kisebb előrelépés. Ezt meg a jó ég tudja, meg persze Jensen.

[ Szerkesztve ]

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Bizony, jó cuccok NV nél azok.

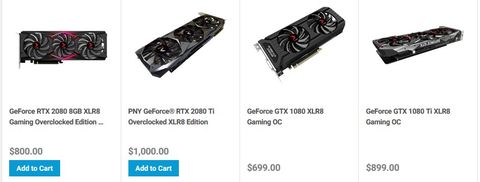

mobal(#18715): Sajnos Szerintem 400 dodó felejtős lesz, épp tegnap tette be valaki ide a véletlenül megjelent RTX árakat. Ha a 2080 800 $ lesz akkor nehéz elhinni, hogy a 2070 400$ áron jön. Ezen infó szerint az 10xx széria+ 100$ az RTX ára. akkor kb 500-550 $ lesz az ára.Szerintem nem fogják hétfőn azt bejelenteni,ha ezek az infók igazak,mert sehol nincs belistázva, render képek sincsenek róla. de ne legyen igazam.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Én nem lettem okosabb az kölni előadástól, szóval továbbra is a 20-30%-os sebességnövekedésre számítok kategórián belül. Talán a 2070 többet tud lépni, mert ott jobban fájt a sávszélesség.

Ebből 2070 > 1080, 2080 <= 1080Ti, 2080Ti kb. annyi, mint a Titan V, bár utóbbinak iszonyúan össze-vissza voltak a számai.(#19758) Ren Hoek: Kepler -> Maxwell attól még lehetett volna, az is +60% volt.

[ Szerkesztve ]

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Funkcionális egységek tekintetében a Titan V ALU-ban 17%-kal erősebb, backendben pedig 9%-kal. Ezzel szemben áll a 2080Ti oldalán a 6%-kal magasabb órajel (az FE 12%-kal) és az egy lépéssel újabb uarch (pár %, gondolom). Ha csak ennyi lenne, akkor azt mondanám, hogy a referencia Ti lassabb, az FE kb. hasonló, viszont driveres téren a Titan V nem úgy tűnt, hogy túl sok törődést kapott volna - ez billentheti a 2080 Ti javára a dolgokat. Vagy nem

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Yany

addikt

Tökéletes videó azt illusztrálni, amit összemakogtam fentebb.

Amúgy egy újabb topik a találgatós topikon belül: NVIDIA forces AIBs to deliver all 10xx cards.

Ez a helyzet viszont elég ügyes megoldásként vetül az NVIDIA árazására. Legyszerűsítve: Valójában ő most nem is akar 20xx kártyákat eladni, hanem kiszórni a kriptobubi miatt megmaradt előző gen. készletet, viszont mivel nem akar bukni rajta, ahhoz, hogy normális áron tehesse ezt meg, ad az új gennek egy eszement árat. Na most aki akarja ennyiért vinni a 20-asokat, hadd vigye (és sokan vannak, ebben biztosak lehetünk, mert aki ennyire rákattant, az ki fogja fizetni), de nem fojtja el az előző gen piacát. Aztán ha leapadt a 10xx készlet, akkor tol egy akciót mindkét generációra és mindenki úgy cuppan rájuk, mintha ingyen adnák.

Kettős hatása van: egyrészt rögzíti mindenki fejében pár hét alatt, hogy bizony a geforce-ok marha drága cuccok (a 10xx is) és amikor akciózni fog, akkor hiába adja még mindig drágábban, mint az AMD, mindenki csak azt fogja látni, hogy mennyre jó áron juthat most hozzá, pedig milyen drága cumók már.

A másik, hogy ha (tegyük fel) senki nem is veszi a 20xx kártyákat, akkor is mit lát az egyszeri nép? Hogy a legeslegjobb a piacon toronymagasan bármelyik NVIDIA zsuga + az RTX brand szépen öregbül a piacon, mindenki elülteti magában a sajtón és beszámolókon keresztül, hogy merre megy a világ és trendet formál belőle.

Szerintem zseniális. Jelenleg egyszerűen nem tud bukni ezen az NVIDIA. A felszínen hasonlónak tűnhet, mint az Intel CPU-k drágulása, de valójában az Intel egy kényszerlépést tett, míg az NVIDIA nagyon ügyesen extrém profitot fog bezsebelni ezekben a hónapokban. Majd figyeljétek az eddig is szép számait a köv. beszámolóknál...

[ Szerkesztve ]

Építs kötélhidat - https://u3d.as/3078

-

Raymond

félisten

Csak arra az egy target felbontasra megy a training. Nem akartam az egeszet bemasolni, a kiemelt resz arra volt hogy illusztralja van ott melo meg azzal az egy target-al is.

Egyebkent gondolom tobbet nyernek 1440->2160 upscale-el teljesitmenyben mint 1080->1440 mert az utobbi kettot a kartyak DLSS nelkul is megoldjak, plusz nehezebb a kisebb felbontasoknal a megcelzott minoseget elerni.

[ Szerkesztve ]

Privat velemeny - keretik nem megkovezni...

-

Raymond

félisten

Semmilyen mas felbontasrol egyelore nem volt szo se ott a linken se mashol. Barhol van a DLSS emlegetve mindenhol csak a 4K-van. Az egyetlen program ahol jelen van (FFXV) ott szinten csak 4K.

Egyebkent ertelme is aranylag keves van kisebb felbontasokon. Attol fuggoen mi is az igazsag hogy a belso render 2880x1620 vagy inkabb 2560x1440 es ez van feskalazva 3840x2160-ra, ilyen aranyok kisebb felbontasoknal aranylag ertelmetlenek. Peldaul 2560x1440 eseteben ez kb. 1920x1080 vagy 1696x952 lenne. Meg a 2060 is a tesztek szerint szepen 60FPS felett van 1440p felbontas mellett is. Nincs igazan ertelme kisebb felbontason renderelni es felskalazni es ez a legkisebb kartya ahol tamogatva van a DLSS.

Lehet 2-3 ev mulva lesz ertelme ennek is, de egyelore eroforraspazarlas lenne a training. En ugy tudtam a 4K-s target training eredmenyet nem tudod hasznalni mas felbontasra.

Privat velemeny - keretik nem megkovezni...

-

Raymond

félisten

En ugy ertettem hogy a cel felbontas a fontos a training-nel es erre megy ki az egesz. Megcsinaljak a 64xSS legjobb minosegu kepet es ezt probaljak megkozeliteni az alacsonyabb felbontasrol. Es itt nem mindegy hogy olyan drasztikus felbontas valtozasok kozott mint 3840x2160 es 2560x1440 megmarad az erdemi info, ott mar aranylag sokat valtozott a kornyezet is. Ha meg nem akkor meg miert nem kinaljak sehol vagy meg csak nem is emlitik hogy "jo lesz 2560x1440-nel is"? Az egyik oka minimum ogy amit irtam - nincs ROI mert ebben a felbontasban minimalis munkaval is nyerjetsz annyit hogy meglegyen a 60FPS ha eppen nem lenne meg egy hajszalnyival. Ha meg mindegy mert fel lehet hasznalni a 4K eredmenyeket akkor miert nincs ez 2560x1440-ben?

Privat velemeny - keretik nem megkovezni...

-

Abu85

HÁZIGAZDA

Egy programot csináltam rá (benchmark), de a sok ígért funkció folyamatos késése miatt éppen portolom Unity-re. Ettől még persze maradt a gépen az UE4 is, de jelen formában az igényeimnek rosszabb, mint a Unity, még akkor is, ha ezen kezdtem el a munkát. Amúgy tökre értékelem az EPIC munkáját. Rolando (aki ugye írja a leképezőt) is nagyon sokat segített a projektemmel, de nem tudom megvárni, amíg az UE4 jó lesz hozzá. Ettől függetlenül ajánlom mindenkinek, aki nem ütközik bele az ideiglenes limitjeibe.

(#24150) Jack@l: Töltsd le a motort és nézd meg, hogy a DX11 a deafult renderer. A Vulkan csak a Linux default leképezője. Az biztos, hogy ez váltja Windowson is a DX11-et, mert ezt mondták a múlt évi GDC-n, csak nem egyhamar. Addig marad a DX11 default.

(#24151) Raymond: Végül is csak tapasztalat alapján döntöttem a váltás mellett.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az NVIDIA éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- GARANCIÁLIS! ASUS TuF RTX 3090 24GB DDR6X OC Videokártya! BeszámítOK

- eMag GARANCIA! ZOTAC Trinity RTX 3080 10GB OC GDDR6X Videokártya! BeszámítOK

- BESZÁMÍTÁS! SAPPHIRE RX 460 2GB GDDR5 videokártya garanciával hibátlan működéssel

- ZOTAC GeForce GTX 1080 AMP Edition 8GB GDDR5X 256bit

- AMD Radeon Pro W7900 48GB GDDR6

másold már be ...

másold már be ...