-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Azt láttam természetesen,de ez az Amperet és Turingot érinti elsősorban és a HU tesztjében levont következtetéssel te sem értettél egyet amibena Dx12 drivert hibáztatják és ezt Igor a saját teszjében ki is zárta.

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

[link] - később leírtam részletesebben a helyzetet. Több tényező van, de a legnagyobb tényező úgy néz ki, hogy a CPU-s emuláció a bekötésnél. Ez kifejezetten érinti azokat a játékokat, amelyek nagy CPU-terheléssel dolgoznak.

Vulkan esetében azért nem létezhet ez a gond, mert ott ez az emulációs réteg hiányzik.

Ettől egyébként lehet, hogy ez a maximum, amit a GeForce-ok tudnak, de azért kételkedek. Sokkal inkább hiszek manapság abban, hogy nagyon drága lenne több teljesítményt kihozni a rendszerből, és ez anyagilag nem érné meg.

#56151 sakal83 : A GCN érában többször megtették. Az RDNA-kkal már nem igazán, az RDNA2-vel meg nem volt rá szükség.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

válasz

Alogonomus

#56152

üzenetére

Alogonomus

#56152

üzenetére

látod barátom, ez a probléma veled.

csaka kedvedért idézek Abu cikkéből : [link]"

A fentieken alapján tehát nem feltétlenül a GeForce meghajtót érdemes bűnösként emlegetni. Talán lehet valamennyit nyerni az adott API implementációjának oldalán is, de ahol az igazi limit keletkezik az a programkód, amit alkalmazásfrissítésekkel lehet módosítani."és ehhez itt van Igor következetese aki szintén erre utal. [link]

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Igor tesztje pont ezt zárja ki. .Szerinte nem néz ki úgy. Ugye fórumban írja ő is hogy szerinte az asszinkron compute ütemezését nem kezeli a szofveres ütemező, ha nincs ráoptimalizálva a működés, márpedig nincs, mert Radeon a fejlesztői környezet.

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Ez baromság. Az asszinkron compute-nak ehhez biztosan semmi köze. Az egy gyorsítást lehetővé tevő eljárás, amit már a Turing elég jól kezelt, de még ha a GeForce-ok nem is fognak valamiért berakni aszinkronba két pipeline-t, akkor sem azt látnád, hogy 1080p-ből 4K-ba tartva javul a skálázódás, hanem pont fordítva, ugyanis az asszinkron compute hiánya pont GPU-limitet eredményez, és nem CPU-limitet.

Ez a gond egy bekötési és erőforrás-kezelési probléma. De semmiképpen sem ütemezési, utóbbival pont 4K-ban mérnél limites szitukat, nem pedig 1080p-ben.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Hát nem rég azt mondtad hogy a SIMA GDDR6 magas árazása is baromság A tegnapI Linus videóban meg 50 % emelkedés mutat be 2021 ben eddig.

Én hiszek Igornak, úgy vagyok vele, bocs ezért. Szerinte csökken a futószalag terhelése magas felbontáson a kevesebb FPS miatt, és azt már el bírja az ütemező. Attól függetlenül, hogy több dologban egyetértek a cikkeidben leírt dolgokkal, de GAI múlt heti tesztje is azt mutatja be, hogy van amiben tévedsz, és van amiben nagyon is igazad van. Az biztos, hogy a radeonos fejlesztői környezet hátrány. de főleg a vegá-k gyenge szereplése Dx 12 alatt ezt mutatják nekem, hogy nem driveres gond ez , illetve azzal ezt megoldani nem lehet.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

A TrendForce az év eleje óta jelzi előre a graphics DRAM áremelkedést, csak még mindig nem látni.

Felőlem hihetsz Igornak, csak hülyeséget beszél. Az asszinkron compute nem úgy működik, ahogy leírja. Ha annak hiány okozna limitet, akkor egyrészt GPU-limitet okozna nem pedig CPU-t (mert a CPU oldaláról a munkafolyamat ugyanaz asszinkron compute-tal és nélküli), másrészt 4K-ban okozna GPU-limitet, nem pedig 1080p-ben CPU-limitet. Pont az ellentétét látod a tesztekben, mint amit az Igor által leírtak alapján látnod kellene.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

nem a hiánya, hanem a többlet terhelés a futószalagon alacsony felbontáson jelent gondot szoftveres ütemezéssel a magasabb FPS szám miatt. Szerinte legalább is,de feltételez főleg, ő is lehetséges okként írja,de úgy mint te is, több lépcsőben gondolkodik. Valószínűleg Nvidiának vissza kellene térnie a hardveres ütemezéshez első lépésben, majd a drivert módosítani ehhez a régebbi konzolos játékokban meg optimalizálni szoftver szintjén, ami valószínűleg nem fog megtörténni soha.

A trendforce hazudik meg Linus és MLID is és Gigabyte is. Hát jó te tudod, ebben nem tudok vitatkozni.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

sakal83

addikt

Maradjunk annyiban hogy az rx480 sem volt jelentosen a 1060 ala arazva sot... Es annak is mar 5 eve.

Ez egy blodseg hogy a szeginy amd most kezdte ezt az nvidiahoz árazást. Nem ertem miert talalsz ki ilyen magyarazatokat. Mind a ket ceg egy profitorientalt gigamulti akik kb meg is beszelik az arakat es ahogy tudjak maximalizaljak kozosen...

Felesleges a gonosz jo felosztast alkalmazni. Nem az nvidiahoz araz az amd hanem bevetelt maximalizal mind a ket ceg.

-

Ez inkább 1440p-ben kezd megszűnni, de nem oda tervezték a 300-400 dollár közötti VGA-kat.

Persze, mert nincs is 300-400 dolláros VGA (nV esetén nagyjából a GTX1660-asok vannak ott).

Az RX6600XT inkább 700+ dolláros VGA, és az megy akkor 1080p-be...

Akkor meg érdemes elgondolkodni azon, hogy ilyen árú VGA mellé milyen CPU-t raksz be.Aki megteheti, hogy mondjuk egy 800-1000 US$-os RX6600XT-t vagy RTX3060-at vegyen, annak aligha fog valami gyatra proci mellett dolgozni.

Ettől még nem egyértelmű számomra az általad leírt eset, mert vannak D3D12 alatt is, ahol nem a CPU limit fogja meg a középszintű VGA-t 1440p-ben. Hogy akad egy marék játék, ahol meg igen, attól még nem feltétlenül látom alátámasztottnak a valós felhasználási feltételek mellett az ilyen markáns kijelentéseket.

Légvédelmisek mottója: Lődd le mind! Majd a földön szétválogatjuk.

-

Alogonomus

őstag

Olvasd azért végig a cikket, és megtalálod, hogy:

"A DirectX 12 esetében tehát klasszikus értelemben nem igazán lehet a meghajtó többletterheléséről beszélni. Ugyan létező jelenségről van szó, de egyáltalán nem olyan jelentős mértékű, mint például a DirectX 11-es API-nál, és pláne nem okozhat ilyen extrém különbségeket, amiket a fenti tesztben lehet látni."

Vagyis Abu szerint a teljes problémát bár nem lehet kizárólag a driver hibájára fogni, de az tény, hogy a probléma jelentkezik az Nvidia kártyákon.

Ráadásul felhívom a figyelmedet Abu az első cikket 2 héttel követő második cikkében szereplő megállapításra:

"Az egyik érdekes információ, hogy bár a DirectX 12 esetében nincs kernel meghajtó, tehát a driver nem futtat egyetlen kernel szerver szálat sem. Ezzel együtt a Microsoft az API implementációjánál elég nagy szabadságot ad a gyártóknak, vagyis amíg egy megfelelő meghajtó képes teljesíteni a hitelesítési tesztet, addig igazából a redmondi óriáscéget nem nagyon zavarja, ha bizonyos funkciókat egy DirectX 12 implementáció csak emulál."

Utánaérdeklődött a jelenségnek, és az új információk alapján egy második cikkben is foglalkozni akart az okok feltárásával. A végmegállapítás pedig a következő lett:

"Ezzel kapcsolatban megpróbáltunk informálódni a fejlesztőknél, és a válaszok alapján arra jutottunk, hogy egyik felvetett gondot sem lehet úgy kiemelni, hogy egyértelműen jelentős CPU-limitet okozna a GeForce-okon gyengébb teljesítményű processzorok mellett. Ellenben a különböző tényezők (Radeonokon való alkalmazásfejlesztés, bizonyos szintű emuláció alkalmazása a DirectX 12 bekötési modelljére, a DirectX 12 meghajtóimplementáció komplexitása, valamint ennek az optimalizálásába fektetett idő relatív módon értékelt rövidsége) hatása esetlegesen összeadódhat, és ezek már okozhatnak olyan limitációt, ami erősebben visszafoghatja a GeForce-ok tempóját bizonyos CPU-kon. Sőt, egyes gondok felerősíthetik egymást."

-

Abu85

HÁZIGAZDA

Az asszinkron compute-nak nincs többletterhelése. A processzor oldalán az asszinkron compute ugyanannyi munka, mint ennek a hiánya. Az asszinkron compute csak azon változtat, hogy a GPU két futószalagot egymással párhuzamosan feldolgoz-e, vagy sem. De a processzor számár az lényegtelen, és semmit sem tud arról, hogy ez megtörténik-e a GPU-n belül vagy sem.

Ez a hardveres ütemezés is egy faszság. Egyrészt az NVIDIA régóta hardveres ütemezést alkalmaz. Ott van a multiprocesszorban az ütemező, ahogy a Gigathread Engine-ben is. Szoftverbe olyan részeit helyezik át az ütemezésnek, amelyek könnyen kezelhetők szoftverből. Ilyet nem csak az NV alkalmaz, hanem az AMD is, mert tökre hasztalan bizonyos függőségeket hardverből kezelni, amikor szoftverből képes vagy előre dekódolt, függőségmentes folyamatot biztosítani. A Fermi után az NV GPU-kból ezért került ki ez a hardverelem. A szoftver gyorsabban megoldja a problémát, de ettől még az ütemezés egy része maradt hardveres, az a része, amit szoftverből nehezebb kezelni. Olyan nagyon itt sem az AMD, sem pedig az NV architektúrája nem különbözik. Amely folyamatok gyorsabban szoftveresen, azokat úgy is csinálják. De ettől egyik dizájn sem lesz teljesen szoftveres ütemezésű, csak az NV és az AMD hülye lenne tranzisztort áldozni lassításért.

A trendforce egy piackutató cég, amely előrejelzéseket ad. Vagy bejön, vagy nem.

Linus és MLID YouTube-sztárok, akik szenzációból élnek.

A "Gigabyte alkalmazottjának a testvérének a régi szobatársától hallottam" pedig nem egyenlő a Gigabyte cég hivatalos közleményével.#56161 sakal83 : Nincs szükségük arra, hogy megbeszéljék az árakat. Az NV beáraz, az AMD meg hozzáigazítja a sajátját. Egy szót nem kell erről egyeztetni.

#56162 Cifu : Már kiderült, hogy nem mindegyik D3D12 játék érintet. Csak azok, amelyek minimum feature_level_12_0-t igényelnek. Ezekben viszont mindben érezhető a CPU-limit a GeForce-szal. Ha a feature_level_12_0 nem minimum követelmény, akkor a GeForce-ok limitje nem jön elő. Az NV peche az, hogy az új D3D12 játékok mindegyike feature_level_12_0 igényel minimum, ezért lett nagyon látható a jelenség.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Komplikato

veterán

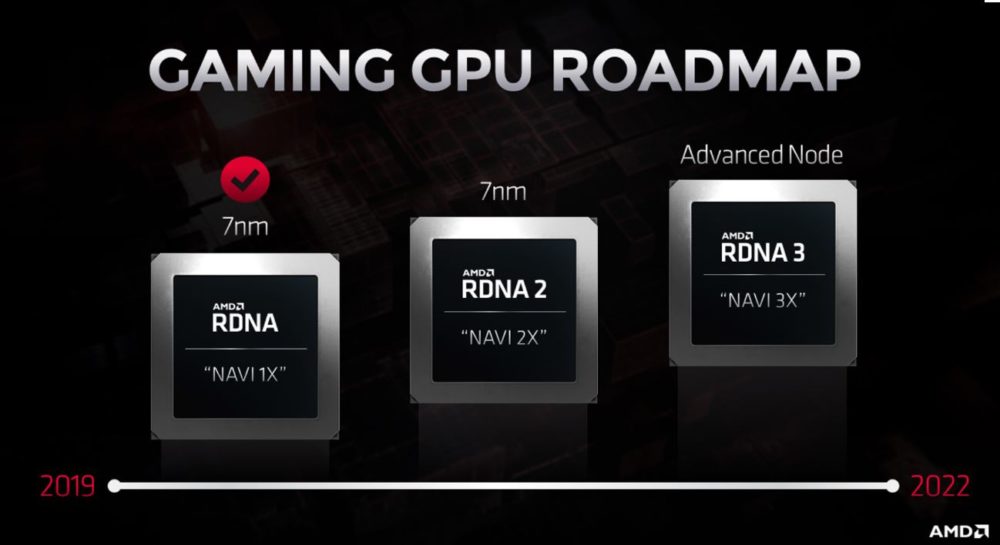

Mit szóltok a Navi 31 pletykákhoz? Szerintem eléggé valószínűtlen, hogy egy generáció alatt háromszoros teljestményt sajtolnának ki az új csúcs hardverből, a 400W+ fogyasztás alapján meg workstation kártyának se tudnám elképzelni.

"Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

Mumee

őstag

válasz

Komplikato

#56165

üzenetére

Komplikato

#56165

üzenetére

AMD 2,5-2,7x Nvidia 2-2,2x az belsős performance target, tehát az nem fog sokat változni, max ilyen 0,2x-nyit.

Fogyasztás pedig emellett nem kivitelezhető egyik oldalon se a megszokott 300W-ból, Nv monolitikus die mellett pláne nem.A legtöbb embert meg nem érdekli a fogyasztás, ha a teljesítmény társul hozzá, főleg hogy a consumerebb kártyák megállnak majd 300W alatt valószínűleg (4060-7600XT).

-

Alogonomus

őstag

válasz

Komplikato

#56165

üzenetére

Komplikato

#56165

üzenetére

A háromszoros teljesítményről szóló pletyka "súlyát" sokan már csökkentették azzal, hogy elvileg nem az RDNA2, hanem az RDNA1 kártyához képest lesz meg a háromszoros teljesítmény, vagyis a Navi 21 kártyához képest csak nagyjából 50% lehet az ugrás, ami viszont abszolút hihető lehet a dupla adagnyi feldolgozóegység alapján.

-

válasz

Alogonomus

#56163

üzenetére

Alogonomus

#56163

üzenetére

+ Abu:

Na látod, fanozás nélkül is egyet tudunk érteni dolgokban. Ebből amit linkeltél te magad is láthatod, hogy igazam van. itt nem a teljes driver újra írás a megoldás, és nem az hogy hülyének nézünk egy céget 35 év fejlesztői munkával a PC iparban.... Igor is ezt állítja hogy több lépcsőben lehet ezt helyrehozni, de van egy dolog amin segíteni nem lehet , még pedig az hogy elsősorban a konzolátiratokban és radeonra optimalizált címekben jön elő a legjobban, és ezen Nvidia nehezen fog tudni segíteni.

Ő azt mondja hogy az asszinkron compute feldolgozás kis felbontáson extra gyorsasággal ( magas FPS szám) akadást okoz a GPU ban, amit abból vont le hogy Nvidia oldalon GPU limites környezetben de kevés CPU magszámmal tesztelve is később rakja ki a textúrákat, árnyékolási anomáliákat okoz, renderelési csúszások és hibák jönnek elő. a problémás játékokban és többször üres járatba fut a a textúrázás, és a párhuzamos folyamatok végrehajtása ( asszinkron) ami késleltetési probléma, akadás, ahogy ő hívja buborék és ami felelegesen sok újrahívást eredményez CPu oldalon és ezért van a nagyobb CPU igényés korlátozott FPS szám.

"

Whether it was Horizon Zero Dawn or Watch Dogs Legion, whenever the FPS dropped on the GeForce (especially in the measurements with only 2 cores), the slower popping of content, delayed loading of textures, or errors with lighting and shadows were less bad on the Radeon than on the GeForce. This is also an indicator that the pipeline was simply tight (bubbles) and the multi-threading on the GPU was not really optimal. This is supported by the fact that the percentage gaps between the two cards are always the same when increasing the core count and decreasing the CPU limit (see page two). Because I see the problem rather less with the CPU, but the processing of the pipelines on the GPU. A limiting CPU only makes the process more obvious, but is not the real reason.Ezt megoldani talán az aszinkron feldolgozás finomításával lehetne ami hardveres és szoftveres kérdés is, vagy a játékmotor oldali optimalizálással, amire Nvidián nem valószínű hogy sort kerítenek, A harmadik brute force megoldás az erős CPU ami bírja hogy a GPU extrán terheli, a negyedik a magasabb felbontáson való játék, ami valljuk be egy 3070- 3080 esetén eléggé jellemző.

tehát a teljes dx 12 driver újra írásra és hasonló végletes kijelentésekre továbbra is reagálni fogok, fanboy ide vagy oda, maga a topik viszont nem megfelelő erre.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

válasz

Alogonomus

#56169

üzenetére

Alogonomus

#56169

üzenetére

Még a saját magad által bevágott szöveg értelmezése sem megy sajnos neked, nem hogy engem kijavíts. Amit kiemeltél (is) feketén fehéren leírja, hogy nem a driver hibája a dolog, hanem egy összetett jelenség, tehát annak az alapoktól való újraírása biztos remek és szükséges megoldás, hogy az alapoktól építsenek fel minden újra, mert szerinte 5 év nem volt elég rá,elmaradásban vannak, majd most gyorsan újraírják mert újra kell írni, aztán jó lesz, mert Nvidia balfasz. Paradoxon by Abu.

Nagyjából egy oldal sem jött rá a valódi okokra, találgatnak, egyedül Igor végzett erre vonatkozó részletes méréseket és szolgált valódi eredményekkel, és ő pártatlan, tehát hiszek neki. Részemről off.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Komplikato

veterán

válasz

Alogonomus

#56167

üzenetére

Alogonomus

#56167

üzenetére

"hihető lehet a dupla adagnyi feldolgozóegység alapján."

De pont arról regélték, hogy tripla annyi lesz benne. Nem tudom elképzelni."Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

Mumee

őstag

válasz

Alogonomus

#56167

üzenetére

Alogonomus

#56167

üzenetére

N21 x2,5-2,7, tehát az nem lehet RDNA1 és nem is lenne rendben, ha NV 3090 x2-2,2 .

[ Szerkesztve ]

-

Alogonomus

őstag

Jelenleg a tippek ahogy az angolt mondaná "all over the place".

A valószínűleg talán leginkább komolyan vehető nyilatkozat Rick Bergmantól származik, aki úgy fogalmazott, hogy:

"... Bergman quickly pointed out that the performance-per-watt gains should be similar to the improvements achieved with the leap from RDNA 1 to RDNA 2. “... We have the same commitment on RDNA 3… We focused on that on RDNA 2. It's a big focus on RDNA 3 as well.” Bergman notes that the key here is to maintain a similar TGP while delivering 50% more performance so potential users are not forced to buy bigger power supplies and replace the cooling solutions like with Nvidia's RTX 3000 cards."Vagyis nagyjából az RDNA2 fogyasztási keretében gondolkoznak, és szeretnének abból 50%-kal több teljesítményt kihozni az RDNA3 kártyákkal.

Persze a tervek változhattak azóta, de az 50% és 200% nagyon messze vannak egymástól.Az 5 nm nagyjából 15% sebességet, vagy 30% spórolást jelent. "Compared to TSMC 7nm node, the N5P (5nm) delivers a 15% speed improved or about 30% reduction in power consumption."

A pletykák szerinti 2x80 CU-s Navi 31 nagyjából bele is illik ebbe a képbe. Egy 6900 XT elfűt 320 wattot, amiből a Navi 21 chip jelenthet mondjuk 235 wattot. A 30% spórolással az lenne 165 watt bármilyen optimalizálás nélkül, csak a 7 nm-ről 5 nm-re váltásból következően, vagyis a 2 tömb kis optimalizálással együtt teljes terhelésen is beleférhetne 300 wattba. Mind a két tömb viszont biztosan nem tudna olyan kihasználtságon üzemelni, mint most az egy tömb a 6900 XT kártyákon, így mondjuk 80%-on használva a két tömb mellé még beleférhet a többi alkatrész, és a 320-350 wattból meg is lehet a kártya. -

Jack@l

veterán

Nem kell aggidni, amint intel összeszedi magát gpu fronton, egyből nem nv-hez árazás lesz. remélhetőleg

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

Komplikato

veterán

Azt hiszem ennek nincs külön topik és lehet NEM jelent semmit, deee ...

https://twitter.com/3dfxofficial/status/1421244991297376262"3dfx Interactive is coming back, 20 years later. Prepare for an major announcement regarding our return this Thursday!"

Másik fórumban már találgatták, hogy egérpadot vagy más fantasztikus dolgot jelenthetnek be.![;]](//cdn.rios.hu/dl/s/v1.gif)

"Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

Mumee

őstag

válasz

Alogonomus

#56173

üzenetére

Alogonomus

#56173

üzenetére

Csak ez tavalyi. Azóta rájöhettek, hogy NV elmegy 450-500W-ig, így ők is feljebb lépnek fogyasztásban.

Ráadásul kopite írta, hogy a perf target az nem leak, hanem belsős perf target. -

Raymond

félisten

válasz

Komplikato

#56175

üzenetére

Komplikato

#56175

üzenetére

1. nincs minek visszajonnie, a brand nem letezik

2. [link]Privat velemeny - keretik nem megkovezni...

-

hokuszpk

nagyúr

válasz

Komplikato

#56175

üzenetére

Komplikato

#56175

üzenetére

vegulis a mostanaban talalgatott uj AMD/NV GPUkhozképest egy Wudu 5 6000 alig fogyasztott

Első AMD-m - a 65-ös - a seregben volt...

-

Raggie

őstag

válasz

Alogonomus

#56173

üzenetére

Alogonomus

#56173

üzenetére

Két különböző állítás van itt.

Te általad citált: azonos powerből +50% teljesítmény a cél.

A többbiek által citált: a köcetkező generáció csúcs kártyájának a teljesítménye.A kettő nem feltétlen voatkozik ugyanarra a kártyára... Lehet az azonos powerből +50% teljesítmény a következő generáció középmezőnyére vonatkozik, míg a csúcskártya elszáll teljesítményben és powerben is.

Clint Eastwood FTW

-

Alogonomus

őstag

válasz

Raggie

#56180

üzenetére

Raggie

#56180

üzenetére

Annak ellentmondana az, hogy nem akarnak túl magas fogyasztást, hogy ne kelljen komolyabb tápegységet vennie mindenkinek. "so potential users are not forced to buy bigger power supplies and replace the cooling solutions like with Nvidia's RTX 3000 cards."

A kisebb RTX 3000 kártyáknak nagyjából rendben van a fogyasztásuk, csak az RTX 3080/90 kártyáknál lett igazán kiugró a fogyasztás, amihez már erősebb tápegységre és 3 slotos kártyaméretre kellett váltani. -

Mumee

őstag

válasz

Alogonomus

#56178

üzenetére

Alogonomus

#56178

üzenetére

"The performance numbers mentioned by leakers for AD102 and Navi 31 are not speculation. These are the developer's internal "performance goals" - what the developers want to achieve."

AD102 x1.9-2.0 vs GA102 N31 x2.5-2.7 vs N21Azt se mondta az AMD, hogy az 50%-os perf/watt nem "chiplet"-enként értendő-e.

[ Szerkesztve ]

-

carl18

addikt

Üdv!

Na rég írtam, ide! Szép lassan vártam a RX 570 utodjár, de valahogy csak vastagon fogott az a ceruza. 6600XT 380 dollárért? Sajnos ennyire nincs szűkségem videókártyára.

Szép lassan vártam a RX 570 utodjár, de valahogy csak vastagon fogott az a ceruza. 6600XT 380 dollárért? Sajnos ennyire nincs szűkségem videókártyára.

Úgy láttom kezd kihalni a 200 dolláros szegmens, sajnos én se tudom mire leváltani a jelenlegi kártyámat.

Azért az úgy poén hogy a polaris óta nem jött újdonság a 200 dolláros kategóriába.

Mert jött a GTX 1650 de az semmi előrelépést nem hozott.

Úgy érzem egy helyben toporgunk, sajnos vicces hogy 2021-ben még mindig a RX 570 a legjobb ár-érték arányú videókártya. Tragikómédia

Én azért 2021-ben elvárnám hogy legyen egy kártya ami 2X gyorsabb mint a RX 570 és 6/8giga vrammal rendelkezik 200-220 dollárért. De úgy látszik ez a beteljesűlés nagyon a jövő zenéje. Talán 2022-2023 fele nagy nehezen piacra dobnak az ilyet.

Hiába szúr, itt Ryzen a úr!

-

Raggie

őstag

válasz

Alogonomus

#56181

üzenetére

Alogonomus

#56181

üzenetére

De nem kell mindenkinek a csúcs kártyát vennie. Vehetnek a középsőkből és akkor nem kell tápegységet cserélni.

Te készpénznek vetted itt valamiért, hogy ez a kijelentés is a csúcsról szól de szerintem konkrétan erre semmi nem utal úgy igazából...Clint Eastwood FTW

-

GeryFlash

veterán

Szerinted errol a DX12-es FullHD-s bottleneckrol a vasarlok hany %-a tud? 0,1%? Biztos oriasi hatasa van az eladasokra. Alapbol rohadt sokan lehetnek azok akik 2021-ben uj VGA-ra ruhaznak be 250-500 ezer Ft ertekben es a FullHD a target. E-Sportshoz meg barmelyik Ampere eleg lesz.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

GeryFlash

veterán

Ha az asszinkron compute feldolgozas problema akkor miert csak minimum feature_level_12_0-t esetben jon elo es pl Vulkannal nem?

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

GeryFlash

veterán

válasz

Alogonomus

#56173

üzenetére

Alogonomus

#56173

üzenetére

,,Persze a tervek változhattak azóta, de az 50% és 200% nagyon messze vannak egymástól."

Marmint az egyik a gyorsulas a masik meg hogy hanyszorosara fog gyorsulni. Tehat igazabol 150% es a 200% (esetleg 50% vs 100% gyorsulas).

Egyebkent szerintem is-is. Egyreszt lesz egy RDNA1 --> RDNA2 szintu 50%(?)os perf/watt javulas, masreszt nem lesz teljesen 200%ra valo gyorsulas, de nem is csak 150% lesz, mert novelni fognak a max TDP limiten. Szerintem a csucskartya kozel 2-szer gyorsabb lesz, mint a 3090-6900XT, de ez ilyen 2 ezer dollar koruli aron is fog jonni. A normal kategoriakban (pl 6700XT vs 7700XT stb) meg remelhetoleg latunk egy 50%os gyorsulast, esetleg 35-40%-ot viszont csokkentett fogyasztassal.

Igazabol mindket gyarto kiad majd egy igazi flagshipet, mint anno a 2013-2014 kornyeken voltak a TITAN-ok. Akkor azok 2szer annyiba kerultek, mint a 2. legnagyobb kartya, a 980. Ilyesmi lesz most megint csak a 2. legnagyobb kartya inkabb 2K dollar MSRP-n jon, a masodik legnagyobb kartya meg 799-99 kozott. Szerintem

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

GeryFlash

veterán

Jo hat Abu azt mondta, mindenesetre itt is DX12 mode-ban futott (=lehetett async compute) es a Vulkannal szinten van/lehet async compute, ott viszont nincs ilyen problema. Ergo ebbol szamorma az derul ki, hogy lehet nem ez a problema.

[ Szerkesztve ]

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Z10N

veterán

The RX 6600XT At $379 Is A Total Mess - AMD and Nvidia Have Killed Entry Level And Budget PC Gaming!

# sshnuke 10.2.2.2 -rootpw="Z10N0101"

-

Televan74

nagyúr

válasz

tisztelturam

#56197

üzenetére

tisztelturam

#56197

üzenetére

Amit eddig csak laptopban látunk. Asztali 3050Ti -nek kellett volna jönnie a 3070/3080 Ti -vel együtt.

6600(XT) alatt nincs eddig bejlentett termék. Lehet nem is lesz, akkor ez lesz a belépő termék.

Végig nézetem a videót és nem mondom azt hogy néhány dologban nincs igaza. Ez az MSRP kicsit meredek még ha hiány van akkor is. 100$ -al felette ott a 6700XT, ami jóval tovább elég lenne mint egy év.Egy dolgot megtanultam a most kialakult helyzetben, hogy lehető legtovább használom a hardvert. Nem cserélek éveként mint eddig, hanem megpróbálom kihúzni 2-3 évig is.

Amikor nincs remény! Jusson eszedbe nincs isten, csak én!

-

Z10N

veterán

válasz

tisztelturam

#56197

üzenetére

tisztelturam

#56197

üzenetére

Csak ertelmezni kene tudni. Ugy, hogy az ez ala jovo budget kartyak 3050/6500 kemenyen tul lesznek arazva. $279 lesz a 6500XT, mikozben az 6600XT-t a GTX1060-hoz mutogatjak, az RX570 $130 volt normalis idokben a boltokban. Azaz a budget is tobb, mint a ketszeresebe fog kerulni (x2,146). A sima 6600-t belovik $329-re az RTX3060 melle. Vagy lehet nem is lesz, mivel megy PRO-nak vagy a TESLA-kba, Apple-nek, stb. Roviden ennyi. Meghalt a budget...

# sshnuke 10.2.2.2 -rootpw="Z10N0101"

-

tisztelturam

tag

Szerintem sok értelme nincs az 570 meg 1060 korszakhoz viszonyitani. Akkor könnyen tudtak olcsóak lenni se bányászat ilyen mértékben ,se chiphiány, se világzás a vírus miatt stb.. Ez kb olyan mint a mai kenyér árat az régi 1 ft-oshoz mérni pedig ugyanaz a kenyér azt 200x drágább..

Van megoldás 3 féle is név szerint Switch, Xbox és PS...ezt a piacot meg elhagyni

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

![;]](http://cdn.rios.hu/dl/s/v1.gif)