- Biztonsági aggályok miatt késik a Microsoft hatalmas AI-újítása

- Kíváncsi az EU, milyen online védelmet adnak a pornóplatformok a kiskorúaknak

- Panaszt tettek a Google ellen, mert követi a felhasználókat a böngészője

- Rengeteg áram kell az adatközpontoknak, erre válasz a geotermikus energia

- Az AI megmondja, hogy van-e fájdalma a macskának

-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Alogonomus

őstag

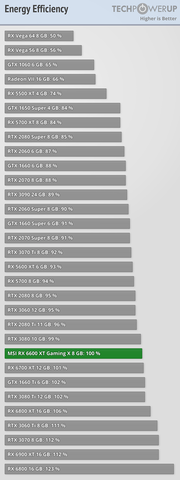

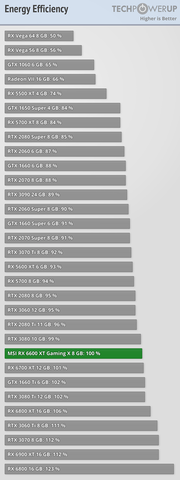

Elfogadom a kötődésedet, de a tények attól tények, és hiába hozod fel számodra ideális példaként a 6600 XT fogyasztását, ha az a 3060-hoz hasonló fogyasztási érték mellett 137 fps elérésére képes, míg a 3060 csak 119-re elég.

Egyébként pedig az általam említett "túlfeszültséges" esetek a komolyabb teljesítményű 3080-as és 3090-es kártyáknál jelentkeztek, amik a második lista alapján is észrevehetően a hatékonysági görbéjük leszálló ágáig vannak erőszakolva, hogy "versenyben maradhassanak" a 6800-as és 6900-as kártyákkal. Aztán ezt a "megerőszakolást" nem mindegyik alkatrész tudja stabilan elviselni a kártyákon, és lehet garanciáztatni, vagy új BIOS-szal visszább venni a kártyák teljesítményét.

-

huskydog17

addikt

Pedig van benne ráció, jól mondja, átfogalmazom a mondandóját, hogy ne legyen félreértés:

Miután az AMD nyíltan elismerte az RDNA2 család árazásával, hogy az NVIDIA elleni küzdelmet feladták, már csak arra kell figyelniük a pirosaknak, hogy ne egy újonc (Intel) vigye el a megmaradt, rekord-alacsony piaci részesedésüket, mert az nem csak ultragáz és ciki lenne, hanem az egész cégre nézve megalázó lenne, onnantól el is adhatják az RTG-t.

Amíg az NV nem hoz új generációt, addig az AMD-nek sem kell, majd ha jön, akkor az RDNA3-at gyors kihozzák, hozzáárazzák az NV-hez és kész, megy tovább a kartellezés, teljes mértékben fittyet hányva a piaci részesedésre. Az Intel viszont alaposan beleköphet a levesbe, mert a kékek viszont nagy valószínűséggel, újoncként bizony piacot akarnak majd szerezni és azt csak úgy lehet, hogy nem mennek bele egy hármas kartellbe, így a kékek veszélyt jelentenek a pirosaknak.Azt hiszem valami ilyesmire gondolhatott.

Személyes vélemény:

Amúgy akkor lesz nagy kakiban a RTG, ha a kékek rágyúrnak a multimédiára, pontosabban a videókészítők számára hasznos feature-ökre, ugyanis itt a vörös oldal jó szokásukhoz híven úgy le van maradva, mint a borravaló. Ha itt az Intel szintén hoz hasznos fejlesztéseket, melyek a videósok számára üdvözlendő, akkor villámgyorsan elszippanthatják az AMD tizenpárszázalékát.Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

Busterftw

veterán

Igazabol a piac 80%-a mar jo ideje Nvidiae, egy bizonyos 5% ami vandorolni szokott ide-oda negyedevente, fuggetlenul attol az AMD utokepes megoldast hoz vagy sem.

En ezert sem gondolom, hogy az Intel az Nvidia-tol szipkazna el a vasarlokat megfelelo ajanlat eseten, hanem az AMD-tol.

Itt van az a reteg aki megszokott egy olcsobb es megfizetheto markat ami mar jo ideje nem letezik, nem csak a banyaszatnak koszonhetoen.

Ide belephet az Intel.[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

A szabványoshoz nem kell, de a sajátjához kell, és azt nagyon sokan használják, a VRR monitorok kb. 90%-a.

Az NV régen azt mondta nekem, hogy az a fő baj az Adaptive-Sync szabvánnyal, hogy a teljes futószalag nem minden elemét fedi le. Emiatt például bizonyos időzítési paramétereket nem, és a Radeonoknak más paraméterek jók, mint a GeForce-oknak. Na most az AMD már eleve úgy íratja a Firmware-t, hogy nekik jó paraméterekkel működjön, és erre az NV úgy reagál, hogy xy monitorokat letesztelnek, és csinálnak rájuk profilt a driverben, hogy a GeForce-oknak rossz paraméterekhez igazodjanak. Működni működni fog mindkettő, de az AMD-nél out-of-box fasza a rendszer, míg az NV-nek dolgozni kell érte per monitor szinten. És ezen nehéz változtatni úgy, hogy az AMD közben árazópisztolyt tart a monitorgyártók fejéhez, hogy ha az NV-nek is kedveznek, akkor bukják az évenként odaöntött pénzt, és egy rakás AMD által birtokolt licencet, amit az AMD ingyen ad nekik, ha jófiúk.

Emiatt van az, hogy az NV még ma is csak driverből csinálja ezt, míg az AMD-nél sose látsz olyat, hogy egy új driver ilyen-olyan FreeSync monitorhoz hoz támogatást. Egyszerűen ezt a supportot a monitorgyártókhoz betelepedett mérnökeik direkten beépítik a firmware-be, így nem kell a meghajtóban egy nem optimálisan paraméterezett firmware-hez igazodni, ahogy az NVIDIA-nak.

A szabványos HDMI VRR-nek van annyi előnye, hogy a HDMI Forum nem volt nagyon felszínes, mint a VESA, így ők gondoltak erre a problémára. Ergo ezt szabványos szinten kezelik is. De a piacpolitikai tényezőket ők sem tudják kezelni, az AMD ettől még ugyanúgy rá fogja fogni a gyártókra az árazópisztolyt, mert a HDMI VRR-t kevesebb hardver támogatja, mint az AMD-felé HDMI-s FreeSyncet. A FreeSync valójában csak a felhasználók felé "free", a gyártókra már komoly láncokat rak. Talán versenyjogilag is némileg kifogásolható láncokat. Egyelőre viszont senki sem szól érte, mert a monitorgyártóknak előnyös, hogy van egy rakás ingyen licencük, és ezért csak el kell kurvásodniuk. Talán más lenne a helyzet, ha az NV ezt a problémát nem tudná kezelni driverből, de mivel kezelni tudják, így a jelenlegi helyzetet mindenki elfogadja.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Viszont az AMD-nek van, és mellé van egy rakás szabadalmuk, amik szükségesek ahhoz, hogy egy monitort ki tudjon adni egy gyártó. És ezt minél olcsóbban akarják megúszni. És ha mondjuk az AMD azt mondja, hogy majd ők megírják a firmware-t a monitorhoz, akkor fülig érő szájjal belemegy a gyártó, mert kapnak licenceket, megcsinálja más a munkát, és csak az NV-vel basznak ki, de ők meg majd kiadnak egy drivert, ami rendbe rakja a kibaszást. Tehát egyelőre mindenki happy.

Az a baj a HDMI 2.0-s FreeSync-kel, hogy az AMD-nek egy régi szabadalmát használja. Na most az AMD ezt a szabadalmat a VESA esetében bedobta a közösbe, de ez csak annyit jelent, hogy a DisplayPortra lehet használni a VESA tagoknak. Viszont HDMI-nél fizetni kell érte, és nem is ez a legnagyobb baj, hanem az, hogy az AMD nem adja el akárkinek. Gyakorlatilag ezt a szabadalmat fegyverként használják. És emiatt az NV nem is tud alternatívát csinálni, mert amivel működik az a szabadalom az AMD tulajdona. Emiatt nincs HDMI 2.0-n az NV-nek VRR-je. Technikailag meg tudnák oldani, csak az AMD-é az alaptechnológia, és ők marhára nem adják oda akárkinek, és ez a szabadalom kívül esik a keresztlicenc megállapodásokon is.

A HDMI 2.1-nél az a jó, hogy ott ugyanaz van, mint a VESA esetében. Aki HDMI Forum tag, az használhatja az AMD szabadalmát, de csak HDMI-féle VRR-re van átruházható licence a HDMI Forumnak, az AMD-féle eredeti HDMI-s FreeSync továbbra is tabu.

Igen, az NV megszab egy minimum frissítést. Ez a helyzet kezelhető addig, amíg nem kell sok monitort paraméterezni driverből. Az AMD kb. támogat 1700 monitort out-of-box. Per monitor alapon ennyit nem lenne optimális az NV-nek driverben kezelni, de havi szinten 10 monitor bőven vállalható az NV-nek, arra megvan az erőforrás. Fölötte már eléggé sok munka lenne. Inkább mondják azt, hogy vagy működik, vagy nem.

Egyébként fontos, hogy attól, hogy egy kijelzőn HDMI 2.0 van, még lehet olyan VRR-je, ami a HDMI Forum szabványának megfelelő. A gond itt az, hogy erről nem tájékoztatnak a gyártók.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Meg úgy sok minden mást. Ez volt a FreeSync lényege. Betelepülni a gyártókhoz, amíg az NVIDIA nem látja, hogy mire készülnek. Ezt meg is csinálták. Innentől a FreeSync már nem olyan Free.

Mint írtam a VESA és a HDMI Forum is egy AMD szabadalomra épít. A lényeg viszont az, hogy ez átruházható a tagok felé. Nyilván vannak költségek, de ezt megoldják. A HDMI-s FreeSync esetében nincs átruházhatóság, az AMD-vel kell egyezkedni, hogy engedik-e vagy sem.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

[link] - ez az alapja a VESA és a HDMI Forum VRR-jének. Illetve az AMD-féle HDMI-s FreeSyncnek is. A lényege a szabványosításoknak az, hogy ezeket a szabadalmakat az érintettek bedobják a közösébe, és ez így van a VESA és a HDMI Forum esetében is, de az AMD a saját, nem szabványos HDMI-s FreeSync implementációjánál nem közösködik.

Ettől még lehet használni szabványosan VRR-t HDMI-n, csak nem az AMD implementációjával.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Alogonomus

őstag

Megint írni kezdtél az első pillanatban, pedig végig kellene olvasnod a hozzászólásokat. Írtam, hogy "Amennyiben az Nvidia szintén előránt valahonnan legalább 60-80% sebességnövekedést, akkor továbbra is versenyben maradhat...".

Szóval én is úgy vagyok vele, hogy ha igazak az RTX 3090x2 Lovelace pletykák, akkor nem lesz bálványdöntés, de MLiD Tom nem szokott tévedni, és szerinte a Lovelace nagyjából 60-80%-ot tudhat gyorsulni, amit esetleg 100%-ig elhúzhatnak "insane power usage" esetén. Vagyis a "legalább 60-80%" az nagyjából a maximumot is jelölheti a Lovelace esetén, ha nem egy mondjuk 600-800 wattos szörnyet nézünk, amit te is jósolsz a "Ráadásul szerintem Nvidia ezt majd fokozni fogja, csak hogy övék legyen a trón egy MCM Hopper alapú Titan kártyával ami hozza az RDNA 3 csúcsot vagy felette lesz tippre 5000+$ körüli áron.ez sem érdekli a piacot úgy általában" mondatoddal. -

Petykemano

veterán

Erről az idézetről később az derült ki, hogy a tomshardware Google translate-tel fordította kínairól és pontatlan. A hangulatkeltésért később elnézést is kért.

Ezzel együtt szerintem az idézett idézet igaz. Devinder Kumar talán diszkrétebben, diplomatikusabban fogalmazott.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Franc

Azt akartam megnézni, hogy az rx 580 a maga korában mennyi többjátékon átlagolt fps-t hozott.

Nem akarok igazságtalan lenni.

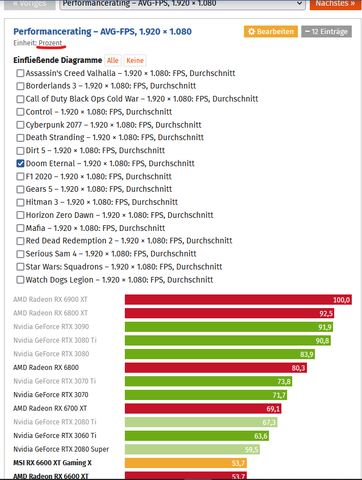

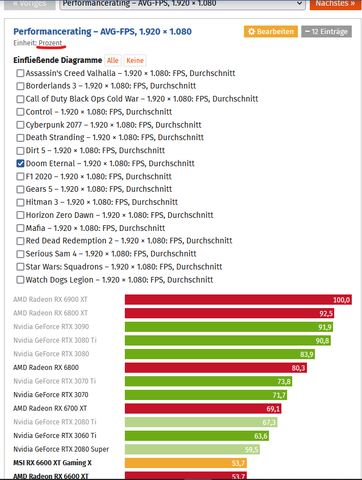

A tpu teszt szerint a 6600xt az ő játélcsomagjukon átlagosan 100-110+ fpst hoz. Az rx 580 hozza a 60 fpst 1080p. Az ő beállításaik, az ő csomagjuk, ebben nyilván lehet régebbi játék, amiben mindkettő jó, meg újabb, amiben a régi kártya fűbe harap. Nem tudom.

Sajnos a korabeli rx 580 tesztnél csak százalékos értékek vannak, ami nem.mondja meg, hogy az rx 580 a korabeli játékokon 1080p-ben (az ő összeállításukban és az ő beállításaikkal) mennyit hoz átlagosan.A computerbase esetén is ezt akartam megnézmi, de tartok.tőle, hogy amit te linkeltél, az sem az. A grafikonon a számok ugyanis nem fpst hanem %-ot mutatnak. Azért nem egyértelmű, mert 12 kártya eredménye el van tüntetve. Ha azt benyod, megjelenik a tetején a 100-as csík.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Nekem továbbra sem stimmel.

Azt értem, hogy ha az egeret ráviszed valamelyikre, akkor a relatív teljesítménxkülönbséget mutatja mindenképp százalékos formában. Ezt hagyjuk is, mert ez jó.Viszont a selectboxban én hiába változtatom az AVG-FPS és a perzentile fps között, kábé ugyanazt látom.

Ha elkezdem kikapcsolgatni az egyes játékokat, a legelső 3090/6900xt értéke sehogy se megy 100 fölé.Ehhez képest az ez alatti játékonkénti fps grafikonon csupán néhány esetben fordult elő 100 alatti érték, legtöbbször 150. (6900xt)

Gondolom ha alul a doom eternalt nézem, és felül pedig az AVG-FPS fülön csak a DOom eternalt választom ki, ugyanazokat az értékeket kéne látnom, nem?[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

Ez nem arra magyarázat.

De amúgy kicsit sem furcsa, pl. hogy minden játéknál van egy kártya, ami pont "100 FPS"-t tud és az a leggyorsabb? A Performancerating táblázat százalékos értéket mutat mindenhogy, akkor is ha rajta van az egér, és akkor is ha nincs.

A Performancerating táblázat százalékos értéket mutat mindenhogy, akkor is ha rajta van az egér, és akkor is ha nincs.Holnap országszerte 10 fok várható. Ebből 2 Budapesten, 1 Győrött, 2 Miskolcon...

-

Petykemano

veterán

Én nem tanulmányoztam sose a computerbase.de metodikáját, tehát nem tudom, hogy változott-e a korábbi definíciókhoz képest.

De amit én látni vélek a Performancerating grafikonokon az a következő:

Az AVG-FPS esetén a tényleges FPS átlagot veszik, a Perzentile-FPS esetén pedig a frame-ek 0.2 v más esetekben 1%-át kiszűrik. Ezt nem pontosan értem a CB leírása alapján, de emlékeztet az 1% low és 0.1% low-ra, amit Steve@GN ismertetett pár éve (https://www.youtube.com/watch?v=uXepIWi4SgM)

De a mértékegység szempontjából mindegy, hogy melyik értéket választod ki.

Maradjunk az AVG-FPS-nél.Tehát van 15 játék és az tesztelt kártyák az egyes játékokban ezért fps eredménye.

Ezeket játékonként sorba állítják és fogalmazzunk úgy, hogy 100-ra normalizálják úgy, hogy az adott játéknál legjobb eredményt elérő kártya fps értéke a 100%

Tehát ilyenek lesznek, hogy

Játék1:

6900XT: 100

3090: 97

3080: 92

6800XT: 90játék2:

3090: 100

6900XT: 99

3080: 95

6800XT: 92stb

És akkor ezeket a játékonkénti értékeket átlagolják és úgy jön ki egy átlagos pozíció. Maguk az értékek a játékokban egy abszolút erősorrendet jelentenek. Azt gyanítom, hogy azért nem teszik ki a % jelet, hogy egyértelműen meg tudd különböztetni attól, amikor ráviszed a valamely sorra az egeret - akkor ugyanis a %-os értékékeket a kiválasztott elemhez képest mutatja meg.

Csináld azt, hogy így állítod be a Performance rating (mindegy melyik típus) grafikont, hogy csak egy játék legyen kiválasztva és hozzáadod az eltüntetett kártyákat. Akkor biztosan lesz egy 100-as érték. És vidd rá az egeret a legfelsőre.

Végig a grafikonon ugyanazokat az értékeket fogod látni, csak egészre kerekítve és % jellel.Lekéstem

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

huskydog17

addikt

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

KillerKollar

senior tag

Ha ez így van akkor szart sem ér, az MCM-nek pont az lenne a lényege, hogy sokkal jobban skálázható lefele és felfele a chipletek miatt, tehát szerintem biztos, hogy lesz több SKU is, persze egyik sem lesz olcsó, de ha mondjuk a top kártya lesz 2000$ 32GB VRAM-al és lesz 1000-1200$-ért egy annál 10-20%-al gyengébb kártya 16GB VRAM-al akkor az már rendben van ha valóban ekkora teljesítmény ugrások várhatóak. Persze 1000-1200$ is sok de a 6900XT 1000$, a 3080 Ti 1200$, szóval annál olcsóbbra nem várnám semmiképp sem.

-

Petykemano

veterán

Azt beszélik, hogy az villamos áram (világpiaci) ára 3x, a gáz ára 4x akkora jelenleg, mint amit a magyar lakosság megfizet. A számla persze nem csak ebből áll, hanem hálózathasználati díjból is, tehát ha érvényesítenék, nem 3x, ill 4x nagyobb lenne a számla, hanem mondjuk "csak" 2x.

Nem állítom, hogy ez a jelenlegi energiaár emelkedés a bányászat számlájára írhatóm, de lehet benne szerepe.

A "rezsicsökkentés" egyébként egy jó módszer arra, hogy első körben megvédd a lakosságot az energiaárak emelkedésétől, ha egyébként a hiányt/többletfogyasztást "ipari" tevékenység okozza. De ha minden ipari szereplő a magasabb (piaci) árat kapja, akkor azok termékei vagy szolgáltatásainak árain keresztül be fog szivárogni a mindennapjainkba. (Szerintem egyékbént azért nem napi politikai téma, hogy ha Gyurcsány nyer, akkor Lendvai "nem lesz gázáremelés" Ildikó ráengedi a lakosságra a világpiaci energiaárakat, mert akárki nyeri a 2022-es választást, lesz áremelés - ha mér akkor is ilyen emelkedett a világpiaci ár)

Találgatunk, aztán majd úgyis kiderül..

-

Abu85

HÁZIGAZDA

[link] - kimérték már több DirectX 12 játékban ugyanezt. Ez egy implementációs probléma. Nem tudnak vele a fejlesztők mit kezdeni a játék oldaláról. Az NV-nek újra kell írnia a DirectX 12 bekötési implementációját.

A lényeg az, hogy ha kellően erős maggal dolgozol, például Zen 3, akkor nem valószínű, hogy ez limit lesz, de régi magokkal az.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Pont ez a gond a HWUB által mért játékokban a GeForce driverrel. Egy magot nagyon beterhel, és emiatt nem tud skálázódni, mert a magszintű teljesítmény nem elég hozzá. Ezért javul meg Zen 3-mal, mert ott a magszintű teljesítmény elég nagy a skálázódáshoz.

#56736 Magoold : Akkor az AMD-n is szarul menne. Ez egy implementációs probléma az NV driverében. Lásd a linket Youtube videó. Ezzel egy játék nem tud mit kezdeni. GeForce-hoz nagyon kell a Zen 3, ez tény, de amúgy a játéknak nem kellene, ha jobban működne a driver bekötési modellje. De ezen borzasztóan nehéz javítani. Nem véletlen, hogy nem volt még kísérlet sem. A HWUB lehozta, hogy van egy ilyen gond, és azóta el van felejtve. Ha az NV úgy is dönt, hogy megoldja, akkor sok-sok hónapot vesz igénybe. Talán két évet is.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

huskydog17

addikt

-

Abu85

HÁZIGAZDA

Amikor a skálázás limitekbe ütközik, és amiatt, hogy az egyik mag nem elég gyors, akkor mindig az az oka ennek, hogy nem tudod valamilyen erőforrás-korlátozás miatt igénybe venni a többi magot. Ennek a tipikus terhelési ábrája az, hogy az egyik mag 90+%-on teker, míg a többi alig, mert várnak arra a 90+%-on tekerő magra.

Igen a DirectX 11-nek pont ez volt a tipikus problémája, méghozzá amiatt, hogy egy szálon történt a parancsok átadása. A DirectX 12 ezen javította azzal, hogy a parancsátadás explicit párhuzamos lett. Ez ugye eddig jó, de a bekötés már nem feltétlenül párhuzamosított, például akkor nem az, ha a CPU-ra van szükség a bekötéshez, mert a GPU nem tudja ezt megoldani a CPU nélkül. Bindless vs. pure bindless, vagy pure bindless emuláció.

A DirectX 12 driverek ma már csak pure bindlesst használnak. Az Intel és az AMD hardverest, míg az NVIDIA emuláltat. Az emulált képes ugyanazokat a programokat futtatni, amiket a hardveres, csak végeredményben a CPU köti be az erőforrást, ezért emulált. Bővebben erről a bekötésről itt: [link]

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Arról igazán nem tehetek, hogy a bekötés implementációjában az NV nem annyira erős. Nekik mond, hogy írják újra a drivert.

Ha megnézel egy Linux fórumot, akkor az NV-t okádják állandóan, hogy szar a Linux support, amit adnak. De az NV részéről ez érthető. Gaming szempontból 1%-os részesedésű OS-ről van szó, nyilván magasról leszarják. Még olyan kiírásokat sem nyertek, amilyeneket az AMD, ahova kell az erős Linux support, lásd Stadia vagy Steam Deck. Miért is erőltessék ezt a minimum szint fölött. Az AMD sem azért az 1%-ért csinálja, hanem a Stadiáért és a Steam Deckért, ahonnan jön a pénzük. Az NV-nek az AMD felé kúszó pénz töredéke jön Linuxból, logikus módon így állnak hozzá a support szintjén is. Minek költsenek annyi pénzt, amennyit az AMD, ha megközelítőleg sem jön vissza annyi ebből, amennyi az AMD-nek? Nem utálják ők a Linuxot, csak üzletileg nem éri meg jobban ráfeküdniük.

Az FC3-5 esetében a DirectX 11 volt a probléma. Elég sok DirectX 11-es játék ezt produkálta, hiszen egy számol történt a parancsátadás. Nem volt párhuzamosítható ennek a működése. Erre jött a DirectX 12. És a Far Cry 6 már ezt támogatja. Ráadásul pont ugyanazt a parancskezelési és bekötési modellt kapta meg, amit az AC: Valhalla használ. Nézz meg nyugodtan egy AC: Valhalla tesztet, és láthatod, hogy miképpen működik alatta a DirectX 12. Például itt több GPU és CPU kombóval tesztelik: [link]

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Petykemano

veterán

"valamint a 6600XT földbe áll a 4 K bekapcsolásával egy 5700XT vel vagy egy 2060 kártyával szembe. "

Szerintem ez nem anomália, hanem expected behaviour.

A 6600XT egy extreme 1080p kártya, nincs benne tartalék.

- sejthető volt, mert nagy felbontás esetén rossz az infinity cache hitrate és elfogy a sávszélességet támogató ereje.

- sejthető volt, mert hogy ha nagy felbontás esetén kevés a 8GB, akkor a 8x pcie sávszélessége kevés a kompenzáláshoz.Találgatunk, aztán majd úgyis kiderül..

-

Cyberboy42

senior tag

Ahogy nézem ez nem kompatibilias az nvidia féle 12 pines konektorral.![;]](//cdn.rios.hu/dl/s/v1.gif)

najó, lehet mégis az, hogyha nem kellnek az alsok kis pinek

És az a 4 pinecske alul emg mire lehet jó? esetleg valami adattovabitas?[ Szerkesztve ]

...A teknős ezután pszichoanalitikusként kezeli az identitászavaros krokodilt...

-

D013

aktív tag

A 1050/1050Ti pàrossal az volt a baj szerintem hogy akkor ott 2016-ban nem csak azok vették meg akik jó fogyasztàst akartak, hanem azok is akik egyszerűen csak Geforceban tudtak gondolkodni. A 1050Ti már akkor is túl gyenge volt mérföldekkel a 1060 3Gb alatt. A 470 meg lehet duplát evett de 25-30%ban gyorsabb is volt kvàzi ugyanazon az áron. Ha nem szàmított a fogyasztás nettó őrültség volt a 1050 szériàt venni jàtékra. Hasonló a sima 1650.

-

Lehet rosszul emlékszem, de nem csak később lett egy árban az RX470 és az 1050Ti? Én pl. 2017 nyarán vettem. De azontúl fontos volt a VP9 támogatás is, YouTube miatt, és úgy látom az RX470 nem támogatja.

Holnap országszerte 10 fok várható. Ebből 2 Budapesten, 1 Győrött, 2 Miskolcon...

-

Devid_81

nagyúr

Rengeteg Polaris van meg kint usereknel, illetve rengeteg Vega a banyaszoknal.

Vegabol keves lehet az egyszeru gamer/usernel, mert akinek volt esze az eladta dragan banyaba es vett helyette egy 6700XT-t vagy 3070-t stb pici rafizetessel.De sztem nem fogja erdekelni az AMD-t kulonosebben, siman kitakaritjak a Polaris tamogatast.

Vega sztem marad, mert az eleg sok helyen jelen van napjaink hardwareiben is, talan az meg visszafogja a driver hanyagolast egy idore az AMD reszerol.[ Szerkesztve ]

...

-

gejala

őstag

Jövőre jönnek a nextgen exkluzív játékok, amihez kell egy csomó új szoftveres megoldásra hardveres támogatás, különben nem lesz sebesség.

Na most Polaris/Vega semmit nem támogat, amit kellene, talán async compute-hoz tudnak kicsit hozzászagolni. Szóval sok pénzt elköltve kellene izzadni olyan architektúrákkal, amik úgyis túl lassúak lesznek minden nextgen címben.Mondjuk AMD-nél az a szívás, hogy csak RDNA2 tud teljes DX12U támogatást, RDNA1 még csak részleges volt, de azt még nem tudják elengedni. NV-nél Turing óta jók a kártyák, ott a Pascal fog durván elhasalni új játékok alatt.

-

-

.Ishi.

aktív tag

Igen, csak ha meglesz az RX590, akkor ott tartunk, hogy az RX 5500XT-hez van kb. 7 százaléknyi fejlődés. Ami barátok közt is übergáz, ha már az 5600XT és 6600XT között sikerült elérni a kb. 35 százaléknyi difit.

Ennél azért többet vártam...az árakkal kapcsolatban igazad van, ez inkább a 150 dolcsis kategória kellene, hogy legyen.

"letiltják a H.264 és HEVC formátumot kódoló blokkot, illetve az AV1 dekodolásának képességét" Durva!

[ Szerkesztve ]

-

Petykemano

veterán

Szerintem is elképesztő ez a toporgás.

Nem mondom, hogy teljesen ugyanaz, mint az 5500XT

Az RX 570-hez képest az 5500XT a tpu adatai szerint 16%-kal gyorsabb [link]

A kép alapján a 6500XT viszont ~25-30%-kal.És persze az AMD honlapján megadott TBP is csökkent 150W-ról 130W-ra, majd most 107W-ra. Aminek nyilván azt kellene megengednie, hogy kevesebb anyagfelhasználás mellett olcsóbb és egyszerűbb kiépítésű legyen a kártya hűtése és PCB-je, ami alacsonyabb áron való forgalmazhatóságot kéne jelentsen.

Ez viszont - a már unalomig ismert okokból - nem történik.

(Persze a lapkaméret sem csökkent jelentős mértékben.)Teljesen egyetértek, hogy ahogy ennek a kártyának az 5500XT-t alapul véve valahol $139-149 áron kellene kijönnie. Figyelembe véve a korlátozásokat

- "az asztali kiadásnál az AMD némi korlátozással élt, és letiltják a H.264 és HEVC formátumot kódoló blokkot, illetve az AV1 dekodolásának képességét"

- csak 2 kivezetése lesz

- csak 4GB

ez a meglehetősen topa entry-level kártya annál többet biztos nem ér infláció meg emelkedett anyagárak ide vagy oda.Szerintem az van, hogy az AMD ezt valójában nem akarja hozzáértő prohardver olvasó DIY fogyasztóknak eladni. Ez egy OEM-eknek szánt kártya. Elsősorban mobil gépekbe, másodsorban ilyen Aldi-s Medion gépekbe, amit potenciálisan olyanok fognak megvenni, akiket ez nem fog korlátozni, vagy nem zavar, mert nem is értik.

Az elmúlt hetekben épp azon morfondíroztam, hogy ha már ennyire vezet a Mindfactory adatok alapján a 6600/XT és a 3060 a DIY piacon, akkor atyaúristen, mekkora volumenben fog elkelni a Navi24, ami olcsóbb és a 4GB miatt talán még ténylegesen közel msrp áron is lesz kapható. De ezt így elnézve már meglepne.

Persze az éhség nagy úr.(Különös, hogy az ember mennyire nincs is tisztában az igényeivel és hogy mennyire látens módon tudnak felbukkanni. Én most 2 monitort használok, de örömmel használnék 3-at is, de se monitorom nincs, se konzol, ami tartaná. Viszont mivel ez már itt van a látóteremben így 2 kivezetéssel rendelkező kártyát már nem vennék szívesen. Az meg hogy csak szimplán letiltják a képességet, hát az meg elképesztő.)

Találgatunk, aztán majd úgyis kiderül..

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Vezetékes FEJhallgatók

- Formula-1

- Kávé kezdőknek - amatőr koffeinisták anonim klubja

- Autós topik

- Intel Core i5 / i7 / i9 "Alder Lake-Raptor Lake/Refresh" (LGA1700)

- Max

- Íme az új Android Auto!

- Folyószámla, bankszámla, bankváltás, külföldi kártyahasználat

- Vírusirtó topic

- Politika

- További aktív témák...

![;]](http://cdn.rios.hu/dl/s/v1.gif) ). De én GeForce-on nem teszteltem.

). De én GeForce-on nem teszteltem.