- Hálózati / IP kamera

- Mobilinternet

- Szilárdtest-akkumulátorokat fejleszt Kína, jöhet az áttörés?

- Microsoft Office és Office 365 topic

- Kodi és kiegészítői magyar nyelvű online tartalmakhoz (Linux, Windows)

- Synology NAS

- eBay

- Bittorrent topik

- Rejtett díjak, nehéz lemondás: az USA pereli az Adobe-ot

- Olimpia: az AI majd törli a sértő bejegyzéseket

-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Alogonomus

őstag

A fő igazság az, hogy aki esetleg első kézből tudja is pontosan a teljes igazságot, az is csak arról az egy programról, de talán csak annak a programnak az adott moduljáról tud mindent a működés szempontjából. Na talán az AMD/Nvidia felsőbb szintjein viszonylag tág rálátásuk lehet a helyzetre, de az is valószínűleg állandóan változik, ahogy kijönnek a programokhoz a különböző funkciókat ki-bekapcsoló foltozások.

Igen, a VRAM a gond az Nvidia kártyákon (még az RTX 3090-en is), mert az Nvidia kártyákon - az adatfeldolgozási lehetőségeik miatt - hamar elszalad a memóriaigény, és rákényszerülnek a számítógép rendszermemóriájának a használatára (swappelésre), amitől nagyon visszaesik a teljesítményük. Ez is például egy olyan funkció, amiben az Nvidia kártyák kimondottan gyengék, ezért a jelenlegi generációig tudatosan kerülték ezt a funkciót a programokban, de mostantól az AMD kártyáin már nyugodtan bekapcsolható, és amelyik játékban fontosak a külső terek, ott ez a funkció kritikus fontosságú, és már bekapcsolhatják a játékban, csak legfeljebb az Nvidia kártyája nagyon szenvedni fog tőle.

A skálázhatóság csak a minőség rovására oldhatja meg a dolgot, így csak lecserélnék vele a problémát egy másik problémára.

A HU "csipája valóban kinyílt" a szinte totális győzelmükkel végződött esemény után, de már maga az esemény is azért következett be, mert előtte is "szúrta" a csatorna az Nvidia "szemét", mert nem álltak be az Nvidia-mozdony mögé, és a saját véleményüket közölték a hivatalos prospektusadatok ismétlése helyett. Ebből persze volt már addig is több konfliktusuk különböző piaci szereplőkkel, de pont a bevállalós őszinteségük miatt tűntek ki a tömegből, ezért tudtak megkapaszkodni, és mára közepesen komoly súlyú szereplővé válni.

A jelenlegi helyzetben már minden véleményhez lehet találni igazolásként lobogtatható "bizonyítékot" az interneten, ahogy a UserBenchmark például fix hivatkozási alap az Intel-hívőknek.

Végül a tények számítanak, és 2021 végéig várhatóan kitisztul a helyzet, hogy mik a tényleges erőviszonyok a két architektúra között, mert most csak sok Nvidia-játék van, meg pár AMD-játék, és ezekben a megfelelő gyártó termékei a jobbak. Valamint pár Nvidia-játékban az AMD az "ellenszél" mellett is jobb pozícióban van.[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

A DXR 1.1 a DXR 1.0-hoz hasonlóan egy zsákutca lesz sajnos. Maga a ray query jó ötletnek tűnik, mert valóban sokat segít a fejlesztői oldalon, de kizárja a sugarak sorba rendezésének lehetőségét a koherencia alapján, és ezzel egy potenciális hardveres irányt vág el. Szóval ebből visszatáncolás lesz PC-n, de nem a DXR 1.0-hoz, mert az is zsákutca a dinamikus linkelés miatt. Az a rendszer lesz, amit a Microsoft az Xbox Series S/X-re fejlesztett, mert azzal a kódbázis tetszőlegesen szállítható PC és Xbox között. Ráadásul a rendszer programozható, és nem zár ki potenciális jövőbeli irányokat.

A számítási kapacitás annyira nem hiányzik, maximum ha szarul van megírva a motor. A valós probléma más. Ezeket egyébként elég jól összefoglalta az Intel a múlt év végén: [link] - érdemes megnézni, hogy mennyire elegáns a megoldásuk. Igaz traversal shader kell hozzá, de egy rakás terhet levesz a VRAM-ról, és nem számol feleslegesen.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Jack@l

veterán

Nv-ben a dedikált RT magok kb 6x gyorsabban szamolnak raytracinget, mint az általános gpgpu-s megoldások(sima cuda magok). A nyers számítási teljesítményt sehogyan nem fogod szoftveresen kompenzálni, csak butítással/trükközéssel. (akkor meg már ninek az RT)

[ Szerkesztve ]

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

Alogonomus

őstag

Hol mondtam azt, hogy a másik a jó megoldás? Egyértelműen jó megoldás nincs, csak kompromisszumok, amik egyik esetben egyiket hozzák jobb helyzetbe, másik esetben másikat. Egyik merevebb, de a jelenlegi felhozatalhoz jobban illeszkedik, mert a felhozatalt ahhoz tervezték; a másik rugalmasabb, de még nem nyilvánvaló a rugalmasságának az egyértelmű haszna.

-

Petykemano

veterán

Veled is egyetértek. Én is ezt írtam volna, de aztán kitöröltem, mert jelenleg semmi jelentősége nincs' atekintetben, hogy 20% a részesedés. 30%-kal gyorsabb és enefgiahatékonyabb kártyákkal is ugyanennyi lenne a részesedés és ugyanennyi lenne az ár.

A DLSS azért más, mert az szoftver. És azért lenne fontos és izgalmas, mert alacsony felbontáson az amdnek.van előnye, márpedig a dlss alapvetően alacsony felbontáson számolt felskálázás.

Találgatunk, aztán majd úgyis kiderül..

-

Busterftw

veterán

Eleve ez volt a szoveg a PS4 idejeben.

Az AMD csapata nem fejleszthet bekesen, mert a csucstechnika akkorat utott, ami Q3-rol Q4-re 6% minuszt jelentett market shareben. (23%-17%).

Volumenben 30%-al kevesebb Radeont adtak el.Az AMD-nek legalabb 1 genig tartosan jobbnak kene lennie az Nvidianal, hogy barmi erdemleges valtozas legyen. Ha RDNA 1 nem, RDNA2 sem, talan majd a kovetkezo.

Csak aztan mindig varunk a kovetkezore.

-

Petykemano

veterán

"Nagyon helyre kell tennie a PC gaming renoméját mindkét gyártónak ez után az év után . olyat kell dobniuk, amit még nem láttunk szerintem."

Ők most vannak nyerőben. Szerintem szerintük most van a helyén a renomé. Most már őszinte mosollyal mondják: "We love PC gaming."

Mármint...

értem ZION aggodalmát arra vonatkozólag, hogy ha tartósan ilyen árak lesznek akkor a vevők elfordulnak a piactól és majd 2-3 év múlva megnézhetik magukat. De tudjuk milyen, amikor valaki úgy érzi, nyerőben van...[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Arra gondolsz, hogy a GPU mining kapacitást döntően az ETH1 rendszer használja el? És ha megtörténik az ETH2-re való átállás, akkor "nem lesz Mit bányászni"? Merthogy hiába van még másik többezer coin, azt nem éri meg (annyira)

Ha igen, akkor annyiban egyet tudok érteni, hogy ha a pénz az ethereumbe áramlott és a többi coin árfolyama alapján nem éri meg Azokat bányászni, akkor elméletileg tényleg csökkenhet a bányásat irányából a kereslet. Az árfolyamot nem az hajtja fel, hogy mennyien bányásszák, hanem a beáramló pénz.

Ugyanakkor az ETH1 -> ETH2 átállás nem kötelező, mégha nem is átjárható (oda-vissza) a két hálózat.

Miből gondolod, hogy a tőke (ami az ETH vonzerejét adja) váltani fog ETH2-re? Elméletileg lehetséges, hogy létezzen egy ETH2 hálózat, amit döntően azok használnak, akik tényleg fizetőészközként használják és egy ETH1, ami továbbra is tőkespekulációs cél marad és emiatt nem zuhan be az árfolyam és továbbra is megéri a régi hálózatban bányászni.Tehát a gpu bányászat hanyatlásához két dolog kell

1) hogy az ETH tényleg annyira domináns legyen a többi coin felett, hogy kiesésével - vagyis kás coinok bányászásával - már ne érje meg

2) hogy az ETH1 felszámolódjonDe ha Valamit rosszul látok javíts ki.

És mégegy: hogy érted, hogy a CPU lesz a célhardver?

Találgatunk, aztán majd úgyis kiderül..

-

Abu85

HÁZIGAZDA

Ezt különösebben leszarják szerintem. Ellenben azért a Resizable BAR ma azért hoz az AMD SAM-en 7-13%-ot, mert nem erre voltak tervezve a játékok. A jövőben maga a funkció 20-30%-os előnnyel is járhat, amikor már a konzolról úgy portolnak, hogy az új gépekben (nem csak az AMD-nél ugye, hanem az NV-nél is) van Resizable BAR lehetőség. Ez azért nem mindegy.

#54937 Petykemano : Mert a cégek arról híresek, hogy hallgatnak a médiára. Megírhatom minden nap az Intelnek, AMD-nek és az NV-nek is, hogy kényszerítsék a boltokat arra, hogy adják MSRP árban a termékeket, de ebből nem lesz semmi. Ti vásárlók tudtok ellene tenni azzal, hogy nem veszitek meg a túlárazott termékeket. Abból érteni fognak, óóó nagyon is.

De amíg használt termékért is irtózatos pénzeket fizetnek ki manapság, addig nem fog változni semmi.

De amíg használt termékért is irtózatos pénzeket fizetnek ki manapság, addig nem fog változni semmi. [ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Éppenséggel se Turingon, se Navi 1x-en nincs ReBAR. Szóval azok számára ez a tényező lényegtelen.

#54942 Petykemano : Mit tud tenni a média? A termékek árát a kereslet-kínálat határozza meg. A média ellenben nem kereskedelmi tényező. Ír termékekről, leteszteli azokat, ír róluk egy véleményt, aztán vagy megveszi az olvasó, vagy nem.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Piszmaty76

aktív tag

Pedig nekem úgy tűnik, hogy Abu cikkjeiben ill. hozzászólásaiban messze több szakmaiság és értelem van a személyeskedő kommentvadász ideböfögésekkel szemben. Az más kérdés, hogy ki mennyire ért egyet Abu mondandójával. Ő legalább próbálja kultúráltan elmagyarázni, miért írta azt amit írt. És nem, most nem rád céloztam. És nem, az önjelölt ügyvédje sem vagyok.

Thermaltake Overseer RX-1, Seasonic Prime 750W Titanium, ASUS C8H X570 wifi, R9 5900X, Thermalright Peerless Assassin SE, G.SKILL 32GB KIT DDR4 3600MHz CL16 Trident Z RGB, Sapphire 7900XTX Nitro+, Samsung 960 pro NVME gen3. 256GB/Kingston KC3000 NVME gen4. 2TB, LG QNED863QA 55" (HDMI 2.1)

-

killbull

aktív tag

Igen, az hogy nem crashelget a géped csontra állva, vagy WIN 10 lemezzel javítgathatod a rendszered. Egy egyszerű usernek ez már advenced, és NVIDIA érdekes csak lassul nem crashel.

Itt vannak a példák amit ismerős mondott, ez NVIDIA nál nem megengedett, egyszerűen nem tehetik meg az userekkel, és mindig bevillan a múltkori AMD driver mizériám ahol már azon a szinten voltam hogy hardveresen hibásodott meg a gépem valamitől, azt közbe AMD driver hazavágta a gépet hogy 30 percig se játék se youtubozás mert állóra fagyott mindig.

[ Szerkesztve ]

-

awexco

őstag

-

killbull

aktív tag

-

Alogonomus

őstag

A két gyártó azonos időben elérhető architektúráihoz mértem. Egyébként az RDNA2 kártyákat az Ampere kártyákhoz mérve is egyedül a 3060 Ti és 3070 közé eső 6700 XT esetén előnyösebb minimálisan (4,21 vs 4,2) az 3070, de az is csak 1440p és afölötti felbontásnál. Televan kolléga a 100 ezer forintos kívánt árával viszont valószínűleg az 1080p kategóriában gondolkozik, ahol az Infinity Cache miatt az RDNA2 sokat erősödik az 1440p esetén kirajzolódó helyzethez képest.

-

Bár az egész összehasonlítás hülyeség a részemről is a jelenlegi helyzetben. Jelenleg a legjobb vétel a Ps5- Xbox 1080 P re ( is).,.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Alogonomus

őstag

"A 3 éves Turing elérhető az RDNA2 vel szemben? vagy mi?"

Látom a szövegértelmezés továbbra sem erősséged. Azt írtam, hogy "bőven jobb ajánlatok lennének, mint az előző generációs RDNA1, és messze jobb, mint a Turing kártyák". Vagyis az RDNA2 kártyákat az RDNA1 és a Turing kártyákhoz mérve határoztam meg abban a mondatomban. Tehát az "azonos időben elérhető" alatt egyértelműen az RDNA1 és Turing architektúrát értettem.A piacra valóban előbb kerültek ki az Ampere kártyák, bár az RDNA2 architektúra már legalább 2020 elejétől kezdve ott működött a konzolra fejlesztő stúdiók tesztgépeiben, csak önálló kártyaként még nem hozta ki az AMD, míg az Nvidia kapkodva kihozta szeptemberben, és az elkapkodott kiadással érkezett is a stabilitási probléma.

"és ezt megint honnan, hogy az IC. miatt erősödik1080P ben?"

Például abból, hogy 1080p-ben garantáltan kevesebb adattal kell dolgoznia a chipnek, így nagyobb eséllyel lesz még az IC tárhelyében a szükséges adat, vagyis kisebb késleltetéssel tudja a feldolgozást végezni az RDNA2 chip.

Pedig reméltem, hogy ez az összefüggés azért nyilvánvaló számodra.

[ Szerkesztve ]

-

-

Petykemano

veterán

A következő nagy dobás...

A 7000-es széria technikaikag egy rebrand lesz. Ugyanazokat a chipeket fogják eladni.

6900XT => 7900XT

6600XT => 7600XT

Stb

Az előrelépést az fogja hozni, hogy már működni fog ez a szuper rezolúció. 4K-t már 1440p-ben, 1440p-t 1080P-ben,.stb renderel - default.

És persze minden tier drágább lesz eggyel (+$50), mert súlyos infláció van.Találgatunk, aztán majd úgyis kiderül..

-

KillerKollar

őstag

Ez a 2.5x-3x teljesítményugrás a legnagyobb bullshit amit valaha hallottam, megeszem a kalapom ha ez játékok alatt így lesz. Lehet, hogy papíron annyival gyorsabb lesz, az igaz az Ampere-re is ha valaki szereti nézegetni a TFLOPS számokat, de játékok alatt közel sem annyival gyorsabb mint a Turing. Ha ez az állítás ray-tracingre igaz akkor még elhiszem, mert ott valóban még a dolgok elején járunk, főleg az AMD, így ezen a téren nem volnék meglepve, ha hatalmasat ugranánk előre, de sima raszter teljesítményben? Kizárt.

A matek sem jön ki. Tegyük fel, hogy igaz a 160 CU, 2 chiplet 80-80 CU. Élből a skálázódás soha sem tökéletes, dupla CU nem egyenlő dupla teljesítménnyel. De oké, nőni fog valamennyivel az IPC és ezzel visszahoznak némi teljesítményt. Nade mi lesz az órajelekkel? Elvileg 50%-os perf/watt előreugrás lesz, ha azt mind arra fordítják, hogy arányosan csökkentsék a fogyasztást, akkor jelenlegi órajeleken 450W-ot fogyasztana a kártya (6900XT 300W 80CU-val, 160 CU-val 600 lenne de ha igaz az 50%-os javulás akkor "csak" 450, de ez esetben viszont nem nagyon lesz IPC növekedés sem). A 3090 350W-ot eszik, a 400-at még talán elhiszem de a 450 már nagyon brutális és nagyon komoly ref hűtőt kellene rá tervezniük, így vélhetően egy órajel csökkentés is várható a csúcsmodellnél. És akkor erre jön rá a latency, ugyanis chipletek esetében ez is probléma, és ez eléggé rontja a játékok alatti teljesítményt, lásd Zen 2, IPC-ben az Intel előtt voltak de részben emiatt meg részben az órajelek miatt lassabbak voltak játék alatt mint az öregedő Skylake, még a Zen 3 is csak minimálisan veri az Intelt, pedig az IPC előny már orbitális. Talán az infinity cache segíthet ezen a problémán, de ha mindent sikerül megoldani én akkor is max egy teljesítmény duplázást látok ami így is a legnagyobb ugrás lenne két GPU generáció között nem is tudom mióta, de 3x, arra talán a 90-es évek óta nem volt példa... nagyon fárasztó, hogy így felhypeolják az új GPU-kat mindig, gyakorlatilag lehetetlen elvárásokkal aztán meg bármit is csinálhatnak, úgyis csalódás lesz lehet ez a legjobb videókártya generáció valaha.

Nvidiánál meg az ADA monolitikus dizájnnal 2.2x ugrás az Ampere-hez képest, (szintén JÓVAL nagyobb mint a "legendás" Pascal volt a Maxwell után") de a Hopper "csak" 3x? Akkor az nem nagy ugrás az ADA-hoz képest, pedig pont, hogy ennek kéne a nagy ugrásnak lennie mert ez is MCM... de ha már az ADA 2.2x-t hoz az Ampere-hez képest akkor a Hopper 3x-e szintén az Ampere-hez hasonlítva már nem is olyan nagy szám...

-

Abu85

HÁZIGAZDA

Az FSR működni fog mindenen, ami legalább compute shader 5.0-t és DirectML-t támogat. Szóval ez nem nagy dolog. Kb. az elmúlt tíz év összes hardverével kompatibilis, csak Windows 10 kell hozzá.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Petykemano

veterán

Nem akartam félreérthetően fogalmazni. Nem állt szándékomban azt sugallni, hogy inkább natív 4K.

És mondandómból talán még egy dolog kimaradt: legkevésbé sem állt.szándékomban kétségbe vonni azt, hogy az alacsonyabb felbontás gyakran magasabb terhelésnek teszi ki a processzort (vagy annak legalábbis 1-2 szálát) és így könnyebben válik a limitáció okozójává a CPU. Persze, ha alacsonyabb felbontás mellett gyakrabban jönnek a képkockák, akkor a cpu-Nak is egyre kevesebb ideje van eg-egy képkockát előkészíteni és kezelni. Ez alapján könnyen érthető, miért számít itt nagyon a késleltetés és hogy miért skálázódhat a játékban leadott teljesítmény ilyen esetben közel lineárisan a CPU egyszálas teljesítményével.

Eltekintve attól, hogy mindig létezik egy minimum magszám (régen 2, később 4, jelenleg inkább 6) és attól, hogy sokjátékos multiplayeres játékokban, meg streamelés mellett bizonyíthatóan jól jön a magas magszám... korábban egyáltalán nem volt jellemző, hogy egy teszt során azonos egyszálas teljesítményű, se eltérő magszámú processzorok jelentős eltérést mutassanak teljesítményben.

Persze ma már a target a 8/16 + dedikált háttértár feldolgozó a target. Tehát egy olyan helyzet előállhat, hogy egy tegnapelőtti 6 magos CPU 2 év múlva okés lesz natív 4K 60fps-hez egy adott gpu mellett, de a 1440p 90fps-hez (és így persze a felskálázott 4K-hoz is) kevés lesz.

Viszont az eddigi tapasztalat az, hogy ezt a problémát sokkalta jobban megoldja egy korszerű 6 magos, mint egy tegnapelőtti 8 vagy 12 magos.

Találgatunk, aztán majd úgyis kiderül..

-

awexco

őstag

A bevágott képek alapján elég durván rontja a képet.

Valaki bevágott egy videót a bemutatóról . Azon látható .

Bár arra a felbontásra lennék kíváncsi amin számol . Ahozz képest milyen .

Erről az egészről az mp3 jutott eszembe . Arra is mondták hogy sokat ront a minőségen de végül mindenki azt használta mert a helytakarékos mivolta hasznosnak minősült .I5-6600K + rx5700xt + LG 24GM77

-

Petykemano

veterán

"azért kiütni max a fejlesztőknél lehet ezzel ,de mi nem azok vagyunk, kérdés, hogy ez nekünk is jó lesz e?"

Pontosan."Kérdés hogy mi, nvidia felhasználók is jól járunk e azzal, ha a fejlesztő nem a DLSS 2.1 vagy későbbi verziókat adja nekünk, hanem az FSR-t mondjuk egy RTX 2060 tól felfelé."

Lehet, hogy félreérthető volt a hangsúlyom. Nem annyira dícsérni akartam az AMD-t.

A megoldásnak szerintem mindenképp elfogadható minőséget kell produkálnia - mégha ez gyengébb is, mint a minden szempontból erőforrásigényesebb DLSS-nek. (ide értve a tensor magokat a hardverben és a képfeljavító algoritmus implementációs költségét)

Az AMD célja egy olcsóbban implementálható és szélesebb körben használható megoldás kínálata volt. Nem neked, hanem a fejlesztőknek. Ha ez sikerül, vagyis a programokba bekerül, akkor kikerül a képből az a nyomós érv az Nvidia kártya mellől, hogy ott van DLSS.

(Hogy egész pontos legyek leszűkülhet az érvelés vájtszeműek társaságára, akik a képminőséget bogarásszák)Ez volt az MLiD által bemutatott agenda.

Teszem hozzá azt is megemlítette, hogy az RDNA3-ban jöhet az FSR-hez gyorsítás. (Talán egy integrált Xilinx FPGA?)Találgatunk, aztán majd úgyis kiderül..

-

GeryFlash

veterán

Ezzel kb ugyanott vagyunk mintha lecsavarod a grafikat... Ki gondolta volna hogy a tréningelés megspórolásával közelében nem lesz a DLSS-nek.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

paprobert

senior tag

Abból kiindulva, ahogyan az AMD prezentálta a technológiát, esélyes, hogy minőségben nem fog tudni versenyezni az FSR, valószínűleg ezért maradtak a számoknál inkább.

Én már látom magam előtt az elnevezésekkel való trükközést. DLSS quality mód FSR quality móddal összemérve. (1/4 a 2/4-gyel.)

Az ehhez tartozó érvet is:

"Igaz hogy csúnyább az FSR, de nézd mennyivel gyorsabb! És még van Ultra Quality is, amit a DLSS nem tud."

Ettől függetlenül nem akarom elkönyvelni előre a meccset. Haszna akkor is lesz az FSR-nek ha csak DLSS1.0 szintet hoz. Nem túl sok, de lesz.

[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

-

KillerKollar

őstag

RedGamingTech-re kíváncsi lennék, egy oldalról Ő volt az aki először beszélt az AMD Infinity Cache-ről ami valóban egy olyan újdonság volt amiről csak akkor tudhatott, hogy ha valóban vannak megbízható forrásai az AMD-nél. Ugyanakkor most Ő nyomja, hogy a csúcs RDNA 3 több mint 2.5x gyorsabb lesz mint a 6900XT és kiemelte, hogy nem a ray-tracingről beszél, ami nekem nagyon sus...

-

Petykemano

veterán

Én nem vagyok 100%-ig biztos, de jó jelölt.

Csak azokhoz a termékekhez, ahol jelenleg semi-custom AMD VGA-t használnak, szerintem nem fognak gpu-t gyártani. Lehet, hogy az Imagination fel tudna skálázódni, vagy legalábbis meg tudná oldani az Imagination és az Apple. De ez szerintem lényegesen kisebb példányszámú piac, mint az, ahová az M1-et fejlesztik. Tehát nem is biztos, hogy meg tudná érni a gyártás beindítása.Tehát két esélyét látom:

a) belépnek a felhő piacba. Erre minden esély megvan. Apple országban Apple készüléket használsz, a adatait Apple felhőben tárolódnak, Apple gaming cloud-ban játszol, és Apple hardveren futó adatközpontban számolják ki a következő lépésed és hogy mit vehetnél meg még.

Erre alkalmas lehet egy dGPU, amit a gyártási volumen növelése érdekében elpasszolhatnak a MAC-ekben is. Ugyanakkor ezt meg lehet torpedózni azzal az érveléssel, hogy a tensor vagy más célhardver hatékonyabb. Ami igaz.

Ez a cloud vs kliensoldali compute vagy a célhardver vs general még valószínűleg velünk marad egy ideig.

b) Képesek csinálni egy olyan megoldást - hasonlóan az intelhez -, amely tile-szerűen skálázhatóvá teszi az egyes összeállításokban a M1-hez hasonló lapkákat. Iphone-ba 1xM1, notebookba 2xM1, MAc Proba 8xM1

Sok mag, vastag GPU, heterogén compute, memória koherencia.Találgatunk, aztán majd úgyis kiderül..

-

kisfurko

senior tag

Már leírtuk egyszer, hogy nem a gyártástechnológián csúszott el az Nvidia, hanem gyengébbre várta az AMD-t. A Titan szintű chipet (102) kellett 3080-ként eladnia, hogy megfogja a 6800-at, eredetileg a 104-es chip lett volna a 3080, mint korábban.

Az árakkal meg kár is foglalkozni, azok teljesen irreálisak, csak a hülyék és a nagyon rászorultak (elromlott, kell az iskolához stb.) vesznek meg ennyiért valamit. -

kisfurko

senior tag

Ok, ebben megegyezhetünk.

Nekem mindegy, hogy az AMD lett a vártnál erősebb, vagy az Nvidia lassabb a Samsung miatt. Szerintem is-is. Nehéz utólag megállapítani, hogy túl kellett-e húzni, vagy nem érték el alapból a tervezett frekvenciákat. Ezt csak az Nvidia tudja, de ők hallgatnak, mint a sír, mint mindig. A következmény a lényeg, hogy a 102 ment 80-asnak. Ettől vannak a hülye teljesítménylukak.

Szerintem is-is. Nehéz utólag megállapítani, hogy túl kellett-e húzni, vagy nem érték el alapból a tervezett frekvenciákat. Ezt csak az Nvidia tudja, de ők hallgatnak, mint a sír, mint mindig. A következmény a lényeg, hogy a 102 ment 80-asnak. Ettől vannak a hülye teljesítménylukak. -

Obliterátor

tag

Lehet h az Amd egy szemét mert 399-ért ad egy 1080ti teljesítményű 128 bites kártyát. De az NV mitől lesz jobb fej amikor egy 1080ti -10% teljesíményű 192 bites kártyát adnak 329 dolláros áron ? Egyikkel se fogsz max grafon 4k-n a legújabb AAA címekkel játszani. Arra még a 3080 is kevés.

[ Szerkesztve ]

-

Obliterátor

tag

Nem haragszom , de egyszerűen kifejtem neked : mivel régóta folyamatosan követem a topikot van szerencsém hónapok óta követni azt a fika hadjáratot , amit az AMD ellen folytatsz. Nem mondom h nincs benne igazság csupán az zavar h a konkurencia hasonló topicjába még egy rossz szót se szóltál soha pedig ott is van egy ugyanilyen fos termék. Ha hiteles és korrekt akarsz lenni akkor miért csak itt megy a hadjárat ? Vagy ez csak arról szól h utálod Abu-t s ha ír valamit akkor azonnal ugrani kell rá ? . Az emberek munka után nem ezért járnak fel ide h ezt olvassák hanem h érdeklődjenek a hardvare piac aktuális állásáról. Majd ők levonják a megfelelő következtetést a várható paraméterekből.

-

Alogonomus

őstag

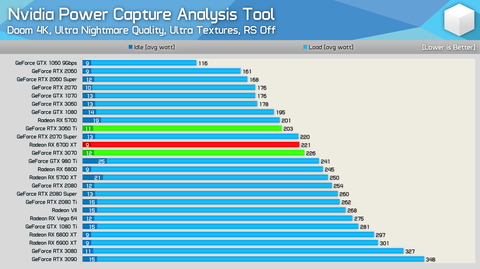

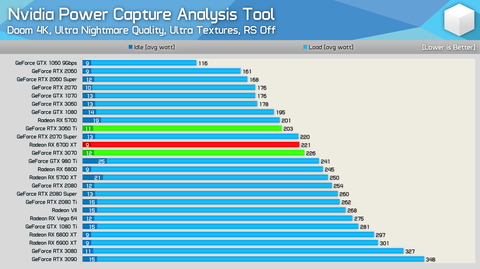

Ha vitatkozni próbálsz, legalább téged igazoló tesztről linkeljél mérést. A Tom's Hardware tesztje szerint is az alap RX 6800 XT 302/307 Wattot, míg az alap RTX 3080 332/334 Wattot fogyasztott.

De akár vessél akkor erre egy pillantást.

Az ugyanolyan kialakítású AIB kártyák ventilátorsebessége is a HWU és az általad linkelt értékeket igazolja. Még a Tom's Hardware listája alapján is erősebb az RX 6800 XT, mint a valójában 30 Wattal "éhesebb" RTX 3080.

Józanodj ki a legénybúcsú után. Vagy a fentieket már elvileg kijózanodás után írtad?

[ Szerkesztve ]

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

De amíg használt termékért is irtózatos pénzeket fizetnek ki manapság, addig nem fog változni semmi.

De amíg használt termékért is irtózatos pénzeket fizetnek ki manapság, addig nem fog változni semmi.

![;]](http://cdn.rios.hu/dl/s/v1.gif)