Új hozzászólás Aktív témák

-

stratova

veterán

válasz

Casanova*

#1276

üzenetére

Casanova*

#1276

üzenetére

A ref.GTX Vapor chambert kap. A ref AMD nem. Stimmt. Viszont egy egyedi hűtésű még mindig NV ára alatt van.

A nem referencia 290 még csak mostanság szivárog be hozzánk, de jó a teljesítménye, hőmérséklete és hangja is.(#1300) HSM: Csak halkan szólok GTX-re írtam gyárilag adott Vaport nem 290/290X-re

[ Szerkesztve ]

-

stratova

veterán

válasz

Casanova*

#1374

üzenetére

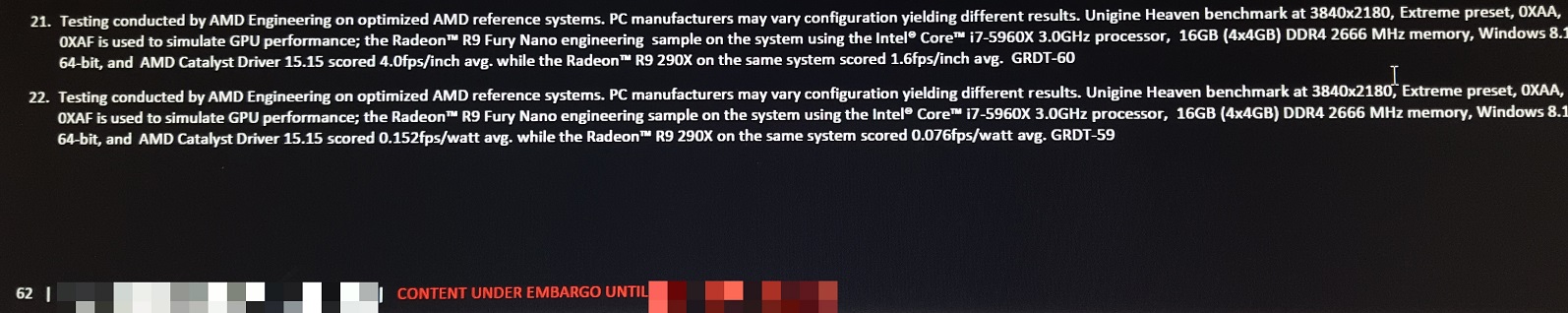

Casanova*

#1374

üzenetére

Ők más irányt választottak. OpenGL-re gyúrnak (Steam OS) és GameWorks effektcsomaggal édesgetik a fejlesztőket.

A fentebb felmerült G-sync ingyenes alternatívája egyébként az AMD oldalon már mintegy 3 generáció óta rendelkezésre áll és FreeSync lesz szabványosítva, itt a kérdéses terület a támogatott kijelzők köre (illetve, hogy a kijelzők gyártói adnak-e hozzájuk ki firmware frissítést).

-

stratova

veterán

válasz

BlackSoft

#1783

üzenetére

BlackSoft

#1783

üzenetére

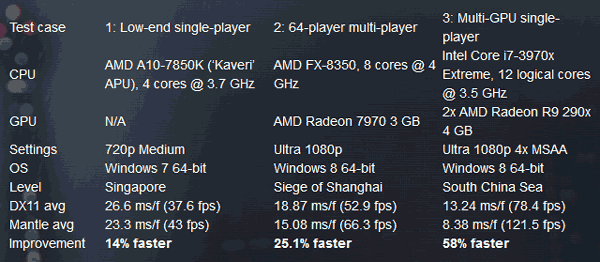

Nem 3 csak 2 kártya van a 3. konfigurációban.

Azt mondjuk ne hagyd figyelmen kívül, hogy ez egy 6/12-es CPU 3.5 GHz-en jó indulattal egy kalap alá vehetnénk vele a 4.7 GHz-es 4/8-asat és szerintem egy i7-4770K + 290X CF konfiguráció már akár egészen életszerű/ésszerű is lenne.

Egyébként ki az aki egyetlen 290X mellé i7-3970X-et venne játék céllal?

(#1788) BlackSoft OK egyetlen kártya mellett hajtasz i7-3930K-t (ami éppen a 6/12-es sweetspot, ebben teljes az egyetértés), de nyugtass meg, hogy ezt a konfigurációt nem csak játékra használod ebben a felállásban.

[ Szerkesztve ]

-

stratova

veterán

válasz

gainwardgs

#1820

üzenetére

gainwardgs

#1820

üzenetére

Hát no, megnézném egy 4.7 GHz-es i7-3970X mellett mégis minek kellene CPU limitesnek lennie

Abu: egy időben a VGA tesztekhez készítettetek in-game képeket, pár felszanáló beszámolója alapján Mantle alatt BF4-ben több a füst (ez kinek jó kinek nem) ill. állítólag szebb a víz.

Terveben van esetleg Mantle valamint - ha valaki implementálja - GameWorks / DX 11.2 elemzése a későbbiekben Abu-s mértékben?

[ Szerkesztve ]

-

stratova

veterán

Azt passzolom, de egész látványos lesz a maga módján.

Last plant standing a virágos kertben.Kb. mint amikor Wromsből kijött a 3D.

Abu: Vajon rágyúrnak majd a TrueAudio jelentőségére? Azaz pl. ha lopakodni/rejtőzködni kell, kidolgozzák-e "merre kell fülelünk."

Mert ha igen, akkor ez lenne az első olyan játék ahol egyben hatással is lehetne a játékmenetre.

Mert ha igen, akkor ez lenne az első olyan játék ahol egyben hatással is lehetne a játékmenetre.[ Szerkesztve ]

-

stratova

veterán

válasz

Malibutomi

#1847

üzenetére

Malibutomi

#1847

üzenetére

Majd amikor RTS nézetben bevetsz egy teljes szántót

[ Szerkesztve ]

-

stratova

veterán

Ilyen szempontból a Steam kezdeményezése is motiváció lehet DX fejlesztésére, mert ha Vavle több címet tud felsorakoztatni egy fejlettebb OpenGL-en*, akkor már van két Dx-szel (érdemben) konkuráló API is.

Más unokatestvérem tapasztalatai szerint érdekes módon egy K4000-es kártyával kevesebb hibát produkál BF3/BF4, mint a hasonló kategóriában utazó Gef. kártyák.

Ezt kissé furcsálltam mert eddig úgy tudtam, Quadro kártyáknál a kiemelt terméktámogatás a profi alkalmazások miatt van, de olybá tűnik időnként játékok alatt is előnyösebb. Talán a kiforrottabb driver miatt. Hasonló (vagy akár ennek ellentmondó) tapasztalata valakinek?[ Szerkesztve ]

-

stratova

veterán

válasz

Locutus

#1919

üzenetére

Locutus

#1919

üzenetére

Szerintem ő még a béta időszakban is játszott vele. Ami nekem ebben furcsa volt, hogy béta fázisban én játékból való kidobást alapvetően az alkalmaznának tulajdonítanék, ezzel szemben neki már akkor sem volt ilyen panasza a míg Geforceos csapattársainak igen. Ezért kérdeztem rá hasonló tapasztalatra vagy a jelen állapotra. Eszerint mára nincs ilyen jelenség.

-

stratova

veterán

Állítólag maga Mantle kidolgozása PC vonalra már töredék erőforrásigényt vont maga után, a konzolos mutatványhoz képest.

Ezt a feature level kérdéskört úgy tudom elképzelni, hogy az adott Dx 11.2-es játék esetleg elindul az említett Nvidia kártyákon, csak nem tud majd pl. minden effektet kihasználni (vagy más megoldást alkalmaz). Már ha tényleg fut majd.

Ebben az esetben viszont minden egyes játékteszt megkívánna legalább egy képi de még jobb esetben videós összehasonlítást, hogy lássuk a valóságban mennyire vehető észre az esetleges eltérés.

-

stratova

veterán

válasz

tejeskifly

#1962

üzenetére

tejeskifly

#1962

üzenetére

Erre kíváncsi leszek. Ha egyáltalán nem futnának rajta egyes játékok, az okkal lenne bili-borogató hatással. Pl. egy GTX Titan Black esetében. Ez nem éppen az a kártya, amit egy-két év alatt csak úgy le kellene cserélnie az embernek:

Nekem abszolút szimpatikus GCN fejlettsége (pláne mint hardvert ritkán cserélő ember számára jó ez). De meg kell hagyni, Nvidia is igen ügyesen sakkozott a GT 750/750 Ti megalkotásakor a teljesítmény/fogyasztás mutatóval, amivel a mobil szegmensben elég jó pozícióból indul majd Maxwell. Szóval ennek ellensúlyozásaként vagy ügyes árazást vagy átnevezésen túlmutató energiatakarékosságra vonatkozó fejlődést is várnék AMD-től. Ha ez meglesz, akkor mindkét oldal vevőköre jól járt Maxwellel.

[ Szerkesztve ]

-

stratova

veterán

Unom, hogy szétspammeljük a találgatós topikot:

Vélemény: HairWorks problémája: hazavágja Nv korábbi kártyáit is, nem kis bosszúságot okozva ezzel pl a GTX 780Ti/780/770 tulajdonosoknak (Geforce fóruma szerint). Ugye éppen azzal reklámozza Nv Maxwellt hogy a GTX 980-ban bemnutatkozó PolyMoph Engine 3.0 akár 3x nagyobb teljesítményt kínál a GTX 680-ban megjelent 2.0-hoz képest extrém tesszellációs terhelés esetén (amiben egyébként eddig is Nv volt gyorsabb). Most meg is teremtették ennek az igényét..

Előnye, már most több karakteren futtatható beleértve az állatokat.

Erre TressFX 3.0 kínál alternatívát, beleértve a több lépcsős LOD-ot és a szálak többféle árnyalatát.[ Szerkesztve ]

-

stratova

veterán

válasz

Malibutomi

#5842

üzenetére

Malibutomi

#5842

üzenetére

Erre válaszolhatok?

A magasabb ROP teljesítmény miatt. Gbors is említette korábban, hogy kimondottan díjazza ezt a játék.GTX 980 [64 ROP 1126-1266 MHz]

peak: 81.024 GP/sGTX 970 [56 ROP 1050-1250 MHz]

peak: 70.000 GP/sR9 290X [64 ROP max. 1000 MHz]

peak: 64.000 GP/sR9 290 [64 ROP max. 947 MHz]

peak: 60.608 GP/sGTX 780 Ti [48 ROP 875-1020 MHz]

peak: 48.960 GP/s(legmagasabb boost órajellel számolva)

Maxwellben Nv megduplázta a ROP-okat.

[ Szerkesztve ]

-

stratova

veterán

Ha már témánál járunk, akad esetleg már 1.03 ill. 1.04-es HairWorks ON teszt? A múltkori beszélgetésünkről ugrott be.

Szerk.: eredményt még nem láttam de redditen egészen kellemes vegetációt ábrázoló kép tűnt fel.

1.04 adds a negative mipmap bias of -1 which improves texture clarity, especially on fine leaf foliage, quite noticeably.

[ Szerkesztve ]

-

stratova

veterán

Hát a nyitott funkciós kampány mellett kissé érdekes lépés ez AMD-től.

We purposely disabled TressFX on NVIDIA cards. We delivered TressFX on AMD hardware as part of our partnership with AMD.Noha a GPU-PhysX is NV only, ellentétben a GCN és Kepler számára jelenleg nem túl kedvező GameWorks-szel. Más kérdés, hogy egyes fórumok szerint szimpla konfigurációs fájl módosítással újra elérhető Nv VGA-n a TressFX Lichdom: Battlemage alatt.

Gondolom az eladások javulását várták/várják attól, hogy bizonyos címek alatt patchelt változatban csak AMD VGA-ne elérhető az effekt. Nem jött be eszerint a "jó fiú" szerep a kasszánál.

Szaby59: A Witcher 3 Hairworks megjegyzés ettől függetlenül jogos. Ha vki 48 óra alatt talál egy workaround-ot a problémára, akkor arra AMD-nek is illett volna időben rájönnie (legalább annak ismeretében miben gyengébb a hardverük).

[ Szerkesztve ]

-

stratova

veterán

Itt lehet a felhasználók reagálnak máshogy. Azt várnád, hogy egy jó effekt letiltásával a vásárló majd szabotálja az adott gyártót és a konkurenciától vásáról. De amikor ezt egy nagyon várt címmel játsza el egy cég, akkor a felhasználók egy jó része szimplán kártyát cserél, ha pl. AMD tulaj. Igaz van egy réteg, akit Kepler kigolyózása oly' mértékben bosszant fel, hogy inkább Fiji-re vár és nem Maxwellre vált.

Nem nem akar ilyen jövőt senki, de egy-két húzócímmel úgy néz ki mégis erre felé tartunk. -

stratova

veterán

Viszont ezzel a lendülettel, kb. ki lehetne dobni a divatosab deferred leképezőket (full, light pre-pass) és/vagy forward+ vagy hibrid (pl. Ryse) megoldást használni?

DX12, Mantle vs. DX11-et kb úgy képzelem el, hogy az előbbi kettő eleve kisebb CPU overhedet eredményez, míg DX11 esetében Nvidia az overhead kérdését úgy oldotta meg, hogy több processzorszálat is igába hajtott (amin mondjuk 4 szálas érában nem tűnik elvetélt ötletnek, amíg nem éppen a csodálatos AI-król híresek a játékok (vagy éppen ezért)).

Nvidia OpenGL driver parancsilsta támogatása azért egészen látványos (igaz feltételezem ahol ez használatban van, ott kb. az egyetlen feladat ilyenkor a megjelenítés nincs AI stb.). A vonatkozó diasoron pedig éppen ez a szalagcím:

Approaching zero driver overhead

Nem lenne megoldható, hogy ahogyan DX11-ben MS opcionálisan teszi használhatóvá a parancsilstás úgy ez a lehetőség, csak az ebben a szemléltben megjelent játékoknál legyen aktív? Vagy ezzel a fejlettebb AI-t, fizikát felvonultató játékok terjednének (pl. port) lassabban?

Az itteni példa vizsgálja az egyes eljárások előnyét és hátrányát.[ Szerkesztve ]

-

stratova

veterán

válasz

#85552128

#6611

üzenetére

#85552128

#6611

üzenetére

Egy kis fejtágítást egyébként én elfogadnék a mérésre vonatkozóan.

TPU tesztjeit én igen jónak tartom, mind a játékcsomagot mind a fogyasztás mérését tekintve.

Egy dolgot azonban nem értek. Elvileg ők a PCI-csatin mérik a fogyasztást:For this test, we measure the power consumption of only the graphics card via the PCI-Express power connector(s) and PCI-Express bus slot. A Keithley Integra 2700 digital multimeter with 6.5-digit resolution is used for all measurements. Again, the values here only reflect the card's power consumption as measured at its DC inputs, not that of the whole system.

Ami a tápellátásból kiindulva nem léphetné túl a 300 W-ot (PCI-E: 75 W + 8 pin: 150 W + 6 pin: 75 W).

Akkor viszont, hogyan jön ki 344 avg, 370 peak, 424 max

Laja333

Én konkrétan ar R9 390X Gaming-re gondolok.

[ Szerkesztve ]

-

stratova

veterán

válasz

#85552128

#6705

üzenetére

#85552128

#6705

üzenetére

AMD találgatósban egész nap az nV/Gameworks/W3 fikázás ment, senki nem dobta fel, hogy nem oda tartozik...

Ezt visszautasítom

De legalább van egy új AMD-Intel gumicsont.

Szerencsétlen, helyzet hogy nincsen olyan processzoruk, ami ilyen körülmények között megfelelő lenne erre a célra. De szerintem, ha bele tettek volna egy akár "csak" 95 W-os 4 modulos FX-et és ne adj' Isten tojást lehetett volna rajta sütni, nem lettek volna előrébb.

Ez a dizájn szerintem a GPU kompaktságát és e melletti teljesítményét hivatott reklámozni. Hasonlóan kopakt gépet, ilyen arzenállal talán csak az Apple csinált a Mac Pro-val. Abban is FirePro csücsül.[ Szerkesztve ]

-

stratova

veterán

válasz

#85552128

#6715

üzenetére

#85552128

#6715

üzenetére

Ok nem minden nap

, nézek PH-ra napközben. Azt sem szeretném ha az Nv találgatós menne trollkodósba én sem azért járok oda. Ez ott abból a szempontból egyszerűbb, hogy többnyire hadrveres szempontok alapján "szoktunk szájkaratézni", ott meg per pillanat nem sok fogást találni a palettán.

, nézek PH-ra napközben. Azt sem szeretném ha az Nv találgatós menne trollkodósba én sem azért járok oda. Ez ott abból a szempontból egyszerűbb, hogy többnyire hadrveres szempontok alapján "szoktunk szájkaratézni", ott meg per pillanat nem sok fogást találni a palettán.

Ha úgy vesszük az AMD találgatós meg azért pörög ennyire, mert most AMD-n a sor, hogy villantson. Emiatt fokozottabb az érdeklődés, mivel Nvidia már terítette a lapjait.

[ Szerkesztve ]

-

stratova

veterán

válasz

#85552128

#6724

üzenetére

#85552128

#6724

üzenetére

Oké, marketingből baklövés. De mivel lehetett volna promózni?

Ha FuryX GTX 980 Ti - Titan X kaliber, itt pedig már egy dupla GPU-s rendszerről beszélünk, mivel lehetne promózni egy AMD only gépet, aminél a legerősebb 95-220 W-os proci sem "hajt meg" úgy egy Titan X-et mint egy i5-4690K?

Akkor sem ha egy több szálas terhelés tekintetében ideális (azaz nem valós játékterhelést mérő) tesztet veszünk alapul.

Ultimate Gaming Dream- and Coffeemachine?

Szerk.: Ok a reklám értéke vélhetően több lett volna, ha a használati nem is. Szóval biztosan módosítva kellett volna piacra dobni, bő egy év késéssel.

MSI egyszer már elsütötte az AMD only gamer notebookot. Ott szenvedett is A10-4600M/A10-5750M mint disznó a jégen, mert nem bírta rendesen kiszolgálni HD 7970M/8970M-et (Pitcairn XT).[ Szerkesztve ]

-

stratova

veterán

Azért az is igaz, hogy Nv zsinórban könyvelt igen jó negyedéves adatokat. Lehet, hogy csökkent az eladott darabszám, de az árak is emelkedtek némileg.

AMD-nek el is hiszem, hogy CPU vonalon a kanyarban sincsenek az eladások (az hogy a visszaesés mértéke 1:1-ben ennek tudható be, már kétlem).

Arról van bármilyen infó, meddig szól Apple-lel a kizárólagos Tonga XT üzlet? Mert szerintem, azt a GPU-t lehetne még életképesen pozicionálni.Pár gyártónál (pl. Dell) már feltűnt a kínálatban R9 M390X.Ren Hoek Tri-X-szel mi a gond?

[ Szerkesztve ]

-

stratova

veterán

válasz

#35434496

#8314

üzenetére

#35434496

#8314

üzenetére

Ford Fairlane sajtreszelővel BF4-ezett is, le is Zuzu-zta a népet.

Szenvedtem én is egy sort a kontrollerrel de csak Halo 4-ben és abban az volt a poén, hogy ketten toltuk, úgy tényleg nagyon jó. Nem voltam a pontos célzás mintaképe cserébe a vezetés jobban ment.

[ Szerkesztve ]

-

stratova

veterán

Gondolom lesz belőle egyedi hűtésű én inkább a benchet nem nagyon értem ilyen fps-ek mellett.

Oké, hogy Fury előnye 4K-ban nagyobb [Fury X vs. 290X 4K: 100% - 73%, 1440P: 100% - 76%, FHD: 100% - 79%], de ez így milyen mérés..

Árazzák jól és egyen Hawaii-hoz mérten keveset, legyen egy kis mozgolódás 200 alatt is.

[ Szerkesztve ]

-

stratova

veterán

válasz

huskydog17

#16026

üzenetére

huskydog17

#16026

üzenetére

Elvileg a játék 2 GB VRAM-ig low, 3-ig medium 4-től high textúrát engedélyez (ha ez így van 4 től lennie kellene egy ultának is) DX12-nél, ami viszont kimaradt, hogy ugyanebben a tesztben megnézték a kégyszerített magas textúraminőséggel is. Szvsz így még mindig szebb a DX11, de közel sem ekkora a differencia:

DX11 Nano

DX12 Nano "Speichersutz aus" = forced high textures

DX12 980Ti "Speichersutz aus" = forced high textures

Ha jól nézem így alakul a képminőség: DX11 Fury Nano > DX12 GTX 980 Ti 6 GB forced > Fury Nano 4 GB forced > GTX 980 Ti 6 GB DX12. Hiányolom a Fury Nano DX12 és GTX 980 Ti DX11 beállításokat, de ez van.

[ Szerkesztve ]

-

stratova

veterán

Az alapbeállítással együtt legalább négy. Némi eltérés, még a kényszerített beállítás mellett is látható, ami mintha összhangban lenne a kártyák VRAM mennyiségével. Valamennyit biztosan számít az effektek közötti eltérés, de biztosan nem annyit, amit az alap DX12 és DX11 között látunk.

Jó lenne, ha Malubitomi is tudna kb. ebből a kameraállásból egy képet készíteni mindhárom módban [DX12, DX12 forced, DX11], bár neki éppen olyan kártyája van, amelynek nem okozhatna gondot gyári beállítással sem a magas textúraminőség/felbontás.

[ Szerkesztve ]

-

stratova

veterán

válasz

KAMELOT

#16061

üzenetére

KAMELOT

#16061

üzenetére

Szvsz legfeljebb valamilyen inicializációs vagy konfigurációs fájlt szerkeszt át a júzer, ha erre van igénye és lehetősége.

Prof. Hablatyológus, éppen azért linkeltem a korábbi három képet, mert nagyon nem az a DX12 max. ami az első pároson szerepelt, de tény, hogy VRAM függvényében automatikusan skálázza / skálázná a program, csak egyelőre kissé lehangoló az így elért eredmény. Azt mondom várjuk meg milyen eredmények születnek Malubitomi gépével.

-

stratova

veterán

Malibutomi: Mea maxima culpa, hogy elírtam a neved, majd ha akad időd s kedved oszd meg kérlek mire jutottál.

-

stratova

veterán

válasz

#45185024

#16211

üzenetére

#45185024

#16211

üzenetére

Ha a GTX 980-hoz hasonlóan 550$-ről indul, akkor kb. annyi lenne a reális ára.

daveoff az azért nem lenne rossz. Átvenné Nano-tól a leggyorsabb 1x 8 pines kártya szerepét, ami azt is feltételezné, hogy ebből már készülhetne mini kivitel is (bár sok ilyen kártya nincs a piacon Fury Nano, GTX 970 mini, R9 285 compact. GTX 960 mini beéri 6 pinnel). Csak a teljesítmény már kicsivel GTX 980 Ti szint lenne.

[ Szerkesztve ]

-

stratova

veterán

válasz

wjbhbdux

#16216

üzenetére

wjbhbdux

#16216

üzenetére

GTX 1080 nem a csúcs, nem értem miért és kit bánt, hogy a felső kategória 200 W-os fogyasztással meg tudja verni a csúcskategóriát (GTX 980 Ti).

200+ W szintre majd szépen jöhet GTX 1080 Ti, ami nyilván Titan X-et fog enni reggelire.

Másrészt nem csak asztali játékos réteg létezik, szép pénzt lehet leakasztani a mobil GPU-kkal is, mert lényegesen drágábban adják ua. teljesítményt (nyilván egy bizonyos szintig mert a mobil 1 GPU-s csúcs kategória általában megáll a kb. felső kategória alsó lépcsőjén: GTX 980M [12 SMM], GTX 970 [13 SMM]).

Ez a mobilitás ára. Már az is kirívó, hogy NV kihozta a teljes GM204-et mobil vonalon, meg is kéri az árát rendesen: GTX 980 Notebook, a la Quadro M5500.

Asztali szintű teljesítményt vihetsz magaddal.. szörnyű.. Csakhogy ez a kártya már a DTR kategóriás XMG burkolatát is 50-60°C fölé tudja fűteni. Tehát vígan lesz igény ez alatti fogyasztásra jó teljesítménnyel.Polaris 10, 11 is valószínűleg megáll 130 ill 50-60 W-os szinten, amivel ideális az asztali mainstream és a mobil közép és felső kategóriára.

[ Szerkesztve ]

-

stratova

veterán

válasz

westlake

#16238

üzenetére

westlake

#16238

üzenetére

A nagyobbik Polaris kártya elvileg a 349$-os határ alatt marad, tehát nem a GTX 1070 (256 bit 8 GB GDDR5 379$), hanem a rebesgetett GTX 1060Ti (192 bit 6 GB GDDR5 329$) ellenfele lehet inkább, jobb esetben a két kártya között lesz félúton. De igazán használhatna már AMD is 7 GHz-es GDDR5-öt, tippre megint a több részegység alacsonyabb órajel kombinációval élnek.

-

stratova

veterán

Az 1080 promó egész pofás. Ha jól számolgattam akkor GTX 1070 Ti boost órajele 1587 MHz lesz, amennyiben fix a 2048 SP. (Bár az 1080-nál megadott 9 TFlopsra 1758 MHz jönne ki, de egy kicsi kerekítés belefér).

Abu: mivel gondolom NDA miatt konkrét adatokkal nem lehet szolgálni, várhatóan lesz szerencsénk Polarisnál az R7 360-nál alkalmazott memóriánál gyárilag gyorsabb lapkára? (Úgy látom itt használja AMD a legmagasabb órajelet GDDR5-ből).

[ Szerkesztve ]

-

stratova

veterán

Ha a legolcsóbb Freesync monitorról beszélünk akkor kevesebb mint a fele.

-

stratova

veterán

válasz

Laja333

#16309

üzenetére

Laja333

#16309

üzenetére

TL,DR Alert ON

GTX 1080 9 TFlops teljesítményét boost órajelre adták meg [~1758 MHz-re jön ki]. GTX Titan X 1 GHz-en tud 6,144-et, de játék alatt a tipikus órajele nem ennyi:

Plotting frequency and temperature over time shows that Nvidia's GPU Boost rating of 1190MHz drops dramatically once the thermal target is reached. It then stabilizes after several steps at 1164MHz.

Anandtechnél az átlag 1120 MHz.

Így rögtön 6,88-7,1 TFlops lenne az a 6,144. Szvsz egyeseknél (pl. TTomax) ez lényegesen magasabb érték is lehet OC mellett.

Nyilván jó eséllyel fog nagyon szépen boostolni 1070 is, de nem feltétlenül fog Tinan X-et reggelizni. Ha 1080-hoz hasonlóan egy csúcs értékről van szó, akkor ez itt ~1587 MHz aktív 32 SMP-t feltételezve (2048 SP 128 TMU 64 ROP).

GTX 1070 1587 MHz

2048 SP -> 6500,352 GFlops

128 TMU -> 203,136 GT/s

64 ROP -> 101,568 GP/sGTX 1080 1758-2114 MHz

2560 SP -> 9000,96 - 10823,68 GFlops

160 TMU -> 281,28 - 338,24 GT/s

64 ROP -> 112,512 - 135,296 GP/sGTX Titan X 1120-1164 MHz

3072 SP -> 6881,280 - 7151,616 GFlops

192 TMU -> 215,040 - 223,488 GT/s

96 ROP -> 107,520 - 111,744 GP/sGTX Titan X TTomax Ed .

[1530-1550 MHz]

[1530-1550 MHz]3072 SP -> 9400,320 - 9523,200 GFlops

192 TMU -> 293,760 - 297,600 GT/s

96 ROP -> 146,880 - 148,800 GP/sTL,DR Alert OFF

[ Szerkesztve ]

-

stratova

veterán

válasz

actival63

#16384

üzenetére

actival63

#16384

üzenetére

Amíg végleges teszt nincs maradok ennél az elképzelésnél

GTX 1060 Ti [329$]: 1792:112:48 GDDR5 6 GB 1,45-1,5 GHz 5197-5376 GFLOPS

6 GB 192 bit 8 GHz GDDR5 -> 192 GB/s(ha GP106 és GP104-200 közé jön: GP106 4 TFlops, GTX 1070 6,5 TFlops peak)

P10 Pro

[299$]: 2304:144:64 GDDR5 8 GB -> 1,15 GHz mellett 5299 GFLOPS

[299$]: 2304:144:64 GDDR5 8 GB -> 1,15 GHz mellett 5299 GFLOPS

8 GB 256 bit 6 GHz GDDR5 -> 192 GB/s[ Szerkesztve ]

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Honor Magic5 Pro - kamerák bűvöletében

- Kertészet, mezőgazdaság topik

- A fociról könnyedén, egy baráti társaságban

- Energiaital topic

- Milyen egeret válasszak?

- Eredeti játékok OFF topik

- TP-Link WR1043ND router

- Fejhallgató erősítő és DAC topik

- Kerékpárosok, bringások ide!

- OLED TV topic

- További aktív témák...