A Facebook újabb intézkedéssel igyekszik visszanyerni a felhasználók megrendült bizalmát, melyet a közelmúlt eseményei, időnként botrányai idéztek elő. Az egyik legnagyobb gondot az okozza számukra, hogy a felhasználók számának növekedésével egyre szaporodnak azok a már rég megjelent panaszok, melyek egyrészt az álhírek terjesztését érintik, másrészt erős kritikával illetik a Facebook moderálási gyakorlatát. Erre próbálnak most reagálni, amikor kiadták a közösségi alapelvek átdolgozott és kibővített változatát. Ennek legfontosabb eleme, hogy a nemrégiben nyilvánosságra hozott belső moderálási szabályokat beleépítették az alapelvekbe – azzal a céllal, hogy átláthatóbbak legyen a cég, hogy a felhasználók pontosabb képet kapjanak arról, hogy milyen szabályok alapján ítélik meg a feltöltött tartalmakat, bejegyzéseket.

A hivatalos blogban megjelent indoklás szerint a vállalat két okból döntött az irányelvek publikálása mellett: ezek ismeretében a felhasználók számára egyértelmű lesz, hogy egyes árnyalt kérdésekben a Facebook hol húzza meg a határt. Másrészt pedig a különböző területek szakértői is a korábbinál egyszerűbben juttathatnak majd el visszajelzéseket az irányelvekkel kapcsolatban a Facebooknak.

A frissítésről szóló közlemény kiemeli, hogy a Facebooknál a tartalomszabályzó csoport felelős a közösségi alapelvek folyamatos fejlesztéséért. E csapat világszerte 11 irodában működik, tagjai pedig olyan szakértők, akik a terrorizmus és gyűlöletbeszéd felismerésére, gyermekvédelemre szakosodtak. Sokan közülük már a Facebookhoz való csatlakozásuk előtt is e területeken dolgoztak, és heti szinten működnek együtt külső szakmai szervezetekkel is. Bejelentették, hogy a visszajelzések és a társadalmi normák, valamint a nyelvi fejlődés alapján a Facebook közösségi alapelvei időről-időre meg fognak újulni.

Káros tartalmak, fellebbezés

A Facebook mesterséges intelligenciát és a közösségtől érkező jelentéseket használ az erőszakos tartalmak beazonosítására. A felhasználóktól érkező jelentéseket a Community Operations csapat több mint 40 nyelven, köztük magyarul is értő tagjai nézik át a nap 24 órájában: az esetek többségében a jelentéseket 24 órán belül sikerül feldolgozni. Jelenleg a Facebook világszerte összesen 7500 moderátort alkalmaz, ebben a pozícióban mostanra 40 százalékkal többen dolgoznak a cégnek, mint tavaly ilyenkor.

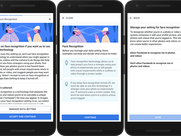

Mostantól egy új fellebbezési folyamat is elérhetővé válik a Facebookon, amelynek segítségével a felhasználók jelezhetik a moderátorok felé, ha véleményük szerint a Facebook hibát követett el egy-egy adott tartalom eltávolításával. Első lépésként mostantól a meztelenség, pornográfia, gyűlöletbeszéd vagy erőszakos tartalom miatt eltávolított bejegyezések kapcsán lehet fellebbezni a Facebooknál.

Így zajlik a fellebbezés folyamata:

- ha egy felhasználó fotóját, videóját vagy bejegyzését eltávolították a közösségi alapelvek megsértése miatt, az erről szóló értesítés mellett meg fog jelenni egy „Request Review” (fellebbezés kérése) opció

- a fellebbezést a Facebook Community Operations részlegének emberi munkatársa vizsgálja meg (általában 24 órán belül)

- amennyiben a Facebook hibázott egy kérdéses tartalom (például bejegyzés, kép vagy videó) eltávolítása kapcsán, azt visszaállítja, és erről értesítést is küld a fellebbezést kérő felhasználónak

Májusban a vállalat Facebook Forums: Community Standards néven rendezvénysorozatot is indít, amelynek keretében közösségi szakértők és civil szervezetek adhatnak visszajelzést a Facebook közösségi alapelveivel kapcsolatban. Az eseménynek Németországban, Franciaországban, az Egyesült Királyságban, Indiában, Szingapúrban, az Egyesült Államokban és a világ egyéb pontjain is lesznek állomásai az idén.