-

IT café

"A Proxmox Virtual Environment (röviden: Proxmox VE, PVE vagy proxmox) egy szerver virtualizációra optimalizált nyilt forráskódú Debian alapú Linux disztribúció. Lehetővé teszi a virtuális gépek és konténerek egyszerű telepítését és kezelését web konzol és command line felülettel. A programcsomag két LXC és OpenVZ konténerek, valamint a KVM alapú virtualizáció kezelését támogatja" (Wikipédia)

Hivatalos oldal: https://proxmox.com/en/

Hivatalos fórum: https://forum.proxmox.com/Véreshurka hozzászólásából

ESXi -> Proxmox migráció

Új hozzászólás Aktív témák

-

amargo

addikt

Sziasztok!

Csatlakoznék egyből egy kérdéssel is

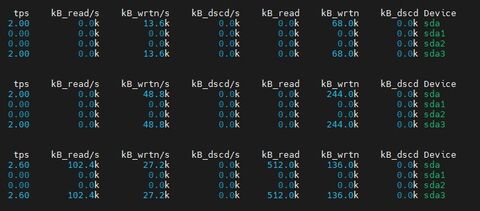

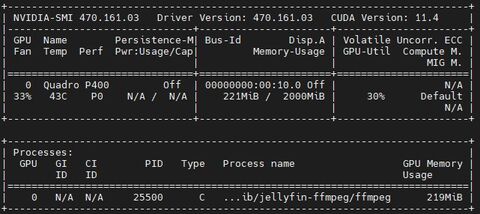

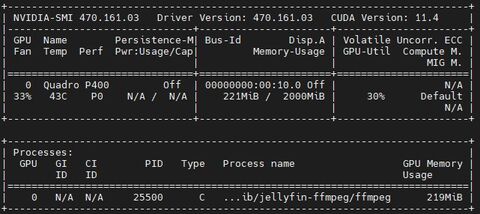

Raktam a gépbe a CPU i7-8700 (és TPU ) mellé egy Quadro P400 GPU-t is.GPU passthrough-ot beállítottam és tesztből felraktam egy VM-re natív-an jellyfin-t

hevc-es stream-et elindítottam

Format : HEVC

Format/Info : High Efficiency Video Coding

Format profile : Main 10@L4@Main

és a htop:

/usr/lib/jellyfin-ffmpeg/ffmpeg -analyzeduration 200M -ss 00:25:06.000 -init_hw_device cuda=cu:0 -filter_hw_device cu -hwaccel cuda -hwaccel_output_format cuda -threads 1 -autorotate 0Látható, hogy a jellyfin nem haszálja ki megfelelően a kártyát vagy nem tudom mi akar itt lenni itt ez a cuda? Nem inkább valami hevc_cuvid-nak kellene itt lennie?

Tehát a fő problémám, hogy a CPU-t ugyan úgy megeszi.

Hmm, most állítottam a jellyfin-en:

/usr/lib/jellyfin-ffmpeg/ffmpeg -analyzeduration 200M -init_hw_device cuda=cu:0 -filter_hw_device cu -hwaccel cuda -hwaccel_output_format cuda -c:v hevc_cuvid -autorotate 0De a két magot ugyan úgy megeszi

kikapcsolt HW transcoding nélkül persze ezt írja:

/usr/lib/jellyfin-ffmpeg/ffmpeg -analyzeduration 200M -ss 00:12:42.000 -f matroska,webm -autorotate 0

és a 2 mag kevés is a stream beletekeréséhez.Lehet én értek félre valamit és ez a transcode ennyire képes csak?

Próbáltam a plex-et, de ott a hw acceleration-t se sikerült az ingyenesen bekapcsolni és nem is jelenik meg az nvidia-smi-ben. 2 magot ugyan úgy elvisz.

Mit rontok el, mit érdemes átnézni? Köszi a segítséget előre is.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Szuper, akkor ezt is tudom, bár láttam ott az nvidia-smi nél kiírva, de inkább kérdezek

Plexnél végül elolvastam ezt teljesen: [link] és megtaláltam ezt a PlexPass előfizetést.. akkor ezt nem próbálom ki most hirtelen.Jellyfin-ben ez ffmpeg-el simán elérhető: [link]

Most annyit javult, hogy kevesebb mint 1,5CPU kell neki már csak. A GPU utilization 90% környékére ment.Dedikált GPU-m se volt az elmúlt 15 évben, de az olvasottak alapján ennél jobban le kellene vinni a CPU utilization-t. Nem?

Mondjuk még tesztelem, mert egy

Format : AVC

Format/Info : Advanced Video Codec

Format profile : High@L4

Format settings : CABAC / 4 Ref Frames

Bit rate : 8 662 kb/s

Nominal bit rate : 10 000 kb/sIlyet 10%-on elvisz

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

noorbertt

#221

üzenetére

noorbertt

#221

üzenetére

Szia!

Ingyenes hónapot beállítottam a Plex-ben. Komoly, most már értem miért szeretik sokan.

Még VM alatt néztem és teljesen jól megy a transcode, bekapcsoltam és 0% lett a CPU utilization.

Bár volt egy olyan pillanat, amikor ugyan az a stream ugyan azon az eszközön lejátszva a szerver CPU-ját kezdte használni. Ezt még nem értem miért. De majd most még tesztelem

felrakom LXC-be is elvileg abban is benne van minden, de miért ne használjak passthrough-t? A proxmox alaprendszerét teljesen "tisztán" szeretném tartani.

Ez is nagyon jó benne, hogy egyből áttudja adni sonarr, radarr-nak. Lehet a Plex-ben "gyerek" sarkot is csinálni? (utána nézek)

Köszönöm a segítséget, a kártya jó és azt csinálja, amit elvártam tőle

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Most néztem meg és az LXC-ben egy ubuntu van és ugye egy DietPi alá pakoltam fel.

Ha már így itt írunk, frigate alatt is használod, hogy a stream-et kicsit alakítsd? Nálam 4K-ak a kamerák azokat CPU-ból csökkenti le.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Köszönöm, utána néztem és nagyon jól lehet korlátozni mindenkit. Nem gondoltam volna, hogy ennyi mindent tud.

Legegyszerűbb az volt, hogy a gyerekeknek a mesék másik könyvtárban vannak és csak azt láthatják.Előfizettem rá és tesztelem

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Jelenleg is úgy van, hogy a gyerekeknek külön container van mindenre, radarr, sonarr, jellyfin, még az ebook-ok is

A Plex -ben is próbáltam életkor alapján is pluszban, de basszus rengeteg mesét kiszürt, nem is értettem. Aztán kiderült, hogy ez régiónként más és más

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

noorbertt

#228

üzenetére

noorbertt

#228

üzenetére

Várjál frigate LXC is van, megnézem

(megnézem docker-ben futtatják

(megnézem docker-ben futtatják  LXC-ben is)

LXC-ben is)Viszont, ha a gpu nincs odaadva az LXC-nek, akkor mi alapján fogja a driver-t ismerni? bár most nézem, hogy ebbe a tteck-be benne van minden.. kipróbálom majd

plex-re már fut az ingyenes utána jön a pénzes és remélem befut majd valami jó kis ajánlat.

[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

noorbertt

#239

üzenetére

noorbertt

#239

üzenetére

Igen, láttam, de kipróbáltam az emby-t is, ami sokkal jobban tetszik eddig. Jellyfin -el is elégedett voltam/vagyok, csak a hardware acceleration nem akart vele menni.. de teszek még egy próbát.

Köszönöm a segítséget

Mindenkinek kellemes ünnepeket!“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

Vektor77

#259

üzenetére

Vektor77

#259

üzenetére

Nálam a rendszer egy 80GB -os raptor HDD-n van. A hozzátartozó cache pedig ssd-n, de ezt ritkán használja (64GB ram van benne). Az i/o wait-től tartottam, de nagyon nagyon ritkán van használva a raptor. influx-ba küldöm be a metrikát külön.

Továbbá az összes VM és LXC szintén nvme-n van (3db).

Még 3db storage célú hdd van, ebből az egyik a PVE számára backup-nak van adva.

Egyedüli probléma, hogy az összes backup a VM és konténerekről a gépen belül vannak csak..Viszont a kérdésednél maradva én egy külön tárra tenném ezeken felül a pve-t. Az 500-as ssd-re pedig a VM, containerek számára adnám.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Viszont lenne egy kérdésem, ha egy unprivileged container-t hozok létre az alatt sem látom tisztán a gépben lévő hdd-ket, hdsentinel nem tudja olvasni..

Bevallom a PVE-re nem raknék python-t se docker-t és jelenleg python-ba (docker-be csomagolva) írtam meg, hogy mqtt-n elküldöm a hdsentinel-es adatokat. De így nem tudom használni..

Ki, hogyan oldaná meg (persze tehetnék fel python-t, de alapjában véve a PVE-t nem "szemetelném")? Nem tudom pontosan, hogy mi korlátozz be az LXC-ben, hogy a smart- adatokat is lássam..

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Teljesen jó a meglátás, pedig még le is írtam (csak már régebben próbáltam) és az eszembe is volt, de most nem figyeltem rá csak leírtam.

Viszont ez alapjában véve kevés a config fájlban kell ez a módosítás is és akkor szépen olvassa a smart adatokat:

lxc.mount.entry: /dev dev none bind,optional,create=dir

#lxc.mount.entry: /dev/serial/by-id dev/serial/by-id none bind,optional,create=dirKöszönöm a segítséget

Megy unprivileged mode-ban is így.“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Látszólag ez a megoldás sem volt problémáktól mentes, nem tudtam a proxmox-ra be ssh-ni, gondolom nem tett jót, hogy az egész dev-et oaadtam egy container-nek.

Végül így is odaadtam a container-nek azaz readonly-ban és csak bizonyos disk-eket:lxc.mount.entry: /dev/sda dev/sda none bind,optional,create=file,mode=0444De látszólag ez sem volt tökéletes..

Végül az lett a megoldás, hogy a pve host-on egy cron job legenerálja az xml-t, amit felmountoltam a container-nek és ott már tudom azt parse-ni..A host-ra csak a bináris került le az is mentődik automatikusan és a cron job-is.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Tegyél fel bármit mást docker alá és figyeld a gépházat

Kiveséztük már 1,5 éve ezt a témát, egyértelműen a saját OS felé terelnek mindenkit, aki supervised-et akar használni.

Az csak idő kérdése, amíg a csomagokat is megszabják teljesen ugye már most is van követelmény rá.Mondjuk a problémád is jó, mert a host-ra külön én se raknák driver-t, de ez esetben lehet kivétel lenne.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

-

amargo

addikt

Azon is fog segíteni, nekem még nem kellett ilyen "beragadás" miatt újraindítani a host-ot.

A DVD-t pedig nézd meg az options alatt, hogy mi a boot sorrend, szinte biztos, hogy az tréfált meg

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

Vektor77

#364

üzenetére

Vektor77

#364

üzenetére

add new hard disk és kiosztod amennyit szeretnél. Ha zfs a rendszer akkor volume ként is odaadhatod.

Szerk:

Nekem a memory hotplug-al kapcsolatban lenne kérdésem ugye itt írják, hogy be kell kapcsolni a numa-t (is) : [link]

Viszont, ha ezt bekapcsolom, akkor a VM behúzza a kéziféket és hiába van alatta akár 3-4 mag is (i7-8700) iszonyatosan lassú lesz. Így inkább ki is kapcsoltam. Viszont érdekelne miért van ez?[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

Vektor77

#382

üzenetére

Vektor77

#382

üzenetére

Én ZFS-t ajánlom.

Nálam úgy van, hogy létrehoztam egy pool-t és 2db külön mountpoint-ot a storage-et odaadtam a PVE-nek (azaz nem VM-nek passthrough-al ) datacenter->storage->add->zfs (disk image, container) továbbá ugyan itt az add-alatt directory-ként a backup részt:

Ez pedig a volume:

A backup-ot értelemszerűen csak a pve használja a storage-ből pedig csipegetek a VM-nek is.

Igazából azért is van nálam így, mert 2TB -os a legkisebb hdd, backup-nak sok.. és akkor már az NVR-nek is oda van adva.“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Furcsa volt ez a tapasztalat, biztos én csináltam valamit rosszul. Még olvasok a témában.

A másik, hogy a cpu hotplug-ra van valakinek bevált script-je? Ha x percig y terhelése van, akkor dobjon be egy vcput.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Huawei b525-ös router-ről van szó? Ott korábban én is addig küzdöttem vele, hogy bridge módba tudjam rakni, amíg amnéziásra ütöttem a lelkét.

Én a routolást nem merném még bízni egy olyan gépre, amit napi szinten "cseszegetek".

Nálam van egy rule mikrotik-ben, hogy minden dns kérést a szerver felé terel, viszont, ha a szerver valamiért nem elérhető, akkor kikapcsolja a szabályokat, így akkor is van dns resolution, ha nem menne az adguard, nginx, treafik, stb..[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

tasiadam

#390

üzenetére

tasiadam

#390

üzenetére

A b525-ös router amúgy eszméletlen jó konstrukció volt kis pénzért, főleg a modem rajta. De igen, a szolgáltatói (és a gyári) szoftvere is egy "hulladék" volt, ha a plug and play-nél többet akartál. Lengyelek nagyon szétkapták és sok mindent megcsinálnak vele, de én egy balul kiadott parancs hatására felülírtam egy olyan részt benne, amit nem lett volna szabad innentől lett Selina.

Egy nagy nyereségű MIMO antennával a kb 1,5km-re lévő toronyból 250mbit-et kihoztam.[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Csak gondoltam megosztom.

Érdekes felfedezés volt nemrég, hogy az LXC során a backup elsőnek a /var/tmp akar kiíródni (rsync) és onnan dobja tovább a target backup path-ra.

Nálam a rendszernek egy kicsi lemez van odaadva az egyik LXC meg hízik.. szóval nem tudott már oda menteni. Ennek a megoldása:

cat /etc/vzdump.conf# vzdump default settings#tmpdir: DIRA tmpdir-t kell átrakni egy olyan helyre, ahol már van megfelelő tárhely.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

r4zer0919

#448

üzenetére

r4zer0919

#448

üzenetére

Tehát Nested Virtualization szeretnél? Ha proxmox-ot tényleg nem natívan szeretnéd futtatni, hanem virtualizálva. Milyen rendszer, amin a proxmox fut, miért szükséges ennyire megtekerni, csak 1db gépet szeretnél kliensnek és szervernek is ? azért itt nem biztos, hogy a proxmox-ot bevonnám a képletbe.

De itt a menete: [link]Viszont ha már a proxmox megkapja a GPU-t, 1 db vagy több is van? Passtrought-al csak egy gépnek tudod odaadni (vagy valami komolyabb szintű kártyával lehet megy, nem tudom), share viszont mehet több géppel is.

Én ezt a mondatot továbbra sem értem: Pl.: Az egyik ablakban egy win10 fut a másikban pedig egy win11.

Nem szeretnék külön egy szervergépet és küldön egy másik gépet amivel kapcsolódok a szervergéphez.

Lehet továbbra is félreértelek. Tehát azt szeretnéd, hogy van 1db géped, ott valamin keresztül virtualizálod (gondolom hyper-v) a Proxmox-ot és pluszban a proxmox-on belül lenne még két gépet. Tehát a kliens géped lesz a szerver géped is? Ez maga működik, de a GPU része proxmox alatt nem lesz egyszerű, ebben kezelésében a TrueNAS scale jobb, ha jól rémlik.[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

r4zer0919

#452

üzenetére

r4zer0919

#452

üzenetére

Köszi így már értem, nehéz a felfogásom

Ez alapján próbáltad? [link]

Azért még ha vGPU a proxmox alatt szerintem inkább az iGPU-t kellene használni a host-on, ha van, ha nincs, akkor egy másik kártya.szerk, már az iGPU tárgytalan. Viszont, amit szpeti40 is ír, miért nem jó erre egy hyper-v? Ott bármelyik lehet az alaprendszered és felrakod a másikat vagy van egy kiherélt windows-os és mellé a W10 és W11 (talán ott is kellene tudni virtuális GPU-t csinálni).

[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

r4zer0919

#459

üzenetére

r4zer0919

#459

üzenetére

Sajnos ebben nem tudok segíteni, de alapjában véve azt gondolom, ha 2db gpu a gépben onnantól az alaplapnál kell meghatároznod melyik a fő gpu (ez pl a gyengébb GPU lesz) a másikat pedig vGPU-ként tovább adod, tehát nem proxmox beállítás kérdése ez. De kíváncsi vagyok mi lesz a megoldás

szerk:

Ha két géped van, akkor nem kell gurulni a gépek között, mert akkor már van egy szerver és kliens megoldásod.[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

r4zer0919

#465

üzenetére

r4zer0919

#465

üzenetére

Ez tényleg csak pusztán magán vélemény, de szerintem konkrétan ilyen esetre leírást nem biztos, hogy fogsz találni (egyszerűen), biztos csinált valaki hasonlót kényszerűségből (értem a motivációdat is), de az biztos, hogy nagyon kevés értelme van ennek a felállásnak.

Kb 20-30e kapsz egy olyan vékony klienst, amit pár Wh-ből elmegy (tudom környezetvédelem, felesleges is lehetne..), nem kell külön GPU-ra beruházni, még passzív is lesz és nem kell órákat tölteni azzal, hogy egy elrugaszkodott megoldást próbálsz találni a problémára.Viszont tanulságos lesz, ha végig viszed a projektet

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Azért arra vigyázz, hogy ha csak az alaplapit adod oda a többinek, akkor az bedugulhat. Nálam voltak ilyen hibák ezért kellett külön dedikált hálókártya is, az bírja a terhelést.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Tök jó olvasni ezeket a pf/opnSense dolgokat, én még nem mertem meglépni, hogy egy rendes PC-re bízzam az egész routing-ot. Hogyan oldjátok meg, ha HW hiba miatt elszáll a gép, akkor is menjenek otthon az eszközök?

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Tök jó infók, ötletelések vannak itt.

Nálam 3 MT eszköz van otthon, backup-ból tényleg hamar cserélem, ha a manager router megdöglik, de klasszikus értelembe vett HA funkciót nem láttam benne (de ez inkább az én hiányosságom, nem ez a szakmám).

Én azért otthon próbálok valami olyan infrát tartani, hogy az eszközök számossága és fogyasztása se lépjen át egy bizonyos határt. Amikor napi 4kWh az alaprendszer (szünetmentes körön lévő dolgok, kamerák, switchek, router-ek, gépek, monitorok, stb) fogyasztása egy dolgozós napon, azért azt szemmel meglátja látja az ember.

Ezért próbálok a HA helyett valami olyat kitalálni otthonra, hogy könnyen orvosolható legyen egy HW hiba is, nyilván nem létszükség, de azért pár óra alatt futnia kell. Most pl egy noti van felkészítve rá, hogy azon elméletben 1-2 óra alatt eltudok indítani minden VM-et ugyan úgy.

ui csak infó, nálam két szünetmentes van: egy kisebb, amivel a teljes rendszer (130-190kWh) kb 30-40 percet megy el és egy nagyobb amit manuálisan kell elindítanom, de azzal pár órát elmennek.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Igen failover-t tud, nálam is így van megoldva az LTE-re átkapcsolás (hAP AC3 - wAP LTE6 és talomba van egy kis hAP AC2). Egyszer a szolgáltató tiltotta a ping-et kifelé, volt ám itt diszkózás

ViZion: Ez egy jó megoldásnak tűnik, kipróbálom majd, amint lesz időm rá

Hassio hiánya nálunk is sajnos "fájó" tud lenni, amikor nem megy, feleségem kb 10 perc után rám szólt, hogy mi történt, aztán jöttek a gyerekek de ezek csak kényelmi dolgok én még mindig tanulásnak és játéknak fogom fel, noha jelenleg biztosan spórolok vele bizonyos területeken.

de ezek csak kényelmi dolgok én még mindig tanulásnak és játéknak fogom fel, noha jelenleg biztosan spórolok vele bizonyos területeken. “The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Sziasztok!

Lenne egy kérdésem van egy ssd-m, ami a proxmox-nak van adva tisztán. Észrevettem, hogy minden nap hajnalban 4'10-től 100GB írás történik rá.

Ezt találtam a cron-ban:10 3 * * * root test -e /run/systemd/system || SERVICE_MODE=1 /sbin/e2scrub_all -A -rMaga az ssd ZFS-ben van, mennyire szükséges ezt naponta futtatni? Mert kicsit soknak tűnik, főleg, hogy felette ez csak hetente 1x fut le:

30 3 * * 0 root test -e /run/systemd/system || SERVICE_MODE=1 /usr/lib/x86_64-linux-gnu/e2fsprogs/e2scrub_all_cronMost nézem:

e2scrub - check the contents of a mounted ext[234] file system

Akkor nem tudom mi ír naponta 100GB a ZFS-es ssd-re..[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

-

amargo

addikt

HDSentinel-t becsomagoltam docker-be: [link] (van rá image is a dockerhub-on)

És mqtt-n feladom a SMART adatokat, így HA-ban tudom figyelni.Proxmox-al futottam bele, hogy nagyon szeparálódtak a storage-ek ki mit hol használ. Szerencsére a proxmox mindegyik disk SMART-jét tudja olvasni, de nem akartam még python-t se a host-ra, ezért csak az XML-t generálom 10 percenként a host-on (cron), ez a fájl pedig oda van adva egy LXC-nek és ott docker-ben ugye parse-om és küldöm tovább. Tudom kicsit kacifántos lett, de nem lett jobb ötletem, amikor az LXC-nek odaadtam a disk-eket akárt csak olvasásra, akkor előjött egy ssh elérési issue ezért inkább nem kísérleteztem tovább (időhiány).

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Teljesen jogos, rosszul írtam. Python van rajta, sok minden használja, tehát nem akartam még egy külön a script-et ott futtatni git repo-ból leszedni, stb.. jobban szeretem docker-ből kezelni a dolgokat. Tudom a hdsentinel binárisa így is a host-on van és ezzel talán csak megtekertem a dolgokat, de számomra ez jobban kezelhető, jobban megszoktam így használni a dolgokat.

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Ezzel nagyon betaláltál most, nem rég csináltam egy ilyet: [link] ez írja teli.

(valamikor szembe is jutott pár hete, hogy ez lehet a ludas és nyugtáztam is, de azóta jött a felejtő átok és..)

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Vigyáz mert én amnéziásra dolgoztam egy Huawei-t már, mikor bridge-et szerettem volna.. az volt a gond, hogy ha már úgy is hozzá nyúltam, akkor más tunningot is kigondoltam, de nyilván balul sült el

Nálam a NAT-ot pl csak úgy tudták leszedni (nem ismert, helyi szolgáltató), hogy havi 1100HUF-ot kell érte fizetnem..

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

válasz

inspiroyhome

#622

üzenetére

inspiroyhome

#622

üzenetére

Én is pont így használom a metrikákat ezen adatok alapján próbáltam a terhelést szét osztani a meghajtók között.

Kérdés a syslog-ot hova lenne érdemes küldeni?

ui: ez komoly masina lett

[ Szerkesztve ]

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Én nem gondolom rossznak a dupla NAT-ot főleg, ha tisztában vagy vele, akkor tudod is mit kell csinálni, ha valami problémát tapasztalsz.

(én csak egyszerűbbnek éreztem, hogy ne legyen, persze így meg folyamatosan támadják is az infrát..)“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

-

amargo

addikt

Tényleg kíváncsiságból, magát a proxmox host-ot miért érdemes ssd-re rakni?

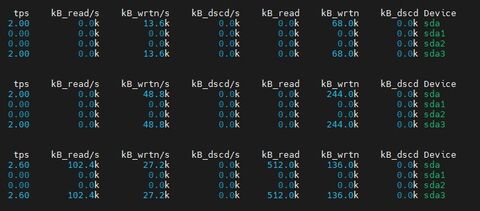

Csak azért kérdezem, mert én a disk degradációja miatt egy gyors hdd-re raktam már az elején is, minden más ssd-n van, kivéve persze az adatok és nem érzem úgy, hogy lassú lenne a rendszer, ennyi művelet van rajta:

“The workdays are long and the weekend is short? Make a turn! Bike every day, bike to work too!”

Új hozzászólás Aktív témák

- Eredeti Microsoft termékek - MEGA Akciók! Windows, Office Pro Plus, Project Pro, Visio Pro stb.

- Canva Pro előfizetés - 1 éves

- Adobe Creative Cloud - 2024. 04. 05 - 2025. 04. 05-ig

- Windows 10 11 Pro Office 19 21 Pro Plus Retail kulcs 1 PC Mac AKCIÓ! LEGOLCSÓBB! Automatikus 0-24

- Windows, Office licencek a legolcsóbban, egyenesen a Microsoft-tól - 2990 Ft-tól!

LXC-ben is)

LXC-ben is)