Kétség nem fér ahhoz, hogy az utóbbi időszakban előtérbe kerülő mesterséges intelligencia megoldások alapjaiban fogják átalakítani jövőnket. Már most számos olyan mélytanuló adaptációról adhatunk hír, amiben a gép rövid fejlődési – tanulási – időszak után eléri, sőt meghaladja az emberek képességeit, legyen szó a CT képek elemzéséről, hidak állapotának felméréséről, kiberbiztonságról vagy bármiről. A működésüket képelemzésre alapozzák. Az adott problémát ilyen feladattá alakítva emésztik meg, majd nekilátnak a rendelkezésre álló adattenger átböngészésének, döntéseik helyességéről pedig visszacsatolást kapnak.

Az ilyen mélytanuló mesterséges intelligencia eljárásoknak számos előnyük mellett van egy komoly hátrányuk is, ami elsősorban feladatkritikus helyzetekben jelenthet gondot. Úgynevezett fekete doboz algoritmusokról van szó, amelyekről csak azt tudjuk, hogy hatékonyságuk idővel – hiszen folyamatosan tanulnak – javul, arról viszont nem adnak lényegi információt, hogy ezt a javulást milyen tanulási döntések, következtetések mentén érte el. A Fujitsu és a Fuijtsu Laboratories sok egyéb mellett ezzel a problematikával is foglalkozik.

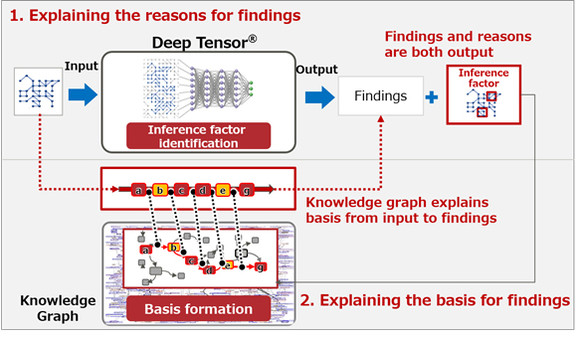

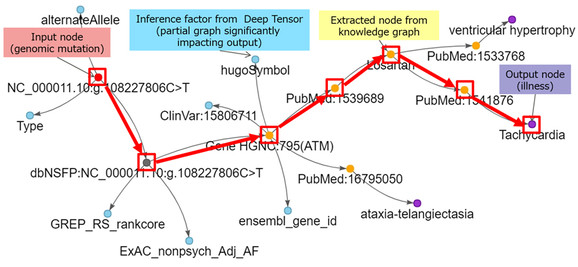

A mélytanulás folyamatában minden következtetésnél kapcsolatokból, elágazásokból álló tenzor épül fel. Ebben a tenzorban megy végbe maga a döntés, például arról, hogy a vizsgált pixel színe, pozíciója, szomszédai tulajdonsága, illetve ki tudja még mi alapján rákos daganatot takar-e vagy sem. A döntés végrehajtása után az ide vonatkozó elágazások törlődnek – adott esetben jön egy visszacsatoló értékelése a döntésnek –, és kezdődik újra a folyamat egy újabb döntéshez. Az új megoldással úgynevezett tudás gráf készül, ami éppen a döntéshez használt faktorokat tárolja, ezek alapján pedig információt tud adni arról, hogy a mélytanuló rendszer miért döntött úgy, ahogy döntött, például milyen tényezők alapján mondta rá a vizsgált képre, hogy az lovat ábrázol.

Génmutációk és betegségek között kapcsolatot kereső mélytanuló rendszer döntéseinek visszakövetése

Egyelőre még gőzerővel folynak a kutatások azzal kapcsolatban, hogy az emberi gondolkodással ezek a tudás gráfba kinyert, úgymond döntési magyarázatok mire használhatóak. Talán semmire, de megtörténhet az is, hogy egy-egy kutatást vagy tudományszemléletet olyan irányba tudnak elvinni, ami eddig egyetlen embernek sem jutott az eszébe. Mindenesetre a fő szempont egyelőre a mélytanuló algoritmus döntésinek visszakövetkeztetése, annak eldöntése, hogy nem lappang-e mögöttük valamilyen kritikus veszély. A Fujitsu azt tervezi, hogy a mélytanulás döntéseit elemző technológiát már a 2018-as üzleti évben (tehát 2019 tavaszáig) elérhetővé teszi az univerzális Zinrai mesterséges intelligencia API-k rendszerében.