-

IT café

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Yany

addikt

Önmagában igazad is van, csak az említett videóban épp az a pláne, hogy generációkat vet össze és ebben van tökéletesen kiábándítóan igaza. Innen érdemes csekkolni: JayzTwoCents on 2080(Ti)

szerk.: a hűtésről: most először szimpi nekem igazán egy FE kártya. Kár a kicsit lefojtott légáramlatokért, de az a full-board vapor nekem nagyon szimpi.

[ Szerkesztve ]

Építs kötélhidat - https://u3d.as/3078

-

VTom

veterán

Épp az árazás miatt probléma ez.

Ha meglépik ezt a 30%-ot, akkor ugyanarra az árszintre lövik be a kártyákat, mint az nvidia megfelelője, max $50-ral kevesebbre..

A flagship kártyájuk meg az nvidia tier 2-es (valójában tier 3-as) kártyájának a teljesítményét hozza, vagyis az nvidia a flagshipet megint oda árazza, ahova akarja.

Ezt a helyzetet csak az oldaná meg, ha az AMD átvenné, de legalább megközelítené a leggyorsabb GPU címet. Ehelyett egyelőre annyit tudunk a terveikről, hogy majd ki szeretnének adni egy 1080 tudású kártyát $250-ért, és jönni fog a 7nm-es Navi a profi szegmensbe.Aztán lehet, hogy igaz amit Abu mondott, hogy kb. ezekkel a VGA árakkal lehet számolni a jövőben, esetleg még további drágulással..

Everybody has a plan until they get punched in the mouth.

-

Puma K

veterán

Én mikor még befolyásolhatóbb voltam és hittem az itt terjedő akkori DX10.1-gyes meséknek hogy az mennyire jövő és időtálló lesz, vettem egy HD 4850-at ami támogatta-tudta a DX10.1-gyet... a gyakorlatban nem volt rossz, de 6-7 hónap után kiderült számomra, hogy hiába olcsó nem elég erős arra amire nekem kellett és a DX10.1 is egy rossz vicc úgy egymagában... így cseréltem egy GTX 275-re amivel maximálisan meg voltam elégedve még annak ellenére is, hogy csak DX10-et tudta... ami meg úgy volt beállítva, hogy hát jó meg erős, de elavult lesz... ja idővel minden elavul, csak nem mindegy, hogy mikor

"Cuccok: csattogós lepke és tiki-taki" └[ʘヘʘ]┘

-

Jack@l

veterán

Hazai vega64 árakat nézve sokkal jobban jár az ember egy 2080-al... (30e kb a különbség)

[ Szerkesztve ]

A hozzászólási jogosultságodat 2 hónap időtartamra korlátoztuk (1 hsz / 10 nap) a következő ok miatt: Az ÁSZF III 10/8. pontjának megsértése - trollkodás - miatt. Többször és többen is kértek már, hogy hozzászólás írásakor használd a linkelés funkciót, mert ennek elmaradása sokak számára zavaró.

-

-

-

-

-

Segal

veterán

A nagy kérdés hogy ezekután lesz e bőr az nvidia képén késöbbiekben egy Titan-t is kiadni.... (szerintem lesz)

"Ez nem változtat azon, hogy tisztességtelen dolog botokkal felvásárolni 160-180e indulóáron a 3060 Ti-t, aztán 250e-ért árulni a HA-n." Ez miért lenne tisztességtelen? Te is meg bárki lesheti botokkal a boltokat, ugyanúgy meg tudod venni a cuccot azon az áron, mint a scalper.(1 házigazda válasz...)

-

Abu85

HÁZIGAZDA

Erre a problémára már rég kitalálták a skálázást. Van egy kerete a GPU-nak, amit megkaphat. Ha valamiért nem kapja meg. Például valami másnak kell az energia, akkor a GPU-ban annyi történik, hogy x-200 MHz lesz az órajel, és működik tovább. De ha az a valami más nem működik, akkor mehet az x órajel, és felveheti ugyanazt az energiát. Ennek a megoldásnak az az előnye, hogy nem veszik el a teljesítmény.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Pont az a probléma, hogy a sebessége alacsony. Eközben a mindkét explicit API kezel host coherent és host visible memóriatípusokat, amiket pont a konzolok miatt használnak is a motorok, vagyis minél több puffer megy ilyen logikai memóriatípusba, annál több adatot kell vagy a CPU-nak (az AMD implementációja), vagy a GPU-nak (az NVIDIA implementációja) a PCI Express interfészen keresztül elérnie. Ezért láthatod azt az olyan típusú motoroknál, mint például a Decima, hogy 4K-ban igenis számít az x16-os PCI Express 4.0, mert a pufferek is 4K felbontásúak, és így már túl sok adat közlekedik azon a relatíve lassú buszon, hogy mérhető limit mutatkozzon. Az NV-nél a PCI Express 4.0 még nagyobb előny lesz, mert ők az AMD-vel ellentétben nem a procit kérik meg, hogy menjen el a VRAM-ig, hanem a GPU-t küldik a rendszermemóriáig, és jellemző, hogy a GPU-nak a host coherent és host visible memóriatípusokba helyezett adatokra többször van szüksége. Ha az AMD is így implementálják az API memóriahalmazait, akkor nekik is jobban számítanak a PCI Express 4.0, de az AMD inkább a GPU memóriájába rakja a puffereket, mert a CPU ritkábban kéri ezeket az adatokat. De a limit valamelyik részegység oldaláról mindenképpen meglesz, mert vagy a CPU adatelérését fogja limitálni a PCI Express, vagy a GPU-ét. Olyan implementáció csak integráció mellett van, ami egyiket sem limitálja, de ez csak azért van így, mert APU-nál nincs PCI Express kapcsolat.

(#28875) sutyi^: Persze, hogy van oka. Az AMD és az NVIDIA nem tudja, hogy milyen játékokkal tesztel az adott média. Javaslataik vannak, de azokat nem kötelező követni. Így viszont a platform oldalán igyekeznek most x16-os PCI Express 4.0-t ajánlani, mert azzal a legkisebbek a limitek, ha esetleg beesne a tesztbe egy olyan játék, ami magas felbontáson erősebb terhelést rak a buszra. A limitet egyik cég sem tudja megkerülni, így együtt kell élni vele, viszont minél gyorsabb a busz, annál kisebb lesz majd a limit. De amúgy a játékosok nyugodtan megvehetik PCI Express 3.0-hoz, a problémázó játékokban, magasabb felbontáson vesztenek pár százaléknyi teljesítményt, ami normál felhasználásnál belefér, tesztekben nyilván nem igazán.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A host visible és host coherent memóriatípus pont azért van bevezetve az új API-kba, hogy ne kelljen a PCI Express buszon minden egyes képkocka számításának elején 100-200 MB-nyi adatot lemásolni a VRAM-ból a rendszermemóriába, hanem elég legyen csak annyi adatot átpréselni a buszon és akkor, amikor implementációtól függően a CPU vagy a GPU igényli.

A közhiedelemmel ellentétben ez egy optimalizáció, amivel sebességet lehet nyerni, mert ilyen formában kevesebb adat fog közlekedni a PCI Express buszon. Szóval ez nem a PC-sekkel való durva kibaszás.

Összességében ezekkel az új lehetőségekkel gyorsabb motorokat lehet írni ugyanarra a konfigurációra, az mindegy, hogy abban PCI Express 2.0, 3.0 vagy 4.0 interfész van. Ez csak annyiban számít, hogy nyilván a nagyobb sávszél előnyösebb a sebességre nézve.

Összességében ezekkel az új lehetőségekkel gyorsabb motorokat lehet írni ugyanarra a konfigurációra, az mindegy, hogy abban PCI Express 2.0, 3.0 vagy 4.0 interfész van. Ez csak annyiban számít, hogy nyilván a nagyobb sávszél előnyösebb a sebességre nézve.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

nubreed

veterán

-

-

Egon

nagyúr

Technikailag igazad van, használhatóság szempontjából a GF1 helyett inkább a GF2-t emelném ki, illetve hiányolom a felsorolásból a GF6-os szériát, mint az első SM3.0-t tudó kártyacsaládot...

"Bonyolult kérdésre egyszerű választ keresni helyénvaló, de ritkán célravezető megoldás" (Wayne Chapman)

-

-

paprobert

senior tag

Ennyi szokott lenni vagy csak új architektúránál, vagy egy régivel, csak frissített node-on. Amikor a kettő együtt jön, mindig sokkal nagyobb az ugrás.

A másik, hogy most egy konzolgenerációs váltásban vagyunk, vagyis arányaiban sokkal kevesebbet kínál a PC hardver. A gyorsított iramban elavulttá váló előző generációkhoz viszonyítani kényelmes (igazából nincs is más, amihez tudunk), de a helyzet az, hogy nagyobb az elvárás most.

Nem lehet lineáris skálán gondolkodni, amikor a környezet lineárisnál gyorsabban növekszik, és inflálja a hardvert.

[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

-

Egon

nagyúr

-

hoolla

aktív tag

Az egy regebbi kartya dvi portja shoppolva. Az emberunk meg arra sem vette a faradtsagot hogy a csavarokat is leszedje...

konyorgom ne vegyetek mar azt komolyan...

konyorgom ne vegyetek mar azt komolyan...

"It was the best of times, it was the worst of times, it was the age of wisdom, it was the age of foolishness..."

-

warcat

veterán

Szerintem meg nem, ha így lenne, érkezne most a 3080 Ti.Ha a 3080 800-900 dollár lesz, miért hagyná üresen a saját maguk által kreált 1200+-as ársávot nvidia?

Ezek inkább csak keselyű árazások a mindenáron elsőként kártyára vágyóknak,kínai vámháborús extrával megterhelve.De úgyis kiderül kedden.

EA: It's in the crate!

-

Raymond

félisten

Egyelore nagyon ugy nez ki hogy 2080Ti -> 3080 es 2080S -> 3070 es ha az arak ugy lesznek ahogy a multkori listaban voltak akkor gyakorlatilag az lesz hogy a 2080S teljesitmeny jon a $500 regioba a 2080Ti teljesitmeny pedig a $700 regioba. A 3090 pedig annyiba kerul amennyit nem szegyel az NV kerni erte.

[ Szerkesztve ]

Privat velemeny - keretik nem megkovezni...

-

egyedülülő

őstag

Nekem akkor itt bukik a dolog, mivel 3070-re rendezkedtem be fejben. Korábban arról szólt a fáma, hogy az egész szériának jelentősen nő az rt képessége. Nekem, aki nem 4k-ban játszik, de fontos lett volna 1440p-ben a frankó rt képesség a 3070 lett volna a jó ár érték arányú cucc. Erre úgy tűnik NEKEM most, hogy ez a 3090-3080 privilégiuma lesz. Ezek után kíváncsi leszek tényleg az árazásra...

"Ha lenéznénk az űrből a földre, nem látnánk az országhatárokat. Csak egyetlen kis bolygót látnánk."

-

NightGT

senior tag

Ilyen móka ez. Sportteljesítmény. Észre is vettem az éves elszámolásnál, pedig nálam nincs is komoly vas...aki szeret ezzel foglalkozni, annak meg.

De lehet az több is, ha ez a TDP limit nem műszaki, hanem piaci megfontolások alapján született (átlag ház szellőzése, táp, marketing, etc). Valamint Avg +10% mellett Pascalon a Min. 1% - 0.1%-nál már látok +15-20at is, és az az, ami számít. 144Hz monitoron 85FPS (sync nincs) alatt már émelyegni kezdek, de fiatalabb esportos srác mondott olyat, hogy 120 alatt rá se bír már nézni az övére. Rosszul lesz tőle. Azért olykor jól jön...

Speed is the only truly modern sensation

-

Jacek

veterán

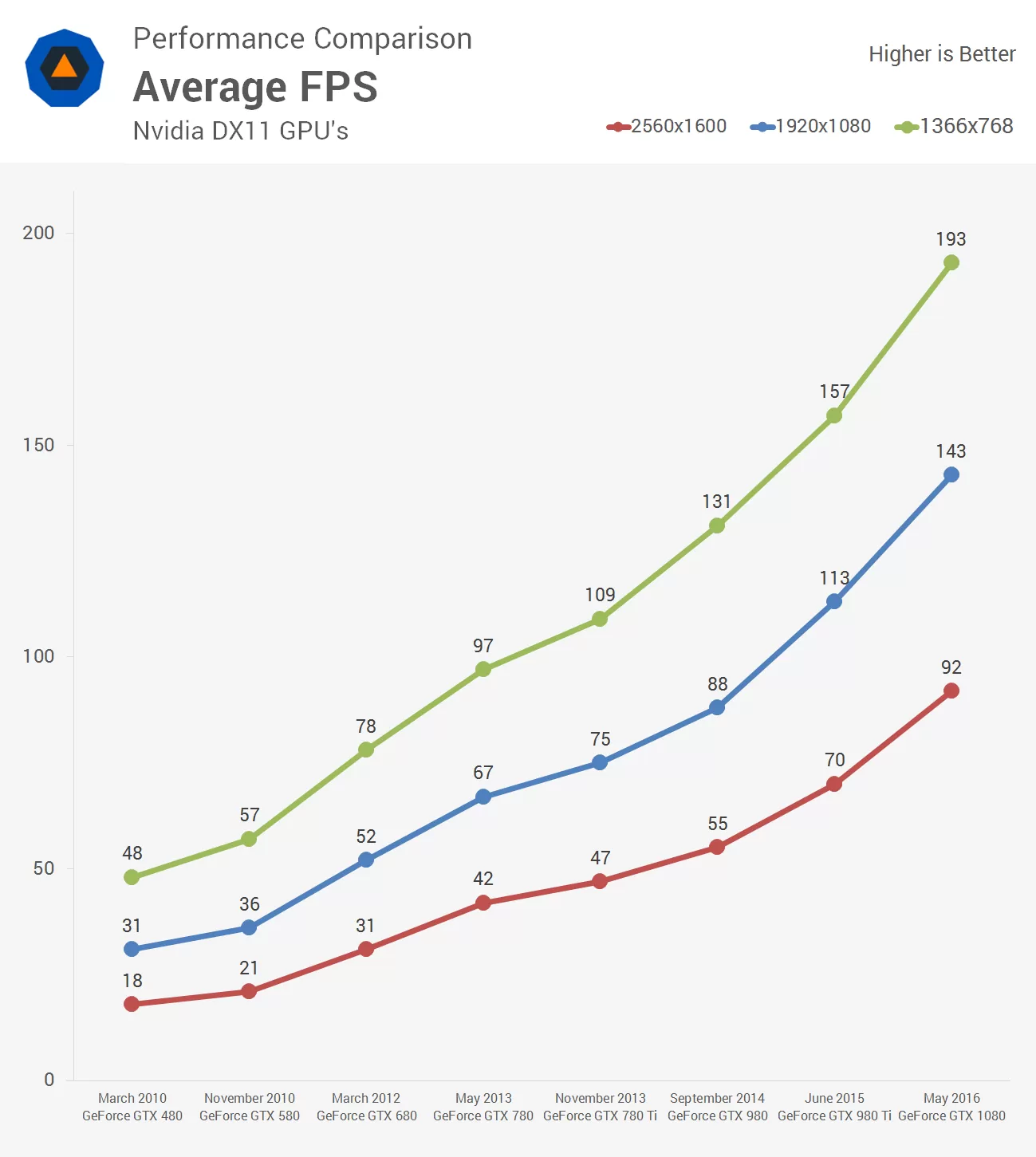

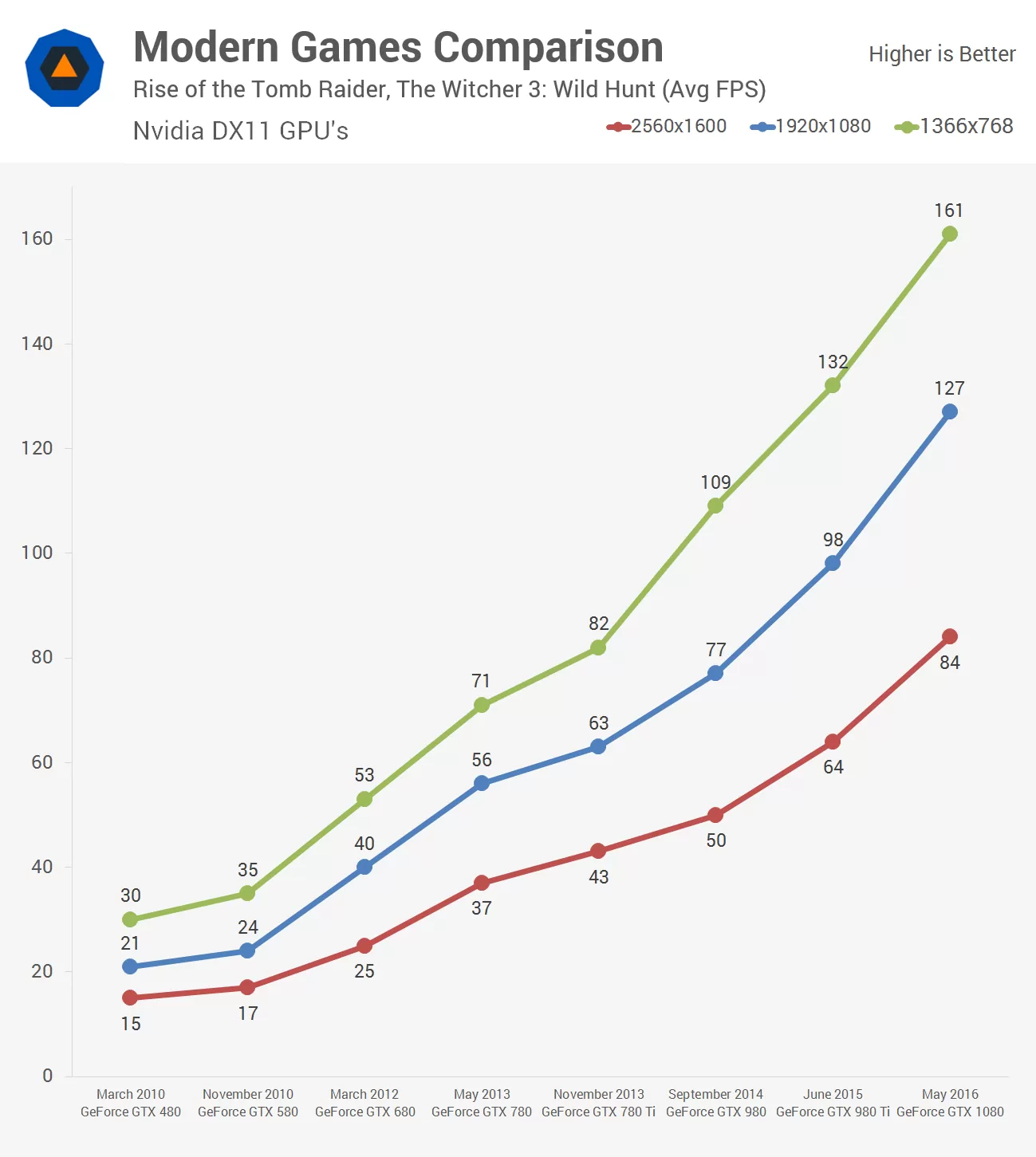

Neked hányszor kell belinkelni mennyit gyorsultak a genek? na nem ennyit ami itt látszik ha az 90-es. Elöző is gyalázat volt kellett is a szuper de ha pl pascal mond valamit ott a 70-es közel hozta a 980Ti, most ezt a 80-as fogja? 1000 euroért?

új ficsörök? mik votak az egetrengető néküle nem tudok élni?

új ficsörök? mik votak az egetrengető néküle nem tudok élni? -

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az NVIDIA éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Összességében ezekkel az új lehetőségekkel gyorsabb motorokat lehet írni ugyanarra a konfigurációra, az mindegy, hogy abban PCI Express 2.0, 3.0 vagy 4.0 interfész van. Ez csak annyiban számít, hogy nyilván a nagyobb sávszél előnyösebb a sebességre nézve.

Összességében ezekkel az új lehetőségekkel gyorsabb motorokat lehet írni ugyanarra a konfigurációra, az mindegy, hogy abban PCI Express 2.0, 3.0 vagy 4.0 interfész van. Ez csak annyiban számít, hogy nyilván a nagyobb sávszél előnyösebb a sebességre nézve.

konyorgom ne vegyetek mar azt komolyan...

konyorgom ne vegyetek mar azt komolyan...